精选 · 第 01 篇

精选 · 第 01 篇DeepSeek 实战指南:模型版本、思考模式、价格与限制全解析

本文基于 2026 年 4 月官方文档与线上 API 实际情况,系统梳理 DeepSeek 当前在 API 上真实运行的模型版本、两种思考模式的差异与适用场景、价格结构与成本优化方法,以及在文档分析、推理能力和安全合规方面的边界与注意事项,帮助开发者、研究者和业务团队在投入时间与预算前做出理性决策。

通过实操案例和步骤讲解,让读者能够真正把 AI应用到 写作、设计、视频、编程、营销等实际工作中。内容包括: AI新手入门教程 ChatGPT使用指南 AI提示词(Prompt)技巧 AI自动化工作流 AI创作案例

精选 · 第 01 篇

精选 · 第 01 篇本文基于 2026 年 4 月官方文档与线上 API 实际情况,系统梳理 DeepSeek 当前在 API 上真实运行的模型版本、两种思考模式的差异与适用场景、价格结构与成本优化方法,以及在文档分析、推理能力和安全合规方面的边界与注意事项,帮助开发者、研究者和业务团队在投入时间与预算前做出理性决策。

精选 · 第 02 篇

精选 · 第 02 篇DeepSeek 已从一款在 2025 年初短暂刷屏的中文聊天机器人,演变为一整套快速迭代的模型家族与平台。从 2024 年 5 月的 DeepSeek‑V2 到 2025 年 12 月的 V3.2,再到 2026 年 4 月的现状,模型版本、API 映射、开源权重、隐私与许可条款都与早期解读有了明显差异。本文基于官方文档与公开资料,重建时间线,梳理 V2→V3.2 的关键技术与产品转向,并总结当前 API 使用要点与隐私风险。

精选 · 第 03 篇

精选 · 第 03 篇人工智能助手已不再是遥远的未来概念,而是现今强大的工具,能够直接在您的电脑上运行,自动化复杂任务,极大提升个人生产力。与传统仅限于聊天窗口的聊天机器人不同,这些智能助手可以操作本地文件、运行软件,并自主完成多步骤工作流程。 面对众多各具特色的选择,哪款最适合您?本文将介绍2026年领先的五款AI助手,比较它们的功能、价格及最佳使用场景,助您做出明智选择。 五大AI助手一览 工具名称 适用场景 主要

DeepSeek 是一家中国人工智能公司,“DeepSeek”这个名字既可以指公司本身,也可以指用户在网页或 App 中使用的聊天助手,以及支撑该助手的模型家族与 API 生态。本文用简明方式梳理 DeepSeek 的公司背景、产品生态和主要模型线路。

DeepSeek 开源大模型以高性能和高性价比受到关注,但在企业级环境中落地,需要在安全、合规、运维和责任边界上保持清醒与克制。本文从“什么是企业环境”出发,系统梳理 DeepSeek 的能力与局限,并给出部署、安全、合规和适用场景的实务建议,帮助 CTO、AI 负责人和平台工程团队做出理性决策。

你的团队中最宝贵的洞见、决策和工作流程都存在于 Slack 中。但当需要执行具体工作——如撰写产品需求文档(PRD)、总结会议内容或整理每周更新时,你常常不得不离开对话,切换上下文,亲自完成繁重的任务。 今天,我们推出了完整的 Manus 与 Slack 集成方案。Manus 是一位自主的 AI 工作伙伴:你交代任务,它执行并交付成品。将 Manus 引入 Slack,意味着你可以在对话发生的地方

在信息爆炸的时代,借助 DeepSeek 等大模型自动生成文档摘要、搭建基于文档的问答系统,已经成为企业提升效率的关键手段。本文系统介绍 DeepSeek 各类模型在长文档摘要与检索增强问答(RAG)中的使用方法、部署方式与优化技巧。

本文系统介绍如何基于 DeepSeek V3 使用 LoRA 进行高效微调,包括模型概览、LoRA 原理、完整实践步骤、与全参数微调和指令微调的对比、典型应用场景、可用工具平台以及风险与最佳实践,帮助开发者在有限算力下打造面向特定领域和任务的定制大模型。

本文介绍如何在本地使用 vLLM 高性能推理引擎运行 DeepSeek V3.2‑Exp,涵盖硬件要求、环境配置、模型加载,以及三种推理部署方式:CLI 快速体验、Python 脚本调用和本地 OpenAI 兼容 REST API 服务。

本文以务实视角介绍开发者和研究人员在日常工作中如何使用 DeepSeek,涵盖科研辅助、推理分析、编码协作和内部文档处理等典型场景,并明确其能力边界:它是强大的辅助工具,而非替代人类专家的全能系统。

本文介绍如何在 CPU / Mac 上通过 llama.cpp 与 GGUF 格式本地运行 DeepSeek,包括支持的模型、量化等级与内存匹配、Mac/CPU 编译安装步骤、命令行聊天与本地 API 服务器示例,以及在量化条件下的性能优化与质量权衡。

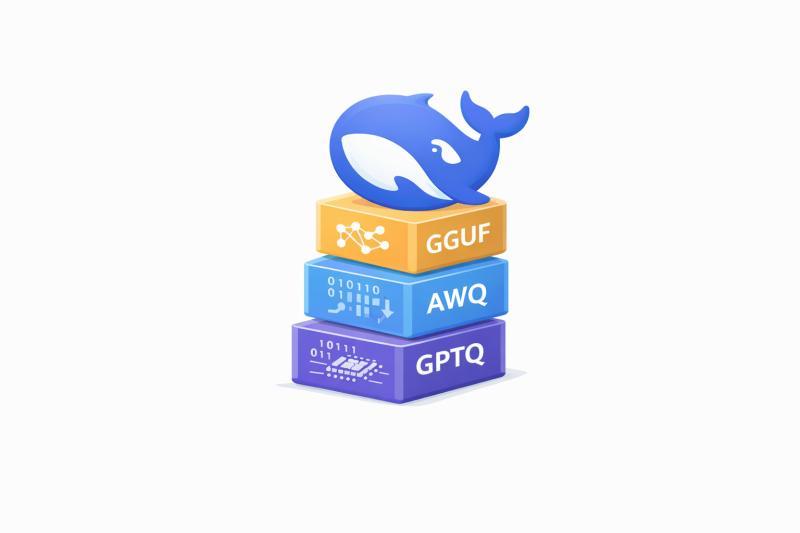

DeepSeek 系列是开放权重大模型,支持本地部署,但原始模型参数规模巨大,直接以全精度运行对大多数个人或小型服务器来说几乎不可能。本文系统对比 GGUF、AWQ、GPTQ 三种主流量化格式在 DeepSeek 本地部署中的适用场景、优缺点与选型思路,帮助你根据硬件与应用需求做出合适选择。

当 DeepSeek 在网页端、移动端或 API 上无法正常工作时,可以按照“设备与客户端 → 网络 → 身份认证 → 请求结构 → 频率与配额 → 平台状态”这六层排查模型,逐层缩小问题范围,快速定位根因并恢复使用。

本文系统梳理如何在 AMD ROCm GPU 与苹果 Mac Metal 环境中本地运行 DeepSeek 系列大模型,涵盖快速选型路径、平台与格式兼容性矩阵,以及在非 CUDA 环境下最常见的报错与对应解决方案。

本文系统梳理如何在 AMD ROCm GPU 与苹果 Mac Metal 环境中本地运行 DeepSeek 系列开源大模型,涵盖快速选型路径、平台与格式兼容性建议,以及常见错误的成因与解决步骤。

本地部署 DeepSeek 确实能显著减少数据外泄风险,但并不等于隐私“无敌”。隐私效果取决于模型周边工具、运行环境、网络与日志配置,而不是“在自己电脑上跑”这一点本身。

在本地运行 DeepSeek 确实能避免数据直接发送到外部服务器,但这并不是隐私“万能钥匙”。真正的安全取决于你使用的运行环境、网络配置、日志与缓存策略,以及是否彻底关闭遥测与外联。本文系统梳理本地 DeepSeek 的隐私模型、数据可能残留的位置、网络暴露与遥测风险,并给出一套可操作的隐私加固清单与使用边界判断。

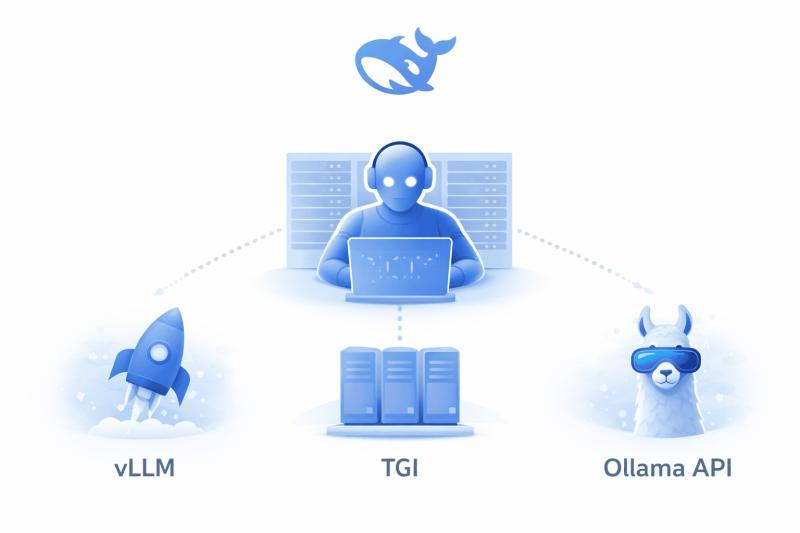

本文系统介绍如何将 DeepSeek 模型通过 vLLM、TGI 与 Ollama 三种开源推理引擎部署为稳定、安全、高效的生产级 API 服务,并深入解析批处理、并发、超时、限流、安全与监控等关键实践。

本文介绍如何在 Azure AI Foundry 上部署与使用 DeepSeek R1 推理大模型,包括模型特点、可视化向导部署步骤、Python 与 REST API 调用示例、公有云与企业私网配置要点、成本优化策略、典型业务集成场景,以及使用过程中的限制与最佳实践。

在 Windows 本地运行 DeepSeek 完全可行,但不同方案体验差异巨大。本文用通俗视角梳理 WSL2 与原生 Windows 的取舍、CPU / GPU 路线、Ollama 与 llama.cpp 的简易玩法、NVIDIA 与 AMD 在 Windows 上的真实支持现状,以及常见故障排查与本地隐私安全要点。