如果你正考虑在项目中使用 DeepSeek,首先需要搞清楚的是:现在官方 API 上到底在跑什么模型、有哪些模式、价格怎么算、能做什么和不能做什么,而不是依赖几个月前的旧资料或坊间传闻。本文围绕这些关键问题,给出基于官方信息的最新实况说明,面向开发者、研究人员和业务团队,帮助你在投入时间和预算前做出更稳妥的选择。

你可以直接在本站在线体验:DeepSeek Chat,无需任何配置。如果你更关心如何用 DeepSeek 搭建 RAG 检索增强问答、客服自动化等完整方案,可以参考我们的使用场景页面。本文重点放在理解 DeepSeek 的核心能力与使用原则上。

目前 DeepSeek API 实际运行的模型

网上关于 DeepSeek 模型线的介绍有不少已经过时。很多文章仍把 DeepSeek V3 和 DeepSeek R1 当成两个需要二选一的独立模型,但这已经不是现在的情况。

截至 2026 年 4 月,两个 API 端点——deepseek-chat 和 deepseek-reasoner——底层都运行同一个模型:DeepSeek V3.2。两者的区别在于运行模式不同,而不是模型不同。

deepseek-chat:在**非思考模式(non-thinking mode)**下运行 V3.2,响应直接、速度快,最大输出 8K tokens(默认 4K)。适合日常对话、内容生成、一般问答和大部分编程任务。deepseek-reasoner:在**思考模式(thinking mode)**下运行 V3.2,先生成清晰的推理过程,再给出最终答案。最大输出 64K tokens(默认 32K),更适合复杂分析与多步推理,但响应更慢、输出更长。

根据官方定价页面,两个端点在 API 上的关键规格完全一致:

- 上下文长度:128K tokens(两种模式相同)

- 价格:

- 输入 tokens(缓存未命中):每 100 万 tokens 收费 0.28 美元

- 输入 tokens(缓存命中):每 100 万 tokens 收费 0.028 美元

- 输出 tokens:每 100 万 tokens 收费 0.42 美元

- 支持能力:

- JSON 输出

- 工具调用(tool calls)

- 聊天前缀补全(测试中)

- FIM 代码补全(测试中,仅非思考模式支持)

V3.2 的一项重要升级是**“带思考的工具调用(Thinking in Tool-Use)”**:模型在调用外部工具的同时进行推理,决定何时调用、调用哪些工具以及如何组合结果。这对构建智能体(Agent)非常关键。根据 V3.2 发布说明,DeepSeek 通过新的 Agent 训练数据合成方法,覆盖了 1800+ 环境和 8.5 万条复杂指令,使 V3.2 成为首个将“思考”直接融入工具使用的 DeepSeek 模型。思考模式与非思考模式都支持工具调用。

从演进路径看,V3.2 是一系列版本迭代的结果:

- DeepSeek V3(2024 年 12 月)

- V3-0324(2025 年 3 月)

- R1-0528(2025 年 5 月,专门的推理模型)

- V3.1(2025 年 8 月,首个“思考/非思考”混合模型)

- V3.1-Terminus(2025 年 9 月)

- V3.2-Exp(2025 年 9 月)

- V3.2(2025 年 12 月,当前生产版本)

如果你看到“DeepSeek-Coder”被描述为独立编程模型,需要注意:自 2024 年 9 月 V2.5 起,它已经并入通用模型,目前 API 上没有单独的“Coder”模型。

另外,官方文档明确说明:APP/网页版本与 API 版本可能存在差异。本文所有规格均针对 API 端点。如需更细的模型对比,可查看我们的模型总览页面。

DeepSeek 思考模式是如何工作的?

在使用 DeepSeek 时,最关键的实务选择就是:什么时候用思考模式,什么时候用非思考模式。这会直接影响结果质量、响应速度和费用。

非思考模式(deepseek-chat)

- 面向交互场景设计,不输出中间推理过程。

- 优点:速度快、输出更短、更省 tokens。

- 适用:写邮件、简单问答、内容生成、日常对话、常规代码生成等不需要复杂推理的任务。

如果问题不复杂、你更在意响应速度和成本,优先用非思考模式。

思考模式(deepseek-reasoner)

- 面向需要多步分析的复杂问题。

- 模型会先生成内部推理链,再给出最终答案。

- 优点:推理过程透明,可检查逻辑,更适合多步骤、复杂推理任务。

- 代价:响应更慢,输出更长,消耗更多 tokens(推理过程也计入输出)。

思考能力最早来自 DeepSeek R1,在多项推理基准上表现突出。根据 R1-0528 发布说明,其在 AIME 2025 上取得 87.5 分,在 GPQA 上为 81.0,在 Aider 上为 71.6。V3.2 继承了这些推理能力,同时在速度上进一步优化——V3.1 发布说明中提到,思考模式的响应时间明显快于原始 R1-0528。

实务上的简单规则:

- 当你更看重准确性和推理深度(复杂数学、多步逻辑、棘手调试、研究分析等),用思考模式。

- 其他大多数场景,用非思考模式即可。

由于两个端点的单价相同,成本差异主要来自:思考模式会生成更长的推理输出,从而消耗更多输出 tokens。建议在不需要长推理链时,适当设置 max_tokens 上限,避免动辄几万 tokens 的输出。关于如何精细控制思考行为,可参考官方的思考模式使用指南。

DeepSeek 能读文档、分析文件吗?

可以,但有前提条件。

- V3.2 支持最多 128K tokens 的输入,大致相当于约 200 页文本。

- 你可以把完整报告、论文或政策文档一次性贴入提示词中,让模型针对其中内容回答问题。

- DeepSeek 平台也支持文件上传,避免手动复制粘贴。

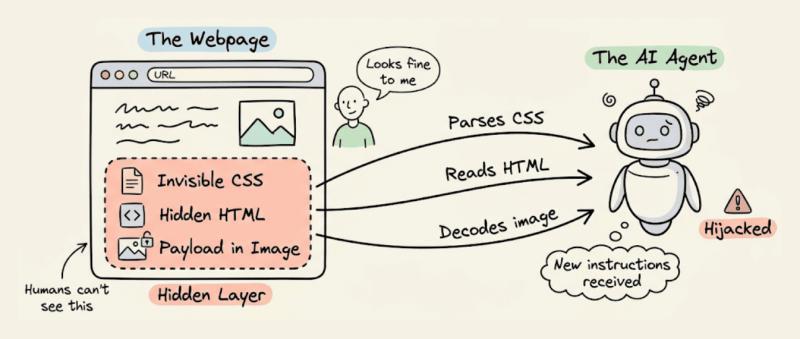

但当前生产环境的 API 是纯文本接口:

deepseek-chat与deepseek-reasoner都不能直接处理图片、音频或视频。- 如果文档中包含关键图表、示意图或照片,这些视觉信息不会被模型理解。

- DeepSeek 确实发布过视觉语言研究模型(DeepSeek-VL、DeepSeek-VL2),但它们与生产 API 分离,需要单独部署。

在数据访问方面,需要注意:

- DeepSeek 不会主动访问你的任何数据,除非你在请求中明确提供。

- 模型不会自动读取你的文件、也不会连接你的内部系统。

- 不同会话之间没有持久记忆,每次调用都从零开始。如果你希望模型“知道”某些信息,必须在当前提示中提供。

平台层面可能会按隐私政策存储对话记录,若涉及敏感数据,建议仔细阅读相关条款。更多数据安全说明可参考我们的安全页面和隐私政策。

如果你要搭建完整的文档分析流程,比如基于内部知识库的 RAG 检索增强问答,可以参考使用场景页面中的详细实现示例。

DeepSeek 的主要限制

任何大模型都有边界,清楚这些限制,才能避免不必要的挫败感。DeepSeek 也不例外,关键有以下几点:

-

可能产生“幻觉”

和所有大语言模型一样,DeepSeek 可能生成听起来合理但事实错误的内容。DeepSeek 在模型算法披露文档中也明确承认这一点。因此,在法律、医疗、金融、合规等对准确性要求极高的领域,模型输出必须经过人工核查,不能直接视为权威结论。 -

API 仅支持文本

生产端点目前不支持图片、音频、视频理解。如果你的业务强依赖视觉内容,需要引入其他视觉模型或自建多模态方案。 -

不适合关键任务或强实时系统

- 输出非确定性:同一提示多次调用可能得到不同答案。

- 响应时间受负载和提示复杂度影响,存在波动。 因此不适合用于要求绝对准确和严格时延的场景,如金融交易撮合、医疗设备控制、工业自动化等。

-

必须有人类监督

DeepSeek 是强大的助手,但不是可以独立负责后果的决策主体。它没有真实世界责任感,也没有问责机制。凡是涉及重大后果的决策(招聘、法律裁决、医疗建议等),都必须由具备资质的人类最终审核。

-

思考模式消耗更多 tokens

思考模式的推理链会显著拉长输出长度。一个在非思考模式下只需 500 tokens 的回答,在思考模式下可能扩展到 5000 tokens。这在大规模调用时会形成实质成本差异。 -

128K 上下文是硬上限

超过约 200 页的文档无法一次性放入同一个请求中,需要通过分块、逐步摘要或 RAG 等方式处理更大规模语料。 -

没有长期记忆

每次 API 调用都是“无记忆”的新会话。若你希望模型延续上下文,需要在请求中显式携带历史对话或关键信息。这有利于隐私,但也意味着你需要自己管理会话状态。

只要对这些边界有清晰预期,DeepSeek 在“语言理解、文本生成和推理辅助”这条主航道上就能发挥很大价值;把它当成“绝对正确的自动决策系统”,则几乎注定会出问题。

DeepSeek API 价格:你实际要付多少钱?

不少第三方文章给出的 DeepSeek 价格已经过时。以下数据均来自 2026 年 4 月核对过的官方 API 定价页面,deepseek-chat 与 deepseek-reasoner 价格完全一致:

- 输入 tokens(缓存未命中):0.28 美元 / 100 万 tokens

- 输入 tokens(缓存命中):0.028 美元 / 100 万 tokens(约 9 折优惠的再打 1 折,即 90% 折扣)

- 输出 tokens:0.42 美元 / 100 万 tokens

其中,缓存命中折扣是成本优化的关键。DeepSeek 会通过上下文缓存系统自动缓存输入前缀:

- 如果你的每次请求都以相同的系统提示开头(例如 2000 tokens 的说明文档和工具定义),

- 那么在第一次调用后,这部分前缀会被缓存,后续请求只按 0.028 美元 / 100 万 tokens 计费。

在结构合理的生产应用中,有效输入成本往往会显著低于标价 0.28 美元。

控制成本的实用建议:

- 对不需要深度推理的任务,优先使用非思考模式,输出更短、tokens 更少。

- 根据预期输出长度设置合适的

max_tokens,避免模型“滔滔不绝”。 - 把系统说明、工具 schema、公共参考资料等放在提示开头,最大化缓存命中率。

- 谨慎使用思考模式,尤其是复杂问题,推理链可能让输出 tokens 增长 5–10 倍。

DeepSeek 还提供免费额度用于评估,网页和 App 端也可以免费体验。若需要更精细的成本估算,可以使用我们的 API 成本计算器,整体价格说明见定价页面。

提升 DeepSeek 输出质量的实用技巧

DeepSeek 的回答是否“好用”,往往取决于你如何提问。有经验的用户普遍遵循以下做法:

-

提示要具体

模糊的问题只会得到模糊的答案。

与其说“帮我看看我们的销售情况”,不如说:“请根据这份报告,总结欧洲地区 Q4 收入的同比增长情况,重点给出各国家的同比百分比变化。”

你越清晰地限定范围、格式和关注点,输出就越可用。 -

把真实上下文给足

DeepSeek 不知道你的内部数据,除非你贴给它。- 要分析文档,就把文档内容放进提示。

- 要评审代码,就把代码贴进去。

不要指望模型自己去“查”或“猜”,所有关键信息都要在提示中显式提供。

-

选对模式

- 复杂分析、数学推理、棘手调试、多步逻辑:用思考模式。

- 日常对话、内容生成、简单问答:用非思考模式。

模式选错,要么浪费 tokens,要么牺牲准确性。

-

调整 temperature

temperature 参数控制输出的随机性:- 0.0–0.3:更稳定、更“严谨”,适合写代码、做事实性回答。

- 0.7–1.0:更有变化,适合创意写作、头脑风暴。

默认值对多数任务已足够,但针对特定场景微调,往往能明显提升效果。

-

必须有人类复核

把 DeepSeek 的输出当作“能力很强但会犯错的助理初稿”。

在任何重要场景中使用前,都要:核实事实、检查推理、根据需要修改润色。实践表明,效果最好的团队几乎都采用“人机协同”的工作流。 -

学会迭代提问

第一次回答不理想,不要立刻放弃,而是:- 补充更多上下文;

- 说明你想要的输出格式;

- 把复杂问题拆成几个小问题。

DeepSeek 对“逐步澄清需求”的响应能力很强。最好的练习方式就是直接在线尝试,多试几种提问方式。

常见问题

(此处可根据实际 FAQ 页面补充具体问答内容,本文不再展开。)

快速上手:现在就试用 DeepSeek

想最快了解 DeepSeek 在真实场景中的表现,最直接的方式就是:在本站直接体验。无需注册账号、无需 API Key、无需安装任何软件,直接提问、用你的实际业务问题测试它的表现。

如果你已经准备把 DeepSeek 集成到自己的应用中,可以参考我们的API 文档,其中涵盖:鉴权方式、端点选择、生产环境最佳实践等。

如果你更倾向于在本地或自有环境中运行 DeepSeek,我们提供了详细的部署指南:

如需查看不同模型的详细规格,请访问模型页面。如果你在寻找带代码示例的完整方案(如 RAG 管线、客服自动化、代码审查等),可以查阅使用场景页面。更多常见问题可参考我们的FAQ。

最后需要强调的是:DeepSeek 的最佳使用方式,是在清晰的人类目标与判断之下,作为协作工具来使用。

它在语言理解、文本生成和推理辅助方面已经非常强大,但真正决定结果质量的,仍然是使用它的人:

- 选对模式;

- 提供清晰、充分的上下文;

- 对输出进行核查和迭代。

本文中的所有规格、价格和功能信息,均基于 2026 年 4 月查验过的官方 API 定价页面、更新日志以及 V3.2 发布说明。模型可用性和价格可能随时间变化,使用前请以官方文档为准。