将 DeepSeek 部署成 API 服务,远不只是“把模型加载起来”这么简单,而是要把模型放到一个稳定、安全、高效的服务框架之下。本文围绕 vLLM、TGI(Text Generation Inference)和 Ollama 三种常见开源推理引擎,讲解如何把 DeepSeek 打造成可在生产环境长期运行的 API 端点,并重点拆解批处理、并发、超时、限流、安全与监控等关键概念。

本文是面向 DeepSeek 的独立参考指南(与文中提到的项目无官方隶属关系),目标是帮助你选型合适的推理引擎,并把它配置到“可靠、可观测、可运维”的状态。具体性能会因硬件和 DeepSeek 具体模型版本而异,但文中的原则在大多数场景下都适用。

什么叫“在生产环境服务 DeepSeek”

在生产环境服务 DeepSeek,指的是通过一个稳定的 API 端点对外暴露 DeepSeek 模型,让应用或用户可以像调用托管云服务一样调用它,而不是在本地交互式地手动跑脚本。

在本地实验时,你可能只是加载一个 DeepSeek 模型,手动输入问题拿结果;而在生产环境中,你需要把模型封装在一个服务进程里,对外提供明确的 API 协议(例如 REST 或 OpenAI 兼容接口),并满足以下要求:

1. 明确的 API 协议与可用性(uptime)

DeepSeek 服务需要:

- 请求/响应格式可预期(通常是 JSON 输入输出);

- 按 SLA 尽量 7×24 可用;

- 出错时返回明确的错误码,而不是直接崩溃退出。

2. 运维与可观测性

一旦进入生产,你就要对服务负责:

- 监控健康状态与性能;

- 需要时扩缩容;

- 安全更新模型与版本;

- 处理故障与回滚。

这要求你具备日志、指标(metrics)和告警体系,能在 DeepSeek 服务退化时第一时间发现问题。

3. 针对 LLM 行为的调优

DeepSeek 可以:

- 生成很长的输出;

- 支持流式输出;

- 接受很大的上下文输入。

因此必须通过“生产级旋钮”来控制: - 批处理(batching);

- 并发上限;

- 流式/非流式模式;

- 请求大小限制等。

例如开启流式输出可以显著降低首 token 延迟,让长文本生成看起来更“跟手”;而限制最大 prompt 长度可以避免单个超大请求拖垮整台机器。

4. 安全默认值

生产就绪还意味着:

- 默认不记录敏感 prompt 内容;

- 对公网暴露时必须有鉴权;

- 设置合理的超时,避免单个慢请求无限占用资源。

总结来说,把 DeepSeek 放到生产环境,就是把它从“实验脚本”变成“可预期的 Web 服务”。这需要在容器、服务框架、配置等方面多做一些前期工作,但这是构建可靠应用的前提。

DeepSeek 推理引擎选型概览

要把 DeepSeek 以 API 形式对外提供,有多种方式。本文聚焦三种常见推理服务器:

- vLLM:高吞吐、针对大模型优化的推理引擎,以先进的批处理和显存利用著称。

- TGI(Text Generation Inference):Hugging Face 出品的生产级推理服务器,广泛用于 Transformer 模型。

- Ollama:轻量级本地模型运行器,API 简单,适合快速上手和原型验证。

三者都能服务 DeepSeek,因为 DeepSeek 使用标准 LLM 格式,社区也经常把它们放在一起做性能对比。选择哪一个,主要取决于你的场景与基础设施:

- 追求极致吞吐和高并发:常选 vLLM;

- 希望有成熟的生产栈与 Hugging Face 生态:倾向 TGI;

- 只想快速跑起来、本地或低流量场景:Ollama 足够好用。

不存在绝对“最强”的方案,只有更适合你当前需求的组合。

DeepSeek 生产部署必须吃透的几个概念

大模型上生产会遇到一系列特有挑战。下面这些概念是你必须搞清楚并配置好的关键点。

1. DeepSeek 批处理(Batching)

批处理指把多条请求合并成一个大批次送进模型,以更好地利用 GPU。DeepSeek 模型体积大,只有在高 GPU 利用率下才能发挥性价比,批处理正是实现这一点的核心手段。

vLLM、TGI 等框架都支持连续批处理(continuous batching):

- 动态把不断到来的请求拼成一个大 batch;

- 尽量把 GPU 填满再执行一次前向计算;

- 极大提升整体吞吐,而不是一条条小请求让 GPU 闲置。

例如,3 个用户几乎同时发来请求,批处理引擎可以把它们合并成一个 batch,一次前向就服务 3 个请求,摊薄了调度和内存开销。

作为 DeepSeek 运维者,你需要调节:

- 最大 batch 大小(按请求数或 token 数);

- batch 等待时间(为等更多请求而等待的时间)。

目标是在不显著增加延迟的前提下,尽量提高 batch 利用率:

- batch 太大:延迟高、容易 OOM;

- batch 太小:GPU 利用率低、吞吐浪费。

实践中可以先用默认值,但不要指望它们自动适配你的 GPU。尤其在 TGI 中,总 token 预算、batch token 上限等参数往往需要根据显存和目标延迟/吞吐手动调优。重点关注 p95/p99 延迟,确保长文本请求不会把其他请求长期堵在队列里。

2. DeepSeek 并发(Concurrency)

并发是指 DeepSeek 同时能处理多少请求。与普通 Web 服务不同,一条 LLM 请求可能独占一整块 GPU 很长时间。

需要区分两层并发:

-

单进程内的并发(线程/协程级)

- 某些服务器允许在同一个模型实例上并行生成,只要显存还有余量。

- 例如 Ollama 会在显存足够时并行处理多条请求。

- 但每条并发请求都需要自己的上下文缓存,DeepSeek 上下文窗口又很大,2~4 条并发就可能让显存占用成倍增加。

- 显存不足时,服务器会把新请求排队。

-

多实例并发(进程/副本级)

- 通过多进程或多容器运行多个 DeepSeek 实例,配合负载均衡实现水平扩展。

- 比如起 3 个 DeepSeek-7B 副本挂在同一个负载均衡后面,理论上吞吐可以接近 3 倍。

有效的并发管理还包括:

- 请求队列与**背压(backpressure)**机制;

- 当系统过载时,要么排队,要么快速拒绝,而不是无限接单。

例如:

- Ollama 在队列过长时会返回 503 Overloaded;

- vLLM 更倾向于接收大量请求交给调度器批处理,如果不在外层限流,可能导致排队时间过长。

因此你通常需要:

- 在推理引擎或网关层设置并发上限(如最多 8 个并发请求);

- 或者通过 API 网关做限流(后文“限流”部分会展开)。

目标是:让 DeepSeek 高负载运行,但不要接下自己无法在合理时间内完成的工作。

3. DeepSeek 超时(Timeouts)

超时保护的是客户端和服务端两端。

一条 DeepSeek 请求可能:

- 因网络或 bug 卡住;

- 因 prompt 导致“永无止境”的故事输出;

- 或者因为搜索/解码策略过慢。

你需要两类超时:

-

客户端超时

- 调用方应设置合理的请求超时时间(如 30s 或 60s),超时后放弃等待;

- 具体值取决于业务:短问答可能 10s 足够,长代码生成可能需要 1 分钟;

- 流式模式下,通常会:

- 对“首字节时间”设较短超时(如 5s 内必须开始流);

- 对整次会话设更长总超时(如 30s~60s)。

-

服务端超时

- 某些推理框架支持为单次生成设置最大运行时长;

- 超过时可以中断生成并返回部分结果或错误;

- 即便框架不支持,也可以在 API 包装层实现;

- 同时建议限制每次请求的

max_tokens,避免无界生成。 - TGI 就支持为每个请求设置最大 token 数,从而限制运行时间。

合理的超时和限制可以防止“一条异常请求拖垮所有人”。上线前,务必用极端长 prompt、超长输出等场景压测,观察服务行为再调整参数。

4. DeepSeek 限流(Rate Limits)

当 DeepSeek API 面向多个客户端甚至公网时,限流是必需的。否则:

- 单个用户或 bug 可能疯狂打请求;

- 资源被耗尽,导致高延迟甚至崩溃。

常见做法:

- 在 API 网关或负载均衡层限流,而不是在 LLM 服务器内部;

- 使用 Nginx、Traefik、Envoy 或云厂商 API Gateway;

- 按 IP、API Key 或用户维度限制:

- 每分钟请求数(requests/min);

- 或每分钟 token 数(tokens/min)。

超限时返回 HTTP 429(Too Many Requests),并可带上 Retry-After 头,提示客户端稍后重试。这样可以:

- 平滑流量峰值;

- 保护 DeepSeek 推理后端不被突发流量压垮;

- 促使客户端实现更健康的调用模式。

如果暂时没有网关,也可以在自建服务层做简单计数限流。vLLM 支持配置 API Key,但本身不做速率限制,限流逻辑仍需你自己实现。

5. DeepSeek 重试(Retries)

客户端调用 DeepSeek 时,重试要慎用。

可安全重试的典型情况:

- 网络超时;

- 503 Overloaded 等明显“没处理成功”的错误。

这类错误通常说明请求还没真正进入模型推理阶段,稍后重试问题不大。

不宜盲目重试的情况:

- DeepSeek 已经部分处理过请求;

- 或因客户端超时主动取消,但服务端仍在生成。

此时重试可能造成重复工作,甚至语义重复。

可以考虑:

- 设计幂等策略:为每个请求分配唯一 ID,若同一 ID 再次到达,服务端识别并避免重复处理;

- 现实中完全幂等较复杂,通常会退而求其次:

- 只对特定状态码(如 429、503、网络超时)做有限次数重试;

- 对 400、500 等错误则需要人工排查或修复后再发起新请求。

还要警惕重试风暴:

- 当 DeepSeek 变慢时,所有客户端超时后一起重试;

- 结果是负载翻倍甚至指数级放大。

避免方式: - 客户端超时设置略高于正常 p95 延迟;

- 重试时使用指数退避(exponential backoff);

- 严格限制最大重试次数(如最多重试 2 次)。

总体原则:优先通过限流与扩容解决问题,而不是依赖重试来“赌运气”。

6. DeepSeek 日志(Logging)

LLM 服务的日志要在“可排障”和“隐私安全”之间平衡。

建议至少记录:

- 时间戳;

- 请求 ID;

- 响应时间;

- HTTP 状态码;

- 生成 token 数等基础参数。

例如:记录请求abc123用时 2.3s,返回 200,生成 150 个 token。

不建议默认记录:

- 完整 prompt 内容;

- 完整模型输出。

DeepSeek 常用于处理敏感数据,原文日志会带来严重隐私与合规风险。若确实需要排查某个具体请求,可临时开启更详细日志,并在问题解决后删除或脱敏。

同时注意日志体量:

- 高 QPS 场景下,大量日志写入本身会成为 IO 瓶颈;

- 推荐使用结构化日志(如 JSON),方便按条件过滤(只看错误、只看高延迟等)。

总之:日志要“聪明地记”——足够排障,但不过度暴露数据,也不拖慢系统。

7. DeepSeek 指标与监控(Metrics & Monitoring)

在生产环境,指标是理解 DeepSeek 行为的核心工具。关键指标包括:

- 延迟(Latency):中位数、p95、p99 等。LLM 延迟通常“长尾”明显:大部分请求 2s 内完成,少数可能 15s 以上。可以按 prompt 长度、生成 token 数等维度拆分。

- 吞吐/QPS:每秒请求数或每秒 token 数,用于容量规划。

- GPU 利用率与显存占用:

- 利用率过低:可能批处理或并发配置不佳;

- 显存长期打满:可能需要降并发、减小 batch 或换更大显存/做量化。

- 请求队列长度:

- 如 vLLM 的

/metrics中会暴露队列长度; - 队列持续增长通常意味着服务处理不过来,延迟会同步升高。

- 如 vLLM 的

- 错误率与状态码分布:

- 5xx:服务端错误,需重点排查(OOM、bug 等);

- 4xx:客户端问题(参数错误、限流等);

- 429/503 高企:说明限流或过载频繁发生,需要评估是否扩容或调整策略。

TGI 自带 Prometheus 指标,并可集成 OpenTelemetry;vLLM 也提供指标接口,甚至支持基于优先级的调度。若环境本身没有指标系统,可以在应用层埋点,配合 Prometheus + Grafana 做可视化,并对关键指标设置告警(如“p99 延迟 > 30s 持续 5 分钟”或“错误率 > 5%”)。

总体思路:把 DeepSeek 当成关键基础服务来监控——延迟、吞吐、资源、错误一个都不能少。

如何为 DeepSeek 选择推理引擎(决策思路)

理解了上述概念后,回到核心问题:在 vLLM、TGI、Ollama 之间如何选?可以按以下思路:

-

优先级是极致性能与扩展性

- 典型场景:大量并发用户、高 token/s 要求;

- 推荐:vLLM。

- 优势:

- PagedAttention、连续批处理等优化,在大模型高负载场景表现突出;

- 能充分压榨高端 GPU 的吞吐;

- 提供 OpenAI 风格 HTTP API,方便与现有客户端对接。

- 代价:

- 需要你自己处理扩缩容、编排与网关(如挂在负载均衡后,或用 Ray Serve 做自动扩缩容)。

-

希望有成熟、开箱即用的生产服务器,并深度使用 HF 生态

- 推荐:TGI(Text Generation Inference)。

- 特点:

- 为 Llama、Falcon 等模型设计的生产级推理服务器,DeepSeek 也能很好运行;

- 提供官方 Docker 镜像、环境变量配置、OpenAI 兼容端点、内置指标等;

- 支持量化加载(bitsandbytes)、丰富解码策略等。

- 注意:

- Hugging Face 文档指出,TGI 自 2025-12-11 起进入维护模式,仅接受小型修复与文档更新;

- HF 官方在推理端点上更推荐 vLLM、SGLang 等新引擎;

- 目前仍然是可用的生产方案,但长期要关注替代方案演进。

-

追求极简、快速上手或小规模内部使用

- 推荐:Ollama。

- 优势:

- 从零到可用 DeepSeek API 通常只需几分钟;

- 适合个人开发机、单机内部工具、Demo 等;

- 自动拉取模型、内置简单队列、REST API 简单易用。

- 局限:

- 性能与可扩展性不如 vLLM;

- 多机扩展需要手工搭建。

在一些复杂场景中,你甚至可以组合使用:

- 例如用 vLLM 作为底层推理引擎,再用 Ray Serve/TorchServe 等做编排、鉴权、路由;

- 或用 TGI 做多模型托管,统一暴露接口。

选型时务必确认:

- 引擎是否支持你手头的 DeepSeek 模型格式(如是否有 MoE 或特殊结构);

- 你的硬件与驱动是否满足要求(vLLM/TGI 通常需要 NVIDIA GPU,Ollama 可在 CPU/Mac 上跑小模型);

- 团队经验:若大家都熟悉 HF 工具链,TGI 的上手成本会更低;若更熟悉 OpenAI API 生态,vLLM 的兼容接口会更顺手。

总之:vLLM 适合大规模高性能,TGI 适合成熟生产栈,Ollama 适合简单快速起步。 只要 API 层抽象得足够好,后端引擎是可以在未来替换的。

在自建之前,不妨先对比一下预期流量与托管 API 的成本,可参考官方 DeepSeek 定价页面。对于突发或中等负载,按 token 计费的托管 API 往往比自建 GPU 更简单、甚至更便宜;而当流量长期稳定且较大时,自建推理服务才更有经济性。

DeepSeek API 协议与客户端兼容性

选择好推理引擎后,下一步是确定对外暴露的 API 形态。理想状态是:

- 客户端调用 DeepSeek 的体验,与调用 OpenAI API 尽量一致;

- 这样可以直接复用大量现有 SDK 与工具。

幸运的是:

- vLLM、TGI 都提供 OpenAI 兼容端点;

- Ollama 也有自己的原生 HTTP API,并额外提供部分 OpenAI 兼容层。

OpenAI 兼容 API(vLLM / TGI)

- vLLM 提供 OpenAI 风格的 HTTP 服务器(Chat/Completions 等路由);

- 大多数 OpenAI 客户端只需改 base URL 和 API Key 即可使用;

- 需要注意:

- 工具调用/函数调用、流式语义等边缘特性是否完全兼容,要结合版本测试;

- TGI 同样支持 OpenAI 格式的聊天与补全接口;

- 这意味着你可以把 DeepSeek“伪装成”一个自建的 OpenAI 风格服务。

自定义 API(Ollama)

Ollama 的原生 REST API 与 OpenAI 格式不同:

- 主要端点:

/api/generate:单轮文本生成;/api/chat:多轮对话;- 以及模型管理相关端点(拉取、列出等)。

- 请求/响应是 Ollama 自己的 JSON 结构:

- 字段如

model、prompt或messages; - 以及

stream: true/false等选项。

- 字段如

如果你需要 OpenAI 风格兼容:

- Ollama 也在

/v1路径下提供部分 OpenAI 兼容接口; - 对于不完全覆盖的特性,可以在前面加一层轻量适配服务:

- 接收 OpenAI 形状的请求;

- 转换为 Ollama 原生

/api请求; - 统一处理差异与错误。

流式与非流式

三种引擎都支持流式 token 输出:

- OpenAI 规范使用 HTTP SSE(Server-Sent Events)流式返回 token;

- vLLM、TGI 都实现了这一模式;

- Ollama 则通过

stream: true参数返回增量结果。

设计 DeepSeek API 使用方式时,需要决定:

- 用户是否需要流式体验;

- 是否所有场景都要流式,还是只在交互式界面开启。

一般建议:

- 面向终端用户的交互应用:强烈推荐流式,首 token 快,体验好;

- 纯后端批处理或需要完整结果的场景:可用非流式,逻辑更简单。

同时要确保:

- HTTP 栈与中间代理支持流式,不要在中间被缓冲或截断;

- 某些负载均衡器需要额外配置才能正确透传流式响应。

错误处理与状态码

DeepSeek API 应遵循标准 HTTP 语义,常见状态码包括:

200 OK:请求成功,返回生成结果;400 Bad Request:参数错误、prompt 过长等;401/403:鉴权失败或未授权;429 Too Many Requests:触发限流;503 Service Unavailable:临时过载或模型未加载完成。

客户端应针对不同状态码做不同处理:

- 503 可考虑带退避的重试;

- 400 则说明请求本身有问题,应修正后再发。

请求大小限制

为了保护 DeepSeek 服务,必须限制:

- 输入长度(prompt token 数);

- 输出长度(

max_tokens); - 以及两者之和的总 token 预算。

原因:

- 超长 prompt 与超长生成会显著增加显存占用(尤其是 KV Cache);

- 在高并发下容易导致 OOM 或极端长尾延迟。

实践建议:

- 根据模型上下文长度与硬件能力,明确:

- 最大输入 token 数;

- 最大输出 token 数;

- 或最大总 token 数(输入 + 输出)。

- 超出限制时返回 400,并附带清晰的错误信息。

TGI 提供显式的服务端参数来限制:

- 最大输入 token;

- 单请求最大 token 预算。

vLLM、Ollama 等则通常需要在:

- 网关/反向代理层;

- 或自建应用包装层中实现请求大小校验与拒绝逻辑。

通过这些限制,可以显著降低:

- 显存耗尽风险;

- 极端长尾延迟;

- 并发场景下的性能不可预期性。

调用示例:OpenAI 风格 DeepSeek 服务

假设你用 vLLM 或 TGI 暴露了一个 OpenAI 风格的 DeepSeek 端点,可以像下面这样调用:

curl -X POST https://YOUR_DEEPSEEK_SERVER/v1/completions \

-H "Authorization: Bearer YOUR_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "DeepSeek-7B",

"prompt": "Hello, how can I use DeepSeek as an API?",

"max_tokens": 100,

"temperature": 0.7,

"stream": false

}'

这会触发 DeepSeek-7B 模型生成一段补全结果。若把 stream 设为 true,则会以流式事件的方式逐步返回 token。

关键点在于:客户端不需要知道背后跑的是 DeepSeek 还是别的模型,只要 API 协议保持一致即可。未来从 DeepSeek-v3 升级到 DeepSeek-R1-distill,也可以在服务端切换模型 ID 或加载新权重,而对客户端保持透明。

适合 DeepSeek 的部署模式

具体如何部署 DeepSeek,要看你的规模与基础设施。下面是几种常见模式。

1. 单机部署(Standalone)

最简单的方式是在一台机器上运行 DeepSeek 服务:

- 物理机或云主机均可;

- 确保 GPU、驱动与内存满足模型需求;

- 通过 Docker 运行 vLLM/TGI,或直接运行 Ollama。

单机适合:

- 初期试用;

- 小规模内部应用。

为了更稳健,建议:

- 使用进程管理器(systemd、Docker restart policy 等)自动拉起服务;

- 前面加一层 Nginx 等反向代理:

- 做 TLS 终止(HTTPS);

- 控制请求大小;

- 可选 gzip 压缩等。

在单机上也可以跑多个 DeepSeek 副本:

- 例如两份 vLLM 实例,各自加载同一模型;

- 再用本地代理做简单负载均衡。

2. 容器化部署

强烈建议将 DeepSeek 推理服务容器化:

- TGI 有官方 Docker 镜像;

- vLLM 也有社区或官方镜像;

- GPU 场景使用 NVIDIA Container Runtime。

容器化的好处:

- 依赖环境可复现;

- 版本可固定(推理引擎与模型版本);

- 方便迁移到 Kubernetes 等编排系统。

你可以:

- 自建镜像,把 DeepSeek 权重打包进去,避免每次启动都重新下载;

- 或者通过挂载卷(volume)共享模型文件。

3. Kubernetes / 其他编排系统

当你需要高可用与弹性扩缩容时,Kubernetes 是常见选择:

- 每个 DeepSeek 推理实例(vLLM/TGI/Ollama)作为一个 Pod;

- 使用 Deployment 管理副本数;

- 通过 Service/Ingress 暴露 API。

关键配置点:

资源请求/限制

- 为 Pod 设置合理的 CPU、GPU、内存 request/limit;

- 例如:1 块 GPU + 16GB 内存跑 13B 模型等。

存活/就绪探针(Liveness/Readiness Probes)

- Readiness:只有在模型加载完成、服务真正可用后才对外接流量;

- Liveness:在进程卡死时重启容器;

- 注意不要把“长时间推理”误判为“进程挂死”,探针要设计合理。

水平扩缩容(HPA 或自定义)

- CPU 利用率对 GPU 应用参考价值有限;

- 更好的做法是基于:

- 吞吐;

- 队列长度;

- 或自定义指标扩缩容;

- 确保扩容时新 Pod 先 Ready,再缩容旧 Pod,避免无模型可用的空窗期。

模型持久化存储

- 若不把模型打进镜像,需要:

- 使用快速持久卷(SSD/PVC);

- 或用 init 容器在启动时下载模型;

- 模型加载时间往往是冷启动瓶颈,要提前规划(可保留“预热”副本)。

多副本 + 负载均衡

- 当单实例不够用时,起多个副本并通过负载均衡分流;

- 注意会话粘性问题:

- 若对话上下文完全放在 prompt 中(无服务端会话状态),则无需粘性;

- 若在服务端维护会话状态,则需要确保同一会话路由到同一实例。

CI/CD 与配置管理

- 把 DeepSeek 服务当作普通应用管理:

- 配置(batch 大小、超时等)通过配置文件或环境变量管理;

- CI 构建镜像并做基本健康检查(加载模型、跑一条测试请求);

- 部署时使用滚动更新,避免停机。

冷启动与预热

- 大模型加载可能需要几十秒甚至几分钟;

- 可通过:

- 启动后自动发送一次简单请求做预热;

- 保持至少一个“热备”副本常驻;

- 在负载均衡层只把 Ready 的 Pod 加入流量池。

总体而言,DeepSeek 的部署模式与常规 Web 服务类似,只是要额外关注:

- GPU 管理;

- 模型加载时间;

- 显存与并发的平衡。

DeepSeek 服务的安全基础

无论是内部还是对公网,DeepSeek 服务都可能处理敏感数据,因此安全必须前置考虑。

鉴权与授权

不要把 DeepSeek 推理端点裸露在公网或不可信网络上。

- vLLM 的 OpenAI 兼容服务器支持通过

--api-key或环境变量配置 API Key; - 客户端需在请求头中携带

Authorization: Bearer; - 但要注意:

- vLLM 内置的 API Key 保护只覆盖其 OpenAI 兼容端点;

- 不应把它当作完整安全边界。

生产环境中,仍然建议在前面加一层网关/反向代理:

- Nginx、Traefik、Envoy 或云 API Gateway;

- 在网关层统一做:

- TLS 终止;

- 鉴权与 API Key 校验;

- 限流与请求大小控制;

- 日志与审计。

若推理引擎本身不带鉴权能力:

- 可在网关层验证

Authorization头; - 或集成 JWT/OAuth 等统一认证体系;

- 内网部署也建议做显式鉴权,便于审计与密钥轮换。

TLS(HTTPS)

跨网络访问时,务必使用 HTTPS:

- 可在负载均衡或反向代理层终止 TLS;

- 后端 DeepSeek 服务用 HTTP 即可;

- TLS 可以防止 prompt 与输出在传输中被窃听或篡改。

网络暴露与防火墙

- 内部服务尽量绑定在内网地址或 VPN 网络;

- 云环境中使用安全组/ACL 限制访问来源;

- 只开放必要端口给必要的上游服务;

- 若必须对公网开放 Demo,务必放在网关后面,并配合 WAF、限流等防护。

输入校验与隐私

- 对请求体大小做限制(前文已述);

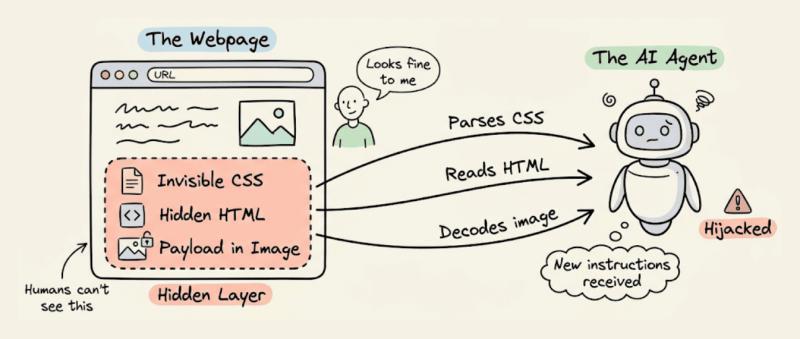

- 对明显异常的 payload 做基本过滤;

- 对 prompt 注入等 AI 特有攻击,要通过:

- 限制模型可调用的外部工具;

- 不让模型直接执行代码或访问敏感系统。

日志与隐私方面:

- 默认不要在日志中记录完整 prompt/输出;

- 若必须记录,需:

- 严格控制访问权限;

- 考虑加密存储;

- 尽量脱敏(去除 PII)。

最小权限与隔离

- 以最小权限运行 DeepSeek 服务进程:

- 不要给容器 root 权限;

- 限制文件系统与网络访问范围;

- 使用容器时,关闭不必要的 Linux capabilities;

- 及时更新依赖与基础镜像,修补安全漏洞。

滥用防护

除了限流,还要考虑“能被用来做什么”:

- 是否可能被用来生成违法或违规内容;

- 是否需要在输出后加一层内容审核(规则或审核模型);

- 是否需要在使用条款中明确禁止某些用途。

同时要防范“资源型攻击”:

- 如大量接近上限长度的 prompt;

- 或专门构造让模型输出极长文本的 prompt。

前文提到的请求大小限制、超时与限流,都是应对这类攻击的基础手段。

总结一句:把 DeepSeek 服务当成“内部数据库或敏感 API”来对待——最小暴露面、强鉴权、全程监控。

DeepSeek 常见生产故障模式与应对

即便遵循了最佳实践,生产环境仍可能出现各种问题。下面列出几类常见故障及缓解思路。

1. OOM(内存溢出)或内存泄漏

症状:

- DeepSeek 进程在请求过程中或加载模型时被 OOM Kill;

- 日志中出现 CUDA OOM 或显存不足错误;

- 容器频繁重启。

成因:

- 模型本身超过 GPU 显存能力;

- 并发请求过多,KV Cache 等占用爆炸;

- 长期运行导致内存碎片或泄漏。

缓解:

- 确认硬件是否足够:

- 必要时换更大显存 GPU;

- 或启用 CPU offload、量化模型(如 int4、int8);

- 在高峰期 OOM:

- 降低并发或 batch 大小;

- 调整最大 token 预算;

- 定期重启服务(如每日)以清理碎片或潜在泄漏。

2. 长尾延迟与队列堆积

症状:

- 大部分请求很快返回,但少数请求极慢;

- p99 延迟很高;

- 队列长度持续上升。

常见原因:

- 少数超大请求(超长 prompt 或超大

max_tokens); - 整体负载略超出系统能力,导致排队。

缓解:

- 引入优先级或时间片调度:

- 短请求优先,避免被长请求“堵死”;

- vLLM 已支持一定程度的优先级调度;

- 按用例拆分实例:

- 一组实例专门处理短交互请求;

- 另一组处理长文本生成;

- 严格限制单请求最大 token 与运行时间;

- 若整体过载,则增加副本或扩容硬件。

3. 生成卡住或极慢(无 token 输出)

症状:

- 请求被接受,但长时间没有任何输出;

- GPU 利用率可能很低,服务看起来“挂住”。

缓解:

- 首先区分“真的卡死”还是“只是很慢”:

- 若 GPU 利用率高,可能只是计算复杂;

- 若 GPU 几乎空闲且无输出,可能是进程死锁或 bug;

- 使用:

- 服务端生成超时(如 60s);

- 超时后中断生成并返回错误或部分结果;

- 启用流式输出,让用户看到逐步生成过程;

- 对已知的“病态 prompt”做特殊处理或限制;

- 配置 liveness 探针或看门狗线程,在进程长时间无响应时自动重启。

4. 过载尖峰(Thundering Herd)

症状:

- 平时运行正常,但在某些时间点(如 9 点统一登录)突然大量请求涌入;

- 响应极慢或大量 503;

- 尖峰过去后又恢复正常。

缓解:

- 事先配置好限流:

- 在尖峰时快速拒绝超出能力的请求,而不是全部排队;

- 若能预估尖峰时间:

- 提前扩容副本或提升实例规格;

- 若尖峰不可预测:

- 使用基于队列长度或延迟的自动扩缩容;

- 但要考虑新实例冷启动时间;

- 实现队列超时:

- 若请求在队列中等待超过 X 秒,直接返回错误,避免无限排队。

5. 超时与重试配置不当

症状:

- 客户端经常在模型刚要返回时就超时;

- 负载均衡器提前断开连接;

- 重试逻辑导致重复请求,放大负载。

缓解:

- 统一梳理各层超时配置:

- 客户端 SDK;

- 反向代理/网关;

- 推理服务本身;

- 客户端超时应略高于正常 p95 延迟;

- 流式场景下,确保中间代理不会因“长时间无数据”而断开连接,可使用心跳或 keep-alive;

- 重试必须:

- 有上限;

- 有退避;

- 只针对特定错误码;

- 在日志中使用请求 ID,便于识别重复请求与重试行为。

更多具体故障与排查思路,可参考专门的 DeepSeek 故障排查指南。通常解决方案都是前文概念的组合:

- 通过批处理与限流避免 OOM;

- 通过扩容与优先级调度缓解长尾延迟;

- 通过合理超时与重试策略避免连锁故障。

什么时候不必上“重型”生产部署

并不是所有人都需要复杂的生产级架构。在一些场景下,给 DeepSeek 搭一整套高可用集群反而是过度设计。

个人或研究用途

- 单人或小团队做研究;

- 请求频率不高、对可用性要求不严格。

此时完全可以:

- 在 Jupyter Notebook 或脚本中直接加载模型;

- 或用 Ollama 命令行/本地服务简单调用;

- 不必为鉴权、扩缩容等投入太多精力。

小规模内部应用

- 内部工具,每次最多一两条并发请求;

- 用户数有限。

可以:

- 在一台服务器上跑单实例 TGI 或 vLLM;

- 或使用更轻量的后端(如 llama.cpp)跑小模型;

- 甚至用量化后的 7B DeepSeek 在 CPU 上跑,牺牲一些速度换来部署简单。

资源受限场景

- 主要瓶颈是显存/算力不足;

- 与其搭多机多 GPU 集群,不如先“瘦身模型”:

- 量化(int4/int8);

- 蒸馏到更小模型。

很多业务场景下,中等大小、量化后的 DeepSeek 模型已经足够好:

- 可以在单 GPU 甚至 CPU 上稳定运行;

- 避免复杂的多 GPU/多节点编排;

- 整体成本与运维难度更低。

对延迟不敏感的离线任务

- 例如生成报告、离线分析、批量处理文本;

- 不需要实时响应用户。

这类场景完全可以:

- 用批处理作业方式运行 DeepSeek;

- 任务开始时加载模型,处理完一批数据后释放资源;

- 不必常驻一个 7×24 的在线服务。

总之:不要一上来就过度工程化。如果简单方案能满足当前需求,就从简单方案开始;随着需求增长,再逐步演进到完整的生产架构。

总结

要把 DeepSeek 打造成一个真正可用的生产服务,需要:

- 选对推理引擎(vLLM、TGI、Ollama 等);

- 配好一系列“看起来很无聊”的生产参数:批处理、并发、超时、限流、安全、监控等。

核心要点回顾:

-

选型匹配场景:

- vLLM:追求极致吞吐与大规模并发;

- TGI:成熟生产栈与 HF 生态;

- Ollama:简单、快速、本地或小规模场景。

-

调好生产旋钮:

- 合理的批处理与并发上限;

- 开启流式输出以优化体验;

- 严格的请求大小与超时限制;

- 完整的日志与指标体系。

-

默认安全与可观测:

- 必须有鉴权与 TLS;

- 谨慎处理日志与隐私;

- 持续监控延迟、吞吐、资源与错误,及时告警与调优。

DeepSeek 是一款强大的大模型,只要配上合适的推理引擎与生产实践,就能稳定支撑从小型内部工具到大规模在线服务的各种应用。部署只是起点,后续持续的监控、调优与演进,才是让 DeepSeek 真正“跑在生产上”的关键。