在 Windows 本地运行 DeepSeek 是可以做到的,但选错方案,很容易从“玩模型”变成“修电脑”。这篇非官方独立指南,专门回答:DeepSeek 能不能在 Windows 上跑、该怎么跑、以及不同路线各自的坑和适用场景。

需要先说明的是:实际效果高度依赖你的硬件(CPU / GPU)、显存、驱动版本和对系统的熟悉程度。下面会从 WSL2 与原生 Windows 的取舍讲起,再到 Ollama / llama.cpp 这类“傻瓜式”工具、GPU 支持差异、常见报错排查,以及本地隐私安全注意事项。

范围说明:多数人跑的不是完整 DeepSeek-R1

在 Windows 上跑 DeepSeek,绝大多数人用的并不是完整的 DeepSeek-R1,而是:

- DeepSeek-R1 的蒸馏版 checkpoint

- 或者经过量化的 GGUF 等格式

原始的 DeepSeek-R1 是超大规模 Mixture-of-Experts 模型,主要面向数据中心级别的基础设施。本地 Windows 环境更现实的做法,是使用:

- 官方提供的 DeepSeek-R1 蒸馏 checkpoint

- 或者通过 GGUF 等量化格式,配合 Ollama、llama.cpp、Hugging Face Transformers 等工具运行

本文重点讨论这些“适合消费级硬件”的本地部署路径,而不是数据中心级完整模型。

本文主要内容

- WSL2 vs 原生 Windows:哪种环境更适合跑 DeepSeek

- 什么时候直接用 Ollama、llama.cpp 这类“傻瓜工具”更省心

- NVIDIA 与 AMD 在 Windows 上的 GPU 支持现状(CUDA / ROCm)

- DeepSeek on Windows 常见问题速查表(症状 → 可能原因 → 首步解决)

- 在 Windows 本地跑 DeepSeek 时的隐私与安全注意事项

快速结论:DeepSeek 能在 Windows 上跑吗?

可以。常见的三条路线是:

-

纯 CPU(不使用 WSL2)

- 直接在 Windows 上用 CPU 跑 DeepSeek,不需要 Linux。

- 几乎任何现代 Windows 电脑都能跑,但大模型会非常慢。

- 适合:小模型、功能测试、体验为主。

- 工具:LM Studio、简单 CLI 推理工具等,都可以直接在 Windows CPU 上加载 DeepSeek。

- 优点:兼容性最好、安装最简单;缺点:速度最慢。

-

NVIDIA GPU(常配合 WSL2 使用)

- 有 NVIDIA 显卡时,最常见的做法是通过 WSL2 + CUDA 跑 Linux 环境里的 DeepSeek。

- NVIDIA 官方支持 WSL 上的 CUDA,WSL2 里的 Linux 程序可以像在原生 Linux 一样调用 GPU。

- 可以在 WSL2 里用 PyTorch、Transformers、vLLM 等框架跑 DeepSeek。

- 优点:兼容 Linux 生态、性能接近原生 Linux;缺点:需要折腾 WSL2 与驱动。

-

AMD GPU(支持情况更不稳定)

- 理论上可以在 Windows 上用 AMD GPU 跑 DeepSeek,但稳定性和兼容性明显不如 NVIDIA。

- AMD 提供了 HIP SDK、PyTorch on Windows 等路径,但是否可用高度依赖具体显卡与驱动版本。

- 实际上,很多用户会退而求其次:

- 用 CPU + 量化模型

- 或者干脆在 Linux(含 WSL2)下折腾 ROCm

一句话总结:

- 只用 CPU:任何机器都能跑,但要有“很慢”的心理准备。

- NVIDIA GPU:在 Windows 上跑 DeepSeek 最顺畅的路线,通常配合 WSL2。

- AMD GPU:能跑,但路径更碎片化、依赖具体硬件和驱动,心态要稳。

Windows 选路小决策树

不确定从哪条路开始?可以按下面几种典型诉求来选:

1.「我只想最快上手,不想搞运维」

优先选:打包好的本地 LLM 应用。

- 推荐:

- 特点:

- 安装包一键装好,大部分运行时依赖都打包好了。

- Ollama 里,下载并运行模型通常只要一条命令。

- 能自动根据硬件选择 CPU / GPU,省去大量配置工作。

- 代价:

- 对底层环境控制力较弱,深度定制能力有限。

2.「我要做二次开发 / 深度集成 DeepSeek」

优先选:WSL2 + Linux 环境。

- 适合:

- 熟悉命令行、打算写脚本或搭建服务端 API 的开发者。

- 原因:

- DeepSeek 相关开源代码和生态默认面向 Linux + NVIDIA GPU。

- WSL2 提供完整 Linux 用户态环境,基本等同于在 Ubuntu 上开发。

- 典型操作:

- 安装 WSL2 + Ubuntu

- 在 WSL2 里装 Python / Docker / PyTorch / Transformers / vLLM 等

- 把 DeepSeek 当作 Linux 模型来部署

3.「我有 GPU,想要速度优先」

- NVIDIA:

- 尽量走 CUDA 路线:

- 原生 Windows 安装 CUDA + PyTorch

- 或者更推荐:WSL2 里用 Linux 版 CUDA(兼容性更好)

- 尽量走 CUDA 路线:

- AMD:

- 先查你的显卡是否在 ROCm on WSL2 支持列表 中。

- 若支持,可尝试按 AMD 官方文档在 WSL2 中配置。

- 若不支持,优先考虑:

- CPU + 量化模型

- 或者换 NVIDIA 显卡 / 单独装 Linux。

4.「我最怕各种奇怪报错,只想少踩坑」

- 有 NVIDIA:

- 社区共识路线是 WSL2 + Linux 工具链。

- 这条路被大量用户验证过,NVIDIA 官方也推荐在 Windows RTX 上用 WSL2 跑 AI。

- 没有 GPU:

- 直接用 Ollama、LM Studio 这类工具 + 量化模型。

- 选别人已经验证过的模型与配置,少自己拼环境。

在 WSL2 上跑 DeepSeek:多数 Windows 开发者的推荐基线

对很多开发者来说,WSL2 是在 Windows 上跑 DeepSeek 的“默认推荐方案”,原因主要有三点:

-

完整 Linux 环境

- 开启 WSL2 并安装 Ubuntu 等发行版后,你就拥有:

- APT 包管理

- Linux 版 Python / pip

- Linux 优先支持的 AI 工具链

- 大部分 LLM 工具(PyTorch、Transformers、vLLM、llama.cpp 工具链等)的官方文档都默认你在 Linux 上。

- 在 WSL2 里基本可以“照抄 Linux 教程”,成功率远高于原生 Windows。

- 开启 WSL2 并安装 Ubuntu 等发行版后,你就拥有:

-

CUDA GPU 支持成熟(NVIDIA)

- 有 NVIDIA 显卡时,WSL2 可以通过 CUDA for WSL 直接调用 GPU。

- 需要做的事:

- 在 Windows 装支持 WSL 的最新 NVIDIA 驱动

- 在 WSL2 里装好 CUDA 相关依赖(或直接用带 CUDA 的 PyTorch)

- 配置完成后,在 WSL2 里跑 DeepSeek,性能通常接近原生 Ubuntu。

- 小技巧:在 WSL2 终端里运行

nvidia-smi,确认 GPU 是否被识别。

-

性能开销小

- WSL2 使用真实 Linux 内核,虚拟化开销相对较小。

- 对多数推理场景,GPU 性能可以做到“接近原生 Linux”。

- 可通过

.wslconfig调整 WSL2 可用内存和 CPU 核心,避免资源不足。

典型配置清单:

- 系统:Windows 11(推荐)或 Windows 10 2004+,开启 WSL2

- 安装 Ubuntu 等 Linux 发行版:PowerShell 中执行

wsl --install - 在 WSL2 内:

- 安装 Python / pip / 常用开发工具

- 安装 CUDA 版 PyTorch、Transformers、vLLM 等

- 下载 DeepSeek 模型或克隆相关仓库

- 有 NVIDIA GPU 时:

- 在 Windows 侧安装支持 WSL 的最新 NVIDIA 驱动

- 在 WSL2 内用

nvidia-smi检查 GPU

整体体验:像在 Linux 上跑 DeepSeek,只是宿主机是 Windows。

原生 Windows 跑 DeepSeek:哪些好用,哪些容易翻车

不装 WSL2,能不能直接在 Windows 上跑 DeepSeek?可以,但要清楚哪些场景比较稳,哪些地方经常出问题。

通常比较稳的几类玩法

-

打包好的桌面应用 / GUI

- 如 LM Studio 等支持 DeepSeek 的本地 LLM GUI。

- 一般自带 CPU 推理引擎或简单的 GPU 后端,Windows 兼容性较好。

- 适合加载量化后的 DeepSeek 模型做日常使用。

-

Windows 版 Ollama

- 提供原生 Windows 安装包,可在 PowerShell / CMD 中直接运行模型。

- 优点:

- 不用自己管 Python 环境、依赖和模型运行时。

- 有 NVIDIA GPU 时,可通过 CUDA 加速;否则自动退回 CPU。

- 对想“快速体验 DeepSeek 本地推理”的用户非常友好。

-

text-generation-webui 等 Web UI(CPU 或 DirectML 后端)

- 比如 Oobabooga 的 text-generation-webui。

- 在 Windows 上安装 Python 和依赖后,可用 CPU 或 DirectML 做简单 GPU 加速。

- 适合加载小模型或量化模型,体验 Web 界面推理。

-

Hugging Face Transformers + PyTorch(原生 Windows)

- 可以在 Windows 上通过 Transformers 加载部分 DeepSeek 模型。

- PyTorch 提供了带 CUDA 的 Windows 版二进制包,理论上可用 NVIDIA GPU。

- 示例:

pip install torch transformers- 在脚本中加载如

deepseek-ai/DeepSeek-R1-Distill-Qwen-7B等蒸馏模型

- 小模型、CPU 推理一般问题不大;大模型 + 高级优化时,Linux 兼容性会更好。

原生 Windows 上常见的“坑点”

-

GPU 驱动 / 工具链不匹配

- 虽然 PyTorch / TensorFlow 支持 Windows,但很多优化库或自定义 CUDA 扩展并不支持。

- 常见问题:

- GPU 无法被检测到

- CUDA 版本与 PyTorch 编译版本不匹配

- 若 DeepSeek 依赖某些自定义 CUDA kernel,而这些没有 Windows 版,就会直接失效。

-

Python 包安装困难

- 许多 LLM 相关 Python 包仍然以 Linux 为主,Windows 支持不完整或需要额外配置。

- 典型例子:

- bitsandbytes 早期几乎不支持 Windows,后来虽有新构建,但仍受限于后端与 GPU 栈。

- 在 Windows 上

pip install时,容易触发从源码编译,进而需要 Visual Studio Build Tools 等开发工具。 - 很多开发者为避免这些问题,会选择:

- 用 Conda / Miniconda

- 用打包好的本地 LLM 工具(Ollama、LM Studio)

- 或者干脆转向 WSL2。

-

高性能推理引擎缺乏 Windows 支持

- 例如 vLLM、ExLlama 等高性能推理库,多数只支持 Linux。

- vLLM 在撰文时尚未官方支持 Windows。

- Windows 虽有 DirectML 等 GPU 计算层,但 DeepSeek 代码默认不会走这条路。

- 一些社区方案会通过 ONNX + ONNX Runtime + DirectML 跑模型,但通常性能一般、配置复杂。

-

环境“怪癖”多

- Windows 的路径大小写不敏感、换行符不同、路径长度限制等,都可能让面向 Linux 的脚本翻车。

- 例如:

- 带空格的路径

C:\Users\Name\My Documents\deepseek\model.bin可能被脚本处理出错。 - 模型放在需要管理员权限的目录,导致读写失败。

- 带空格的路径

整体来看:原生 Windows 适合简单场景(CPU 推理、图形化应用),一旦追求极致性能或复杂优化,WSL2 / Linux 会更省心。

什么时候直接用 Ollama / llama.cpp 更省事

如果你不想折腾复杂环境,只想“本地能用就行”,那 Ollama 和 llama.cpp 是非常值得优先考虑的路线。

1. 自带运行时,安装简单

-

Ollama:

- 安装一个应用即可,用

ollama pull下载模型,用ollama run直接对话。 - 例如获取 DeepSeek 模型:

ollama pull deepseek-r1:32b(会自动下载并准备 32B 量化模型)。

- 不需要你自己安装 Python、CUDA 或编译器。

- 安装一个应用即可,用

-

llama.cpp:

- 高度优化的 C++ 实现,很多 GUI / 工具都基于它。

- 提供 Windows 预编译版本,解压即可用。

2. CPU 友好,量化效率高

- llama.cpp 的核心优势:

- 内存占用低

- 对 4bit / 8bit 量化支持成熟

- 对 DeepSeek 来说:

- 即便是几十亿参数的模型,通过量化后也能在普通 PC 上跑起来。

- 虽然速度比不上高端 GPU,但对个人使用、非生产场景通常够用。

3. 故障点少,社区成熟

- 预编译二进制 + 内置依赖,极大减少“环境问题”。

- 出问题时,多半是:

- 模型文件损坏

- 模型格式不匹配

- 而不是一长串 Python / CUDA 报错。

4. 需要接受的取舍

- 性能:

- 没有强力 GPU 时,生成速度明显慢于专业 GPU 推理引擎。

- 即便支持部分 GPU offload,也难以达到 vLLM 这类专门引擎的吞吐。

- 功能:

- 更偏向“本地单机使用”,并发、多 GPU、动态批处理等高级特性有限。

- 生态:

- 新模型结构、新特性往往先在 Linux + PyTorch / vLLM 等生态中出现,再慢慢被集成到 llama.cpp / Ollama。

5. 模型格式注意事项

- DeepSeek 原始模型体积巨大,Ollama / llama.cpp 通常需要:

- 量化后的 GGML / GGUF 格式

- 常见情况:

- 社区已经帮你转换好了,Ollama 一条命令即可下载。

- 若需要自己转换,可参考 Ollama 的导入文档,通常在 Linux 环境下跑脚本完成转换。

结论:

- 如果你只是想在本地体验 DeepSeek、做一些个人使用,且能接受 CPU 级别的速度,Ollama / llama.cpp 是最快捷、最少踩坑的路线。

- 当你对性能和定制化要求提升,再考虑迁移到 WSL2 + PyTorch / vLLM 等更复杂方案。

Windows 上的 GPU 现实:CUDA vs ROCm(DeepSeek 视角)

在 Windows 上用 GPU 跑 DeepSeek,大致分成两条路线:

- NVIDIA:CUDA 生态

- AMD:ROCm / HIP / DirectML 生态

1. NVIDIA + CUDA:目前最成熟的选择

- NVIDIA 在 Windows 上的机器学习生态相对成熟:

- 驱动 + CUDA Toolkit

- PyTorch / TensorFlow 等主流框架都有官方支持

- 对 DeepSeek 用户来说:

- 有 RTX 3080 / 4090 等显卡时,可以:

- 在原生 Windows 上装 CUDA 版 PyTorch 直接跑

- 或者在 WSL2 里用 Linux 版 CUDA(更推荐)

- 很多用户会:

- 用 WSL2 + CUDA

- 或用 Docker Desktop(WSL2 后端)跑 Linux 容器里的 DeepSeek

- 有 RTX 3080 / 4090 等显卡时,可以:

结论:

- 有 NVIDIA 显卡时,CUDA 是在 Windows 上加速 DeepSeek 的“主干路线”,文档多、踩坑经验丰富。

2. AMD + ROCm / HIP:可用,但更挑硬件和心态

- AMD 正在逐步完善 Windows 上的 ROCm / HIP 支持:

- 提供了 Windows 安装文档

- 提供了 PyTorch on Windows 指南

- 也有针对 WSL2 的 ROCm 支持说明

- 现实情况:

- 支持范围受限于具体 GPU 型号、驱动版本和框架版本。

- 很多高性能推理引擎仍然以 Linux + CUDA 为主,对 ROCm 支持有限或需要额外配置。

建议:

- 若你还没买显卡、目标是本地 LLM 推理,NVIDIA 目前仍是更稳妥的选择。

- 若已经有 AMD 显卡:

- 先评估自己是否能接受 CPU + 量化模型的速度。

- 若想充分利用 GPU,考虑单独装 Linux 或 WSL2 + ROCm,并做好“多折腾”的心理准备。

常见 DeepSeek on Windows 问题速查(症状 → 可能原因 → 首步解决)

1. 模型加载失败

- 可能原因:

- 内存 / 显存不足

- 模型路径错误或文件损坏

- 首步解决:

- 检查模型大小与本机 RAM / VRAM 是否匹配。

- 确认模型文件路径正确、文件完整。

- 若使用量化格式,确认当前运行时支持该格式。

- 先尝试加载更小或更高量化等级的模型,验证是否为资源问题(可参考 DeepSeek 量化相关指南)。

2. Out of Memory / 程序直接崩溃

- 可能原因:

- 模型过大,超出 GPU 显存或系统内存上限。

- 首步解决:

- 换用更高量化等级或更小参数量的模型。

- 降低上下文长度(context length)。

- 确认没有其他程序占用大量显存。

- 尝试改为 CPU 推理(虽然更慢,但可验证是否纯粹是显存不足)。

3. CUDA 未被检测到(GPU 没有被使用)

- 可能原因:

- NVIDIA 驱动 / CUDA 未正确安装或版本不匹配。

- 在 WSL2 中未启用 GPU 支持或 Windows 侧驱动不支持 WSL2。

- 首步解决:

- 在 Windows 安装最新 NVIDIA 驱动(必要时安装 CUDA Toolkit)。

- 确认安装的是带 CUDA 的 PyTorch 版本(

torch.cuda.is_available()应为 True)。 - 在 WSL2 中运行

nvidia-smi检查 GPU 是否可见。 - 确认使用的是 WSL2 而不是 WSL1。

4. 生成速度极慢

- 可能原因:

- 实际在用 CPU 推理,而非 GPU。

- 模型过大,硬件性能吃紧。

- 首步解决:

- 用任务管理器或

nvidia-smi检查推理时 GPU 利用率是否接近 0%。 - 若 GPU 未被使用,回到“CUDA 未被检测到”一节排查。

- 换用量化模型、缩短上下文长度、减少并发请求。

- 用任务管理器或

5. 输出乱码、逻辑混乱或格式异常

- 可能原因:

- 使用了错误的 prompt 模板或不匹配的模型变体。

- tokenizer / 模型转换过程有问题。

- 首步解决:

- 查阅对应 DeepSeek 模型的文档,确认其期望的输入格式(如是否需要

/等标记)。 - 使用官方或社区推荐的 prompt 模板。

- 若自己做过量化 / 转换,确认 tokenizer 与模型权重匹配。

- 更新到最新版本的 llama.cpp / 推理引擎,排除旧版本 bug。

- 查阅对应 DeepSeek 模型的文档,确认其期望的输入格式(如是否需要

6. 本地 Web UI / API 无法访问

- 可能原因:

- Windows 与 WSL2 / Docker 之间的网络映射问题。

- 端口被防火墙拦截。

- 首步解决:

- WSL2 场景下,通常 Windows 访问

localhost:端口即可映射到 WSL2。 - 若不行,可在 WSL2 中用

ifconfig查 IP,尝试用该 IP 访问。 - Docker Desktop 中,确认使用了

-p 8080:8080这类端口映射参数。 - 检查 Windows 防火墙,必要时为该端口添加放行规则。

- 确认服务实际在监听正确的地址(如 0.0.0.0 而非仅 127.0.0.1)。

- WSL2 场景下,通常 Windows 访问

7. 模型格式不匹配(GGUF vs HF 等)

- 可能原因:

- 用不支持该格式的运行时加载模型。

- 例如:用 Transformers / PyTorch 去加载

.gguf文件,或用 llama.cpp 去加载.bin/.safetensors。

- 首步解决:

- 明确区分:

- PyTorch / Transformers / vLLM → 使用 Hugging Face 格式(

.bin/.safetensors等) - llama.cpp / Ollama → 使用 GGUF / GGML 等格式

- PyTorch / Transformers / vLLM → 使用 Hugging Face 格式(

- 若下错格式,重新下载正确格式或使用转换脚本。

- 注意不同版本 llama.cpp 对 GGUF 版本的兼容性说明。

- 明确区分:

8. 依赖安装报错(尤其在原生 Windows 上)

- 可能原因:

- 缺少 C++ 编译器或特定版本的库。

- 某些包本身就不支持 Windows。

- 首步解决:

- 安装 Visual Studio Build Tools(遇到编译错误时尤为重要)。

- 尽量使用有预编译 wheel 的版本,避免强制源码编译。

- 考虑使用 Anaconda / Miniconda,利用其预编译包减少编译需求。

- 若某包明确不支持 Windows,寻找替代方案或转向 WSL2。

9. 权限 / 路径问题

- 可能原因:

- 读写需要管理员权限的目录。

- WSL2 中访问 Windows 盘路径方式错误。

- 首步解决:

- 尽量将模型和代码放在用户目录下,避免系统保护目录。

- 路径命名尽量避免空格和特殊字符。

- 在 WSL2 中访问 Windows 盘时,使用

/mnt/c/Models/DeepSeek这类挂载路径。 - 若性能要求高,建议把模型放在 WSL2 的 Linux 文件系统内,而不是

/mnt/c。

10. 本地 API 返回 429 / 503 等错误

- 可能原因:

- 本地 DeepSeek 服务被请求压垮或有并发 / 队列限制。

- 首步解决:

- 若在做自动化调用,增加请求间隔,避免短时间内大量并发。

- 检查 Web UI / API 的并发配置,很多工具默认单请求串行处理。

- 重启服务,排除异常状态。

- 检查系统内存 / 显存是否已被耗尽。

若以上步骤仍无法解决,可参考更详细的 DeepSeek 故障排查文档,或尝试简化环境(换小模型、换更主流的运行方式)。

Windows 本地跑 DeepSeek 的安全与隐私注意事项

本地运行 DeepSeek 的最大优势之一,是数据默认不出机器。但“本地”并不等于“绝对安全”,仍有一些细节值得注意。

1. 默认情况下,数据不会上传到云端

- DeepSeek 的推理过程在你自己的硬件上完成,输入的代码、文档、对话内容不会自动发往任何服务器。

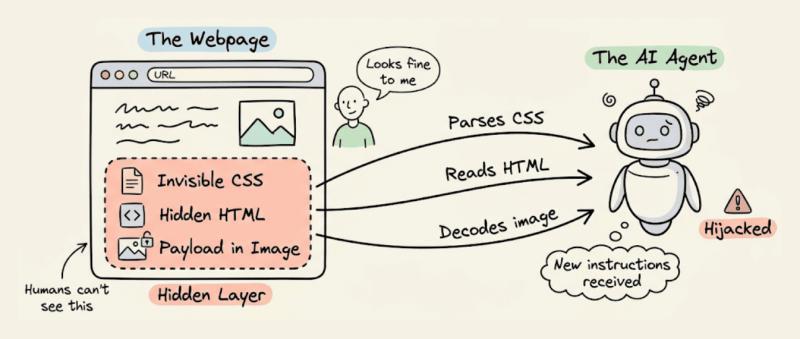

- 但要注意:

- 某些社区 Web UI / 插件可能有联网功能,需确认其配置。

- 若不放心,可以通过防火墙规则禁止该程序访问外网。

2. 本地日志与缓存

- 很多本地 LLM 工具会保存对话历史,方便你回看或继续对话。

- 建议:

- 找到这些日志文件所在目录(常见于程序目录或

C:\Users\\AppData\...)。 - 若涉及敏感信息,可定期清理或在设置中关闭日志功能(若支持)。

- 找到这些日志文件所在目录(常见于程序目录或

- 模型缓存(如 Hugging Face 缓存目录)主要存放模型权重和中间文件,一般不含你的输入内容,但会占用磁盘空间,可按需清理。

3. 限制网络暴露面

- 大多数本地 DeepSeek 服务默认只监听

localhost,只有本机能访问。 - 不建议将服务直接暴露到公网或整个局域网,除非:

- 明确配置了认证机制

- 清楚自己在做什么

- 若确实需要跨设备访问:

- 优先考虑 SSH 隧道或 VPN

- 或使用反向代理(如 Nginx / Caddy)加上密码保护

4. 若服务监听在 0.0.0.0,务必加认证

- 有些 Web UI / API 为了方便,会监听在 0.0.0.0(所有网卡)。

- 若你打算从手机或其他电脑访问:

- 检查是否支持设置访问令牌 / 密码。

- 若不支持,可在前面加一层反向代理做认证。

- 用另一台设备测试访问,确认暴露范围是否符合预期。

5. 模型与工具下载来源要可信

- 只从可信渠道下载 DeepSeek 模型和相关工具:

- 官方 Hugging Face 仓库

- 官方网站链接

- 不要随意从未知网盘 / 非官方链接下载巨大的模型文件,避免被植入恶意代码或后门。

总之:

- 把服务限制在 localhost

- 管理好日志与缓存

- 只从可信来源下载模型与工具

就能在享受本地 AI 带来的隐私优势的同时,尽量降低安全风险。

总结:DeepSeek on Windows 的“可行路线图”

-

可以跑,但要选对路:

- CPU:兼容性最好,速度最慢,适合体验和小模型。

- NVIDIA + WSL2:当前 Windows 上跑 DeepSeek 的主力路线,兼容 Linux 生态、性能好。

- 原生 Windows:适合图形化应用、Ollama 等打包工具,复杂环境时更易踩坑。

- AMD:可用但更挑硬件与耐心,建议有一定折腾经验再尝试。

-

推荐实践顺序:

- 先用最简单的方式跑通一个小模型(Ollama / LM Studio / 量化模型)。

- 确认推理流程和基本效果没问题后,再考虑:

- 换更大模型

- 上 GPU 加速

- 搭建 API 服务或集成到自己的应用中。

-

心态与策略:

- 每次只增加一点复杂度,遇到问题更容易定位。

- 若在某条路线反复卡住,不妨退一步:

- 换更小的模型

- 换更主流、更被社区验证的环境(如 WSL2 + NVIDIA)。

只要按部就班、循序渐进,在 Windows 上稳定跑起 DeepSeek 完全是可达成的目标。