DeepSeek R1 是一款专注“推理能力”的大语言模型(LLM),擅长通过逐步逻辑推演来解决复杂问题,尤其适用于多步推理场景,如自然语言理解、科学与数学题解、代码分析与调试等。

在架构上,DeepSeek R1 采用先进的 Mixture-of-Experts(专家混合)结构,总参数量约 6710 亿,其中约 370 亿参数在一次推理中处于激活状态,并支持最长约 128k tokens 的上下文输入。

与传统“直接生成答案”的模型不同,R1 在内部显式采用链式思维(chain-of-thought)方式:先在内部逐步推理、验证,再给出结论,因此在复杂推理任务上表现尤为突出。其训练流程结合了强化学习与针对性微调,在多项推理基准测试中达到了业界领先水平。

现在,DeepSeek R1 已通过 Azure AI Foundry 平台提供服务,企业可以在可信、可扩展的云环境中直接调用这一推理模型。

Azure AI Foundry 提供统一的模型目录,包含 1800+ 各类模型(前沿闭源模型、开源模型、行业模型等),DeepSeek R1 已正式加入这一模型家族。

对企业和开发者而言,这意味着无需自建算力集群或专用 GPU,只需在 Azure 上完成简单配置,即可通过托管的推理服务使用 DeepSeek R1。模型以无服务器(serverless)方式计费与扩缩容,大幅降低使用门槛。

借助 Azure AI Foundry 内置的评估与基准测试工具,你可以快速试验、迭代并将 DeepSeek R1 集成到现有工作流中。

综合来看,DeepSeek R1 强大的逻辑推理能力,加上 Azure 企业级托管能力,非常适合构建需要多步推理、代码分析、复杂问答等“高认知负载”场景的 AI 应用。

说明: DeepSeek R1 的设计重点在“推理”而非“自由创作”。在创意写作流畅度上,它可能不如部分专门优化的生成模型,但在逻辑严谨、步骤清晰的任务上表现极佳。

DeepSeek 团队坚持开放与开源路线,R1 为开放模型,企业可以获得更高的透明度,并在需要时在本地运行其蒸馏小模型版本。

DeepSeek R1 登陆 Azure 的时间点,也恰逢大量企业在寻找“高性价比且推理能力强”的 AI 方案,它正好通过熟悉的 Azure 云平台,满足这一需求。

在 Azure AI Foundry 上部署 DeepSeek R1(图形向导步骤)

在 Azure AI Foundry 上部署 DeepSeek R1 的流程非常顺畅,可以直接通过 Azure AI Foundry Studio(Web 门户)完成。

只需几次点击,就能获得一个托管的 无服务器 API 端点,无需关心底层算力与集群管理。下面是从零开始部署 DeepSeek R1 的步骤说明:

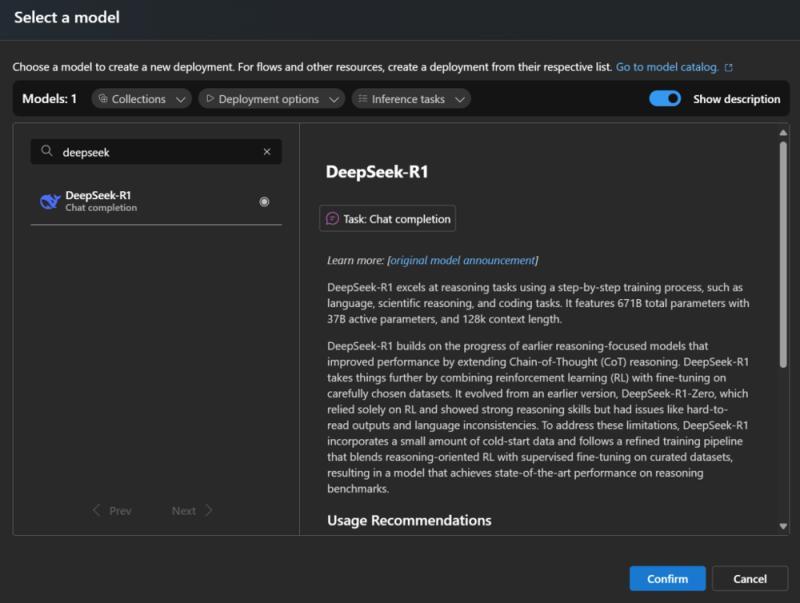

在 Azure AI Foundry 模型目录中选择 DeepSeek R1

前置条件:

- 拥有 Azure 账号与订阅

- 已开通 Azure AI Foundry 访问权限

如果尚无订阅,可先注册免费账号。Azure AI Foundry 为云服务,你需要选择一个 Azure 区域进行部署(注意查看该模型在目标区域的可用性)。

1. 打开 Foundry Studio

访问 Azure AI Foundry 门户:https://ai.azure.com,使用 Azure 凭据登录。该门户(也称 Azure AI Studio)是浏览模型、创建项目与部署模型的主要界面。

2. 进入模型目录(Model Catalog)

在首页找到“Explore models and capabilities”(探索模型与能力)区域,点击“Go to full model catalog”进入完整模型目录,查看所有可用基础模型。

3. 搜索并选择 DeepSeek R1

在模型目录搜索框中输入 “DeepSeek R1”,在结果中点击 DeepSeek-R1 模型卡片,打开模型详情页。这里会展示模型简介、能力说明、使用建议等信息,包括其推理特性与大上下文窗口等。

4. 发起部署

在 DeepSeek-R1 模型详情页点击“Use this model”或“Deploy”。如果你还没有 Foundry 项目,Azure 会提示先创建一个项目,用于归集本次部署相关的资源。

5. 配置项目与资源

部署向导会引导你完成项目与资源配置,你可以使用默认设置,也可以按需自定义:

- 项目名称与资源组:输入项目名称(或使用默认),选择一个 Azure 资源组,用于逻辑上归类相关资源。

- Azure AI Foundry 资源:如果订阅下尚无 Foundry 资源,向导会自动创建一个 Azure AI Foundry 资源(以前称 Azure AI Services 资源),这将作为托管模型的服务入口。选择部署区域时,一般建议靠近主要用户所在区域以降低延迟。

6. 选择部署类型

当前 DeepSeek R1 默认以 Global Standard 部署类型提供服务,属于高性能、多租户的全球端点(目前处于预览阶段)。未来可能会增加区域级或专用实例等更多选项。

在“高级选项”中可以查看或微调相关设置。默认配置已满足企业级 SLA、安全与可靠性要求,适合快速上手。

7. 查看与确认价格信息

在部署向导中通常会有“Pricing and terms”页签,展示当前 DeepSeek R1 的计费模式。撰文时,DeepSeek R1 处于预览期,使用费用为 0 美元(免费),但会有一定速率限制。未来价格可能调整,届时可能需要重新确认条款或重新部署。务必阅读并勾选相关条款。

8. 创建部署

点击“Create”或“Deploy”开始部署。Azure 会在后台为你准备所需资源并创建模型端点。几分钟后,部署完成,门户会显示成功页面。

9. 获取端点与密钥

部署成功后,你会进入该部署的详情页。这里会显示:

- 模型 REST 端点 URL

- 用于鉴权的 API Key(或 Azure Key)

端点示例:

https://.services.ai.azure.com/models/...

其中包含唯一的部署名称或 ID。请复制端点与密钥,用于在应用中调用模型(之后也可随时在门户中重新查看)。

10. 在 Playground 中测试

在写代码前,可以先在浏览器中直接测试模型。Azure AI Foundry 提供 Chat Playground:

- 在部署详情页点击“Open in playground”

- 打开交互式对话界面,输入提示词并查看 DeepSeek R1 的回复

Playground 是验证部署是否可用、观察模型行为的理想入口。界面右上角的 Deployment 下拉框会自动选中你刚创建的 DeepSeek R1 部署。

11. 通过 API 或 SDK 使用模型

当部署就绪后,你就可以在应用中通过 REST API 或 Azure 提供的多语言 SDK(Python、JavaScript/TypeScript、C#、Java 等)调用该模型。下文会以 Python 为例展示基础调用代码。

12. 其他部署方式(CLI / IaC)

上述步骤基于 Azure 门户图形界面,适合开发者与业务人员快速上手。如果你偏好 基础设施即代码(IaC)或命令行,也可以通过 Azure CLI、Bicep/ARM 模板等脚本化方式创建 Foundry 资源并部署 DeepSeek R1。

目前 Foundry 模型相关 CLI 文档仍在完善中,但整体思路是:先创建 Azure AI Foundry 账户,再基于 DeepSeek-R1 的 SKU 创建部署。对于需要 CI/CD 自动化、多环境一致部署的团队,推荐采用 IaC/CLI 方式。

部署完成后,DeepSeek R1 以 全托管服务 形式运行,由 Azure 负责底层算力的伸缩与运维。你无需管理虚拟机,只需通过高层 API 与模型交互,同时自动享受 Azure 在安全、合规与监控方面的企业级能力。

使用 DeepSeek R1:模型加载与基础调用示例

完成部署后,可以通过 Azure AI Inference API 或 SDK 将 DeepSeek R1 集成到你的应用中。

下面以 Python 为例,演示如何加载模型并获取回复。其他语言(JavaScript/TypeScript、C#、Java)也有类似 SDK,或可直接使用 REST HTTP 接口。

1. 安装 SDK

以 Python 为例,先安装 Azure AI Inference SDK:

pip install azure-ai-inference

2. 在代码中连接到部署

from azure.core.credentials import AzureKeyCredential

from azure.ai.inference import ChatCompletionsClient

from azure.ai.inference.models import UserMessage

# 认证与客户端初始化

endpoint = "https://.services.ai.azure.com/models"

api_key = "" # 替换为部署详情页中的密钥

client = ChatCompletionsClient(

endpoint=endpoint,

credential=AzureKeyCredential(api_key),

model="DeepSeek-R1" # 若部署时自定义了名称,这里需改为自定义名称

)

# 构造用户消息

user_question = UserMessage(content="What is DeepSeek R1 and how can I use it on Azure?")

# 发送请求并获取回复

response = client.complete(messages=[user_question])

# 读取模型回答

answer = response.choices[0].message.content

print("DeepSeek R1 says:\n", answer)

在上述代码中:

- 使用

ChatCompletionsClient指向你的 Foundry 端点 - 使用部署生成的 API Key 进行鉴权

model="DeepSeek-R1"通常与模型名一致,若部署时自定义了名称,则需改为自定义部署名- 通过

client.complete()发送对话消息,读取首个choice的内容作为回答

你还可以查看 response.usage 获取 token 使用情况(提示词 token 数、输出 token 数等),便于后续成本监控。

3. 使用 REST API 直接调用

如果不使用 SDK,也可以直接通过 HTTP POST 调用 /chat/completions 接口,例如在 Python 中使用 requests:

import requests

endpoint = "https://.services.ai.azure.com/models/chat/completions?api-version=2024-05-01-preview"

api_key = ""

headers = {"api-key": api_key, "Content-Type": "application/json"}

data = {

"messages": [

{"role": "user", "content": "Hello, can you explain DeepSeek R1?"}

],

"temperature": 0.7

}

resp = requests.post(endpoint, headers=headers, json=data)

print(resp.json())

返回结果为 JSON,其中包含模型回答与相关元数据(包括可能的推理轨迹信息等)。

无论使用 SDK 还是直接 HTTP,Azure AI Foundry 的推理 API 在不同模型间是统一的,因此你可以用同一套调用模式来使用 DeepSeek R1 与其他模型(如 OpenAI 系列),降低集成复杂度。

4. 多语言支持

Azure AI Inference SDK 支持多种语言:

- Python

- Node.js / TypeScript(

@azure-rest/ai-inference) - .NET(

Azure.AI.Inference) - Java

调用方式与 Python 示例类似,均提供 ChatCompletionsClient 或等价客户端。只要掌握端点 URL 与鉴权方式(API Key 或 DefaultAzureCredential),即可在 Web 后端、桌面应用、Serverless 函数等任意环境中调用 DeepSeek R1。

公有云与企业私有网络部署配置要点

Azure AI Foundry 在设计上兼顾了灵活性与企业级安全,无论是直接使用公有云,还是在严格管控的企业网络环境中,都可以通过配置满足合规与安全要求。

主要模式包括:

-

公有云部署(默认)

默认情况下,DeepSeek R1 部署在 Azure 公有云的多租户基础设施上,通过互联网端点访问(使用 API Key 与基于角色的访问控制 RBAC 保护)。适合开发测试与对外服务场景。数据在 Azure 云内处理,默认不会被持久化,除非你主动存储。 -

企业网络集成(私有访问)

对于敏感业务,你可以通过 Private Endpoint 与 VNet 集成 将模型端点限制在企业私网或 VPN 内访问,屏蔽公网入口。配置方式与其他 Azure 认知服务类似:为 Foundry 资源创建私有终结点,并在 VNet 中进行 DNS 与路由配置。

-

数据驻留与合规

Azure 支持区域化部署与特定“数据区”(Data Zone)区域,以满足数据驻留要求(如数据必须留在欧盟或特定主权云中)。在价格与 SKU 中,你可能会看到类似 “DeepSeek R1 – Regional” 或 “DataZone” 的选项,对应不同合规等级。选择部署区域时,应根据 GDPR 等法规与公司政策进行匹配。 -

自管数据资源(Bring Your Own Resource)

Foundry 支持企业自带存储与数据库,用于保存对话历史、向量索引等业务数据。例如:- 对话记录存入 Azure Storage 或 Cosmos DB

- 检索增强(RAG)所需的向量索引存入 Azure Cognitive Search 这样,所有业务数据都保留在你的订阅与租户中,Azure 仅托管模型推理逻辑。

-

身份与访问控制

可通过 Azure AD 管理访问权限:- 为用户或服务主体分配“Cognitive Services User”或“Azure AI User”等角色

- 使用托管身份(Managed Identity)让应用在不暴露密钥的情况下调用模型 所有调用都可在 Azure 审计与日志中追踪,便于治理与合规。

-

私有云 / 本地环境

当前 DeepSeek R1 以云托管形式提供,尚无完全本地化的官方产品形态。但未来可能通过 Azure Arc 等方式,将部分 Foundry 能力下沉到本地或边缘环境。同时,DeepSeek 的蒸馏小模型有望在本地硬件上运行,用于对隐私要求极高或离线场景。

总体而言,公有云部署简单快捷,适合大多数场景;而通过私有网络、区域化部署与自管资源等能力,可以满足更严格的安全与合规要求。

成本管理与价格优化策略

通过 Azure AI Foundry 使用 DeepSeek R1 的一大优势,是无需前期投入昂贵算力,只按实际使用量付费。

在预览期内,DeepSeek R1 在 Azure 上调用费用为 0 美元(免费),但存在速率限制。随着服务走向正式商用,价格与配额可能调整,因此建议从一开始就养成良好的成本管理习惯。

以下是一些关键建议:

1. 持续关注价格与配额更新

定期查看 Azure 官方公告与 Azure AI Foundry 模型价格页。预览期结束后,可能需要重新确认价格条款或调整部署策略。

2. 控制 Token 消耗

未来 DeepSeek R1 很可能按处理的 token 数(输入 + 输出)计费。由于 R1 内部会进行较长的推理链,整体 token 消耗可能高于简单生成模型,因此要特别注意:

- 精简提示词:只提供必要上下文,避免无关长文本

- 限制最大输出长度:根据业务需求设置较低的

max_tokens,避免超长回答 - 利用模型推理优势:R1 在零样本(zero-shot)下表现已很好,通常无需大量示例,减少提示词长度

3. 选择合适的计费模式

Azure 预计会为此类模型提供:

- 按量计费(Pay-as-you-go):按请求或按 1K tokens 计费,适合低频或不稳定负载

- 预留吞吐量(Provisioned Throughput):预购固定吞吐(如每秒请求数或 tokens 数),单价更低且有更强 SLA,适合高并发、稳定业务

根据业务峰值与稳定性选择合适模式,避免过度预留或频繁超限。

4. 利用蒸馏小模型降低成本

DeepSeek 团队已发布 7B、14B 等蒸馏版本,运行成本远低于完整 R1。微软也计划将这些小模型用于本地部署(如 Copilot PC 或边缘设备)。

企业可以采用“大小模型协同”策略:

- 简单任务交给本地或小模型处理

- 复杂、高价值任务再调用云端完整 R1

这样既能保证效果,又能显著降低整体算力成本。

5. 监控与告警

通过 Azure Monitor 与 Cost Management:

- 监控请求数、token 使用量、延迟与错误率

- 设置成本告警与异常使用告警

- 分析哪些场景或提示词消耗最多 token,并针对性优化

6. 在免费预览期充分压测

利用当前免费阶段,尽早:

- 进行负载测试与性能评估

- 统计典型业务场景的平均 token 使用量

- 试验不同提示词风格对成本与效果的影响

这些数据将帮助你在正式计费后更准确地预估预算与优化策略。

业务集成建议:如何把 DeepSeek R1 融入工作流

部署只是起点,真正的价值在于把 DeepSeek R1 嵌入业务系统与日常流程。由于 Azure AI Foundry 提供的是标准化 API,你可以在多种架构中灵活使用它。

常见集成模式包括:

-

智能客服与虚拟助手

借助 Azure AI Foundry 的 Agent Service,可以将 DeepSeek R1 作为聊天机器人的“推理引擎”,并快速接入:- Microsoft Teams

- Slack

- Web 聊天组件

- 短信等渠道 例如,为员工构建一个 Teams 助手,回答复杂政策问题、IT 故障排查等。通过连接 SharePoint、数据库等企业数据源,让 R1 在真实数据基础上进行有据可依的推理。

-

业务流程自动化

通过 Azure Logic Apps 或 Power Automate,将 DeepSeek R1 嵌入自动化流程:- 新客户邮件到达时,自动调用 R1 总结要点并写入 CRM

- 自动分析工单内容,判断优先级与分类,再路由到合适团队

- 每周自动汇总销售数据,并让 R1 生成自然语言周报

-

自研业务系统集成

在自建 Web/移动/桌面应用中,通过后端服务调用 R1:- 为金融分析系统增加“自然语言问答”能力

- 在项目管理工具中提供“Ask DeepSeek”按钮,帮助理解项目风险与依赖

- 在代码平台中集成 R1 作为代码审查与调试助手

通常建议在应用与 R1 之间增加一层中间服务(如 Azure Function 或微服务),用于:

- 统一封装调用逻辑

- 做重试、日志、缓存与结果过滤

- 统一处理 `` 推理内容的剥离(见后文最佳实践)

-

Office 与生产力工具集成

通过 Microsoft 365 Copilot 可扩展能力或 Graph API / Office JS,将 DeepSeek R1 引入:- Word:辅助撰写复杂技术文档或政策说明

- Excel:用自然语言描述问题,让 R1 推导计算步骤与公式

- Outlook:为长邮件线程生成摘要或草拟回复

-

知识管理与智能搜索

将 R1 与 Azure Cognitive Search 或企业知识库结合,构建检索增强问答(RAG):- 用户搜索某项制度或流程时,先检索相关文档,再让 R1 阅读并综合回答

- 使用 Agentic Retrieval,让 R1 多轮检索与推理,给出带引用的答案

-

行业场景应用

根据不同行业的复杂决策与分析需求:- 医疗:在合规前提下,辅助临床决策支持系统进行病例推理

- 金融:参与风险分析流程,解释风险评分背后的逻辑

- 软件开发:在 IDE 中作为推理型代码助手,帮助发现逻辑漏洞

- 法律:对合同条款进行结构化拆解与风险提示

在这些场景中,DeepSeek R1 更适合作为“推理微服务”,专注复杂逻辑与决策,而非单纯的文本生成器。

使用过程中的坑点、限制与最佳实践

在实际部署与使用 DeepSeek R1 时,需要注意以下关键点,以获得更稳定、安全、可控的效果。

1. 推理 vs 速度:延迟略高是常态

R1 会在内部进行多步推理,因此响应时间通常比简单生成模型更长。对于用户可见的应用:

- 可以在界面上提示“正在思考”或显示加载动画

- 尽量使用流式输出(streaming),让用户先看到部分结果

2. 推理输出中的 `` 内容

R1 的一个特点是可以输出自身的推理过程,通常包裹在 ... 标签中。Azure 默认只向终端用户展示最终答案,但在原始 API 响应中,可能仍包含这段推理文本。

这些推理内容:

- 未经过安全与风格优化

- 可能重复或扩展用户的敏感输入

- 不适合直接展示给终端用户

最佳实践: 在生产环境中,务必在服务端剥离 `` 段落,仅向用户展示最终答案部分。

3. 安全防护与拒答行为

DeepSeek R1 经过严格安全评估,对敏感内容有较强的拒答倾向,尤其是:

- 仇恨、暴力、极端政治等话题

- 高风险或违法用途

在这些情况下,模型会给出礼貌拒绝或安全提示。这对企业安全是好事,但也意味着:

- 某些“边界话题”可能难以获得直接回答

- 需要在前端或中间层对用户输入进行预检测与引导

不要尝试通过提示词绕过安全策略,这既违反使用条款,也很可能被 Azure 内容安全系统拦截。

4. 对齐程度与内容安全

相较于某些高度 RLHF 调优的聊天模型,R1 在“礼貌性与全面过滤”方面的对齐程度略低,因此:

- 必须依赖 Azure AI Content Safety 的默认过滤

- 建议在关键业务中增加自定义安全校验与人工抽检

不要假设 R1 的输出天然“绝对安全”,而应通过测试与多层防护来确保符合业务要求。

5. Token 限制与输出截断

R1 支持 128k 上下文,但在 Azure 上单次输出长度通常限制在约 4k tokens 左右。当输出达到上限时,API 会返回 finish_reason = "length",表示回答被截断。

建议:

- 设计交互时避免一次性要求极长输出

- 对需要长文档的场景,拆分为多轮生成

6. 提示词(Prompt)最佳实践

针对 R1 的特点,有一些特别的提示建议:

- 尽量不使用复杂的 system message,或保持极简。R1 自带推理风格,主要指令放在 user 消息中更有效

- 不必刻意加入“Let’s think step by step”等链式思维提示,R1 内部已经这样做,反而可能导致重复或混乱

- 指令要清晰、具体:

- 若需要分步解题,可直接在用户提示中要求“请分步骤推理并给出最终结论”

- 数学题可要求“请逐步推理,并将最终答案写在 \boxed{} 中”,便于自动抽取

- 在 RAG 场景中,只提供与问题高度相关的文档片段,避免“信息过载”导致模型跑偏

7. 多轮对话与上下文管理

在聊天机器人场景中:

- 不要把上一轮回答中的 `` 内容继续带入下一轮对话

- 只保留用户消息与模型最终回答

- 对长对话可定期做摘要,减少历史长度

如果对话中曾出现敏感话题,模型后续可能更倾向于拒答,此时可以通过“重置上下文”或引导用户重新开始对话来恢复正常状态。

8. 测试与评估

由于 LLM 具有随机性,对关键任务应:

- 进行多次调用,比较结果稳定性

- 为代码生成等场景增加自动测试与验证

- 在上线前构建覆盖典型与极端输入的测试集,持续评估模型表现

9. 版本更新与蒸馏模型

DeepSeek 与 Azure 可能会陆续发布新版本(如 DeepSeek-R1-0528 等)。建议:

- 定期关注模型目录中的新版本说明

- 在测试环境先验证新版本效果,再考虑迁移生产

- 关注蒸馏小模型的发布,以便在合适场景替换或搭配使用

10. 许可与合规

DeepSeek R1 以 MIT 开源许可发布,限制较少,但:

- 在 Azure 上使用时仍需遵守微软服务条款与内容政策

- 若在 Azure 之外下载权重或自行微调,需要自行负责数据安全与合规

总结与下一步行动建议

在 Azure AI Foundry 上使用 DeepSeek R1,让开发者与企业用户可以以极低门槛接入一款顶级推理大模型:

- 通过可视化向导几分钟内完成部署

- 使用统一的推理 API 与多语言 SDK 快速集成

- 利用 Azure 的企业级安全、合规与监控能力

本文围绕以下几个方面进行了梳理:

- DeepSeek R1 的核心特点与适用场景

- 在 Azure AI Foundry 上的图形化部署步骤

- Python 与 REST API 的基础调用示例

- 公有云与企业私网部署配置要点

- 成本管理与价格优化策略

- 在聊天机器人、自动化流程、自研应用、知识管理等业务中的集成思路

- 使用过程中的限制、坑点与最佳实践

DeepSeek R1 的优势在于“逻辑推理”而非“花哨文风”,特别适合:

- 复杂问答与政策解读

- 多步数学与科学推理

- 代码分析与调试

- 需要解释性与严谨性的业务决策支持

建议的下一步:

- 登录 Azure AI Foundry 门户,亲自部署一个 DeepSeek R1 实例(预览期免费,非常适合试验)。

- 在 Playground 中尝试与你业务相关的问题,观察模型的推理风格与答案质量。

- 选取一个小而重要的业务场景(如内部问答机器人或邮件摘要),用文中示例代码快速做一个 PoC。

- 在 PoC 中加入日志与 token 统计,为未来成本估算打基础。

- 关注 Azure 与 DeepSeek 官方更新,及时评估新版本与蒸馏模型是否适合你的场景。

只要遵循上述实践,并结合自身业务特点进行测试与迭代,你就可以在 Azure 企业云环境中稳定运行 DeepSeek R1,将强大的推理智能真正融入日常应用与工作流。