AI教程

AI教程DeepSeek 系统要求全指南:在线用很轻松,本地跑要三思

DeepSeek 在线使用几乎不挑设备,但一旦想在本地跑大模型,硬件门槛会瞬间拉满。本文用通俗方式拆解 DeepSeek 在网页、App、API 和本地部署下的实际系统要求,帮你判断:你的电脑,到底适合哪种玩法。

按标签聚合查看文章内容。

AI教程

AI教程DeepSeek 在线使用几乎不挑设备,但一旦想在本地跑大模型,硬件门槛会瞬间拉满。本文用通俗方式拆解 DeepSeek 在网页、App、API 和本地部署下的实际系统要求,帮你判断:你的电脑,到底适合哪种玩法。

AI教程

AI教程DeepSeek 聊天免费,但并不是“全场通吃”的免费:网页和手机端日常对话零费用,API 按 Token 计费,本地部署虽然模型可免费获取,却要自己掏硬件和运维的钱。搞清楚这三种用法,才能避免踩坑。

AI资讯

AI资讯AMD推出“Agent PC”概念,建议用户拥有两台电脑:一台用于日常办公,另一台作为本地AI中心,全天候运行AI代理,实现从云端向本地转移,降低成本并提升自主性。

AI资讯

AI资讯近年来,美国AI领域掀起了一股关注热潮,焦点正是名为“OpenClaw”的开源代理型AI软件。由彼得·斯坦伯格开发的OpenClaw,是一种能够自主执行多种复杂任务,代替人类操作的智能代理软件,受到众多AI开发者的青睐。 在2026年5月18日至20日于美国内华达州拉斯维加斯举办的“Dell Technologies World 2026”(简称DTW 26)年会上,戴尔科技发布了“Dell D

AI教程

AI教程DeepSeek 现在更像一套完整的「开发辅助工作台」,而不只是一个会写代码的大模型。本文用实战视角梳理:该选哪个模型、怎么写提示词、何时用思维模式、如何用 FIM 补全和 JSON 输出搭建可靠的编码助手。

AI资讯

AI资讯日本伊藤忠科技解决方案株式会社(简称CTC)与日本理光株式会社于27日宣布,联合开发了一款结合了理光自家大型语言模型(LLM)的小型桌面AI服务器,支持在本地环境中使用生成式AI。该产品将通过日本理光日本公司开始提供。 此次推出的产品基于本地AI设备“NVIDIA DGX Spark”的OEM版本,体积小巧,尺寸为150×150×50.5毫米(宽×深×高),适合放置于办公桌旁。尽管体积紧凑,但具备

AI商业

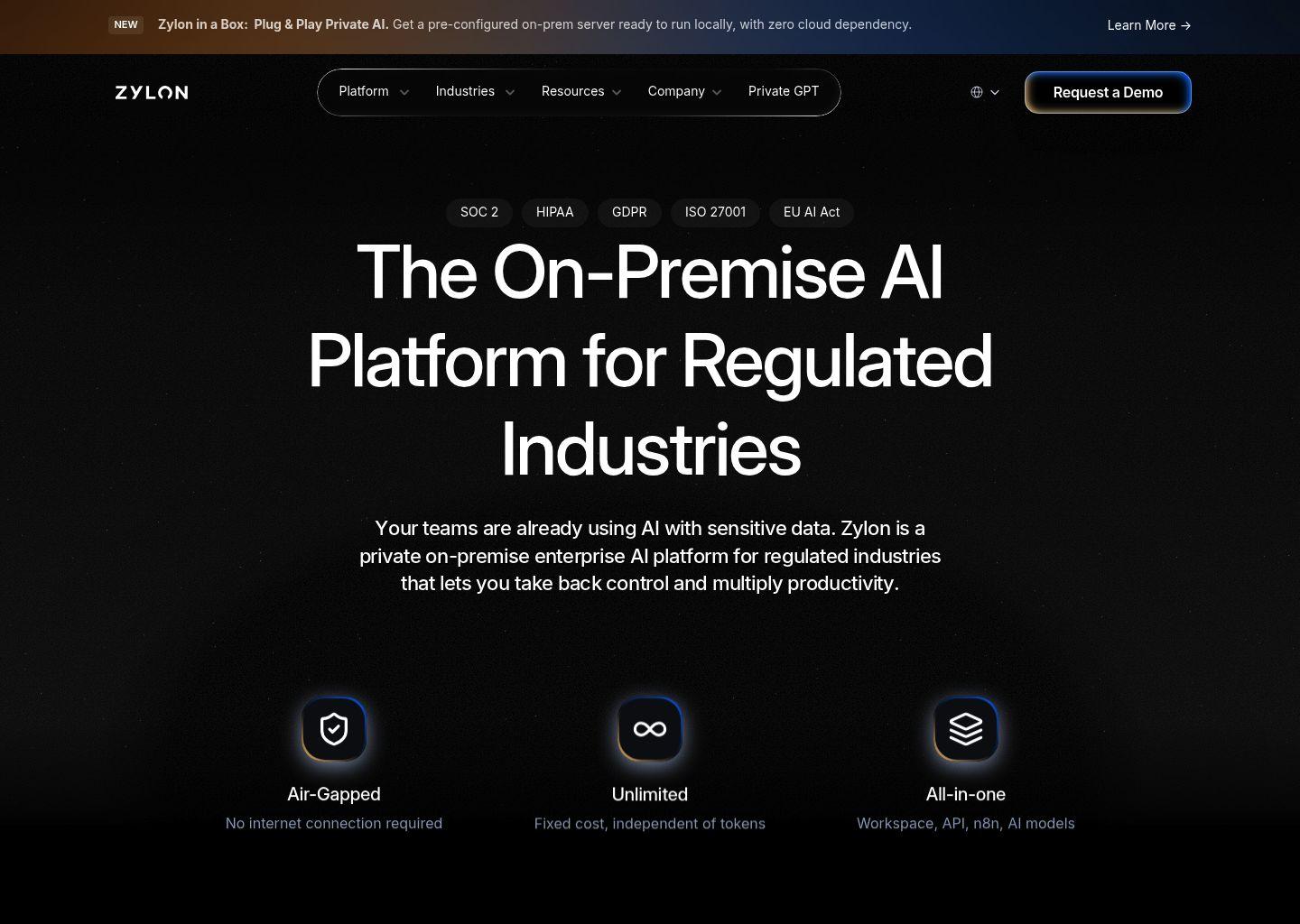

AI商业Zylon 是面向金融、医疗、国防及公共部门的本地私有 AI 平台,可在自有机房、隔离网络或专有云 VPC 中部署,支持零云依赖、全程数据可控,并符合 SOC 2、HIPAA、GDPR、ISO 27001 与 EU AI Act 等合规要求。

AI资讯

AI资讯日本戴尔科技公司于5月18日宣布,与NVIDIA合作推出的AI解决方案“Dell AI Factory with NVIDIA”迎来了新功能和产品,旨在支持AI代理的运营并强化AI基础设施。 “Dell AI Factory with NVIDIA”整合了戴尔的存储、网络、工作站等硬件产品与NVIDIA的GPU及软件,提供面向企业的AI解决方案。该方案覆盖从桌面到云端的端到端服务,采用模块化架构

AI教程

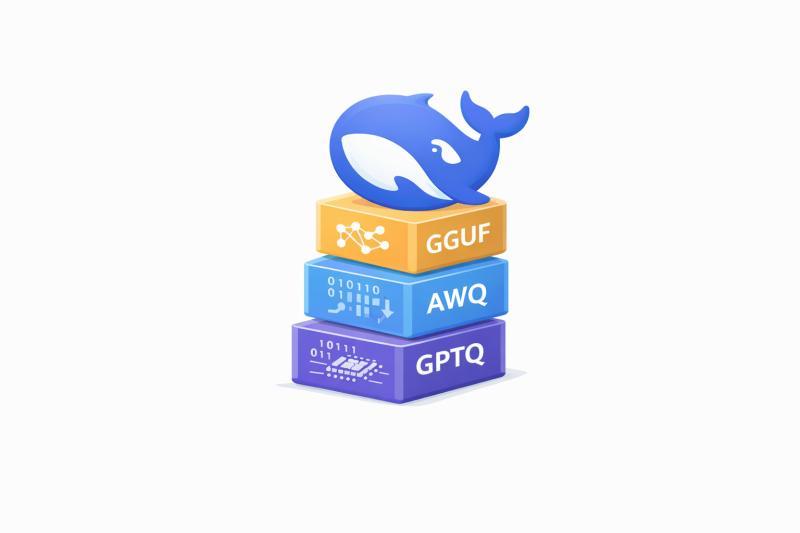

AI教程DeepSeek 系列是开放权重大模型,支持本地部署,但原始模型参数规模巨大,直接以全精度运行对大多数个人或小型服务器来说几乎不可能。本文系统对比 GGUF、AWQ、GPTQ 三种主流量化格式在 DeepSeek 本地部署中的适用场景、优缺点与选型思路,帮助你根据硬件与应用需求做出合适选择。

AI教程

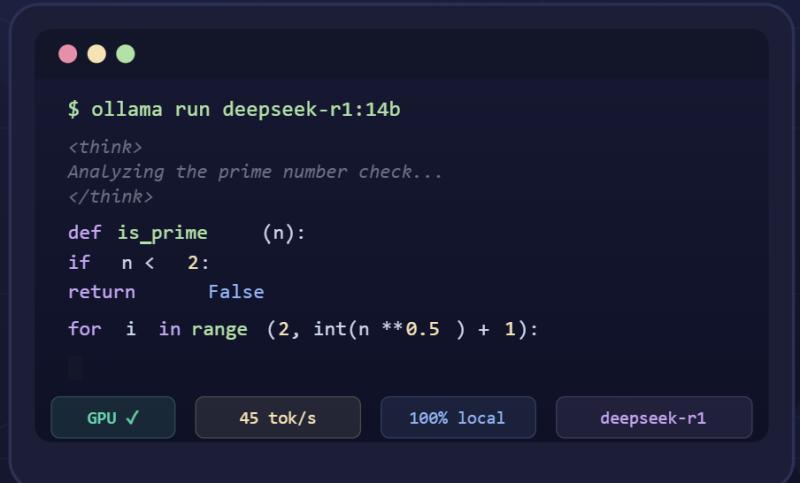

AI教程想在自己电脑上本地运行 DeepSeek,彻底摆脱云端与订阅?本指南手把手教你在 Windows、macOS 和 Linux 上安装与配置 DeepSeek,本地离线使用、无需 API Key、无需付费。

AI资讯

AI资讯戴尔与NVIDIA合作,推出支持本地安全部署的智能代理AI基础设施,帮助企业有效控制AI工作负载成本。

AI教程

AI教程在本地运行 DeepSeek 确实能避免数据直接发送到外部服务器,但这并不是隐私“万能钥匙”。真正的安全取决于你使用的运行环境、网络配置、日志与缓存策略,以及是否彻底关闭遥测与外联。本文系统梳理本地 DeepSeek 的隐私模型、数据可能残留的位置、网络暴露与遥测风险,并给出一套可操作的隐私加固清单与使用边界判断。