99% 的人用 DeepSeek 写代码,只会丢一段报错上去说「帮我修」。结果要么跑不通,要么改得面目全非。真正高效的用法,是把它当成一套可配置的「开发工作流」,而不是万能修 bug 机器。下面这篇,就是给已经在写代码、想把 DeepSeek 用出生产力的你看的。

提前说明:Chat-Deep.ai 是独立的 DeepSeek 指南与浏览器体验,本篇不隶属于 DeepSeek 官方,也不代表 DeepSeek、Claude Code、Anthropic 或任何模型/推理服务商的立场。

DeepSeek 现在到底适不适合写代码?

DeepSeek 在编码上的定位

很多人以为 DeepSeek 只是「能写点代码的聊天模型」,其实它在开发场景里能做的事远不止补几行函数。经过多轮测试,它在这些任务上表现稳定:调试报错、重构函数、代码审查、算法讲解、测试用例生成、结构化开发流程、甚至简单的编码 Agent。官方文档给出的当前主力模型,是基于 DeepSeek-V3.2、上下文长度 128K 的 deepseek-chat 和 deepseek-reasoner。

deepseek-chat 对应非思维模式,适合日常「问答 + 代码」场景;deepseek-reasoner 是思维模式版本,更偏向长推理、复杂调试、多文件分析和架构权衡。以前的 DeepSeek-Coder 系列在开源和本地部署上很重要,但不应再被当作当前托管 API 的默认入口。

有用户反馈:在一个中型 Next.js 项目里,用

deepseek-chat做日常重构和测试生成,能稳定节省 30% 左右的开发时间,但一旦切到复杂跨模块 bug,就明显需要deepseek-reasoner才能给出靠谱的排查路径。

使用时必须注意的风险

安全相关代码是最容易被忽略的坑。包括鉴权逻辑、支付流程、数据库迁移、生产基础设施、依赖升级、许可证敏感代码、合规项目等,都不应该「模型说可以就直接上」。DeepSeek 能给出建议,但无法保证生成代码在安全性、正确性、许可证或生产可用性上完全合格。说白了,它更像一个很聪明的实习生,而不是能独立签字的架构师。

据一些团队的内部复盘,直接把 AI 生成的 SQL、Shell 命令在生产环境执行,是最常见的事故来源之一,问题往往出在「默认假设模型不会删数据」。

这篇指南适合谁?

目标读者与使用场景

如果你想系统搞清楚:

- 用 DeepSeek 写代码时该选哪个模型

- 怎么写提示词才能少踩坑

- FIM 补全、JSON 输出、工具调用到底怎么用

- 如何在 Claude Code、本地模型里接入 DeepSeek

- 成本、安全和上下文控制要注意什么

那这篇可以当成你的「DeepSeek 编码实战说明书」。

不同入口怎么选

你可能会遇到几种完全不同的「DeepSeek for coding」:

- 独立浏览器聊天:

- 适合快速问问题、看解释、试试调试思路、写一小段代码

- 可以直接用 Chat-Deep.ai 的 DeepSeek 风格网页聊天,不用账号

- 官方 DeepSeek Chat:

- 想用官方网页或 App 体验时走这里

- 官方 DeepSeek API:

- 用来做编码工具、Bot、代码审查系统、CI 集成等

- Anthropic 兼容工作流:

- 官方文档提供了兼容 Claude Code 的 API 路径

- FIM Completion Beta:

- 已有前后缀,只想补中间代码时使用

- 本地模型:

- 在 R1-Distill、DeepSeek-Coder、DeepSeek-Coder-V2 等 checkpoint 上做离线或私有实验

- 高级自建服务:

- 用 vLLM、SGLang 等搭私有编码助手时用

如果你在做基于 API 的产品,优先用官方托管 API 和当前别名;想学本地 AI 或做私有代码实验,再考虑本地模型,但要接受它和托管 API 行为不完全一致。

开发者该选哪个 DeepSeek 模型?

模型选择的基本原则

很多团队一上来就把最贵、最重的思维模式当默认,这其实是在烧钱。更合理的做法是:

- 小改动、格式化、简单语法问题:

deepseek-chat足够 - 多文件调试、复杂算法、架构权衡:再切到

deepseek-reasoner - 需要中间补全:用 FIM Completion Beta

官方模型总览可以看 DeepSeek 模型中心;历史和架构细节则参考 DeepSeek-Coder、DeepSeek-R1、DeepSeek-V3.2 等专门页面。

推荐的 API 参数习惯

对需要确定性输出的编码任务,温度要压低。官方温度指南建议:

- 编码、数学:

temperature=0.0 - 只有在起名字、脑暴架构方案、想多种实现时,再适当调高

关键提醒:在思维模式下(

deepseek-reasoner或显式开启 thinking),temperature、top_p、presence_penalty、frequency_penalty等参数官方说明是「不支持或无效」。这时候,与其纠结采样参数,不如把精力放在:提示词质量、上下文选择、工具设计和输出预算上。

DeepSeek-Coder 与现在的 DeepSeek 编码体验

DeepSeek-Coder 系列的历史角色

DeepSeek-Coder / V2 在开源社区里非常重要。早期仓库描述:

- 从零训练,2T token,其中约 87% 是代码、13% 是中英自然语言

- 模型规模从 1B 到 33B 不等

- 16K 上下文,支持项目级补全和填空

后来的 DeepSeek-Coder-V2 引入 MoE 架构、更多语言、更大模型和 128K 上下文,在本地实验和开源生态里依然有价值。

今天该怎么用这些模型

现在如果你要做托管 API 的编码产品,不要再从老的 deepseek-coder 假设出发。更稳妥的路径是:

- 日常编码任务:默认用

deepseek-chat - 难调试、重推理分析:再考虑

deepseek-reasoner - 把 DeepSeek-Coder 系列当作「历史/开源权重」,只在你明确要用这些 checkpoint(比如 Ollama、vLLM、LM Studio)时再选它们

上线前值得做的 3 个小测试

1. 调试一个 TypeScript 报错

模型建议: 先用 deepseek-chat,只有根因很模糊时再切 deepseek-reasoner。

提示词示例:

Find the root cause of this TypeScript error.

Framework: Next.js

Expected behavior: ...

Actual behavior: ...

Stack trace: ...

Relevant code: ...

Return the smallest safe fix and list tests to run.

验证动作:

- 跑失败用例

- 跑类型检查

- 确认公共 API 行为没变

- 检查模型有没有「发明」依赖或文件

2. 重构一个 Python 函数

模型建议: deepseek-chat + 行为不变的提示词 + 低温度。

Refactor this Python function for readability.

Do not change behavior.

Do not add dependencies.

Keep public function names and return types unchanged.

After the refactor, list unit tests that should pass before and after.

验证动作:

- 跑单测

- 对边界输入做前后输出对比

- 特别看异常处理有没有被「优化」掉

3. 生成 Jest / pytest 测试

模型建议: 常规用 deepseek-chat,只有行为藏在多文件里、逻辑很绕时再用思维模式。

Generate tests for this function.

Test framework: Jest

Include happy path, edge cases, invalid input, and regression cases.

Do not assume behavior not visible in the code.

If behavior is unclear, ask clarifying questions before writing tests.

验证动作:

- 确认修复前测试会因正确原因失败

- 修复后再全部通过

- 删掉只在「实现细节」上做断言的测试

DeepSeek 能帮忙的常见编码任务

解释陌生代码

DeepSeek 可以帮你快速读函数、类、SQL、Shell 脚本或配置文件。提示词里写清语言、框架和目标读者层级,效果会好很多。

Explain this Python function for a mid-level backend developer.

Focus on inputs, outputs, side effects, edge cases, and hidden assumptions.

调试一段堆栈信息

调试时,别只贴报错一句话。更好的做法是:

- 带上堆栈

- 相关代码

- 期望行为 vs 实际行为

- 最近改动

Find the likely root cause of this error.

Language: TypeScript

Framework: Next.js

Expected behavior: ...

Actual behavior: ...

Stack trace: ...

Relevant code: ...

行为不变的重构

重构场景里,最怕模型「顺手帮你优化逻辑」。所以要在提示词里反复强调行为不变,并要求给出测试建议。

Refactor this function for readability without changing behavior.

Preserve public API names.

List any assumptions.

Then suggest unit tests that should pass before and after.

生成测试用例

给清楚函数、框架、测试框架和你关心的边界。模型有时会误解「真实意图」,所以测试依然要人工过一遍。

Generate pytest tests for this function.

Cover normal cases, edge cases, invalid inputs, and regression cases.

Do not mock behavior unless necessary.

审查一个 Pull Request

DeepSeek 可以帮你做 PR 总结、风险清单和测试建议。做成机器人时,输出要短、可执行,别把推理过程全丢给开发者看。

Review this diff as a senior engineer.

Return:

1. Bugs or correctness risks

2. Security concerns

3. Performance concerns

4. Missing tests

5. Suggested changes

代码跨语言迁移

逻辑迁移时,记得指定:目标语言版本、运行环境、依赖策略和行为约束。

Convert this Python function to TypeScript.

Target Node.js 20.

Avoid external dependencies.

Keep behavior identical and include tests.

写 SQL、正则和 Shell 脚本

这些是 DeepSeek 的强项,但也是事故高发区。更安全的做法是:

Write a PostgreSQL query for this report.

Include indexes that may help.

Explain the query plan risks.

Do not modify data.

生成文档与 API 设计

- 文档:docstring、README、API 文档、上手指南

- API 设计:请求/响应结构、OpenAPI 片段、JSON Schema、校验规则

需要结构化结果时,可以配合 JSON 输出模式使用。

结构化审查报告

做自动化工具时,可以让 DeepSeek 直接返回结构化 JSON:

- 严重级别

- 文件路径

- 行号

- 问题描述

- 建议修复

后面再在 CI 或前端里渲染出来即可。

提示词模板:让 DeepSeek 写得更「像人」

解释代码

Explain this code in plain English.

Audience: junior developer.

Include: purpose, inputs, outputs, side effects, edge cases, and possible bugs.

找出 bug

Find the bug in this code.

Expected behavior: ...

Actual behavior: ...

Failing input: ...

Error message: ...

Relevant code: ...

Return the smallest safe fix and explain why it works.

行为不变的重构

Refactor this code without changing behavior.

Constraints:

- Keep public function names

- Do not add dependencies

- Preserve error handling

- Include before/after test cases

生成测试

Generate tests for this function.

Test framework: Jest

Include happy path, edge cases, invalid input, and regression cases.

Do not assume behavior not visible in the code.

审查 diff

Review this diff as a senior reviewer.

Be concise.

Return only actionable issues.

Group by severity: critical, major, minor.

只返回 JSON

Return valid json only.

Schema:

{

"summary": "string",

"issues": [

{

"severity": "critical|major|minor",

"file": "string",

"line": "number|null",

"issue": "string",

"suggested_fix": "string"

}

]

}

比较两种实现

Compare these two implementations.

Focus on correctness, performance, maintainability, security, and testability.

End with a recommendation and risks.

写迁移方案

Create a safe migration plan.

System: ...

Current behavior: ...

Target behavior: ...

Constraints: no downtime, rollback required, database migration involved.

Return phases, tests, monitoring, and rollback steps.

扮演高级审查者

Act as a senior backend reviewer.

Do not rewrite the whole file unless necessary.

Point out only issues that could affect correctness, security, performance, or maintainability.

先列假设和风险

Before suggesting code, list your assumptions.

Then list risks.

Then provide the minimal change needed.

一个小经验:我自己在用时,凡是涉及生产数据库、支付、权限的改动,都会强制模型先列「假设和风险」,再给代码,这样能明显减少那种「看起来很聪明但其实很危险」的建议。

FIM 补全:在中间补代码

什么是 FIM Completion

FIM(Fill-in-the-Middle)适合这样的场景:文件已经存在,前后代码都写好了,只想补中间那一段。这更接近 IDE 里的代码补全,而不是普通聊天问答。

官方 FIM Completion Beta:

- 使用 completions 接口

base_url="https://api.deepseek.com/beta"- 当前文档写明:由

deepseek-chat支持,deepseek-reasoner不支持 - 最大 token 约 4K,更适合局部补全而非整文件生成

Python 示例

from openai import OpenAI

client = OpenAI(

api_key="YOUR_DEEPSEEK_API_KEY",

base_url="https://api.deepseek.com/beta"

)

response = client.completions.create(

model="deepseek-chat",

prompt="def normalize_email(email):\n ",

suffix="\n return email",

max_tokens=128

)

print(response.choices[0].text)

需要在现有文件中间补代码时,用 FIM;需要解释、审查、推理、多轮对话时,还是用普通 chat。更完整的请求细节可以参考官方 Chat Completion 和 FIM 文档。

Chat Prefix Completion:强制「代码形状」输出

什么时候用前缀补全

Chat Prefix Completion Beta 适合你想让模型的回答从某个前缀开始,比如:

- 一定要从 ```python 代码块开头

- 一定要从一个 JSON 对象开头

这样可以减少多余的解释性文字,更方便直接粘到编辑器里。

官方说明:

- 需要

base_url="https://api.deepseek.com/beta" messages列表最后一条必须是role="assistant"且带prefix=True

Python 示例

from openai import OpenAI

client = OpenAI(

api_key="YOUR_DEEPSEEK_API_KEY",

base_url="https://api.deepseek.com/beta"

)

messages = [

{"role": "user", "content": "Write a small Python function that validates an email."},

{"role": "assistant", "content": "```python\n", "prefix": True}

]

response = client.chat.completions.create(

model="deepseek-chat",

messages=messages,

stop=["```"]

)

print(response.choices[0].message.content)

即便强制了输出形状,也依然要跑测试、做代码审查。前缀补全只控制「长什么样」,不保证「对不对」。

在 Claude Code 中使用 DeepSeek

Anthropic 兼容模式的含义

DeepSeek 官方文档提供了 Anthropic API 兼容和 Claude Code 的配置示例。这并不意味着 DeepSeek 拥有 Claude Code,也不代表 Chat-Deep.ai 与 Claude Code 或 Anthropic 有任何合作,只是说:DeepSeek 暴露了一条兼容 Anthropic 风格 API 的路径,方便现有工具接入。

环境变量示例

export ANTHROPIC_BASE_URL=https://api.deepseek.com/anthropic

export ANTHROPIC_AUTH_TOKEN=${YOUR_API_KEY}

export API_TIMEOUT_MS=600000

export ANTHROPIC_MODEL=deepseek-chat

export ANTHROPIC_DEFAULT_HAIKU_MODEL=deepseek-chat

export CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC=1

官方示例里把 API_TIMEOUT_MS 设成 600000(10 分钟),是为了长输出时减少客户端超时。同时也提到:传入不被支持的模型名时,DeepSeek 可能会自动映射到 deepseek-chat。做编码工作流时,别想当然地以为「我写了某个自定义模型名就一定在用它」,要实际确认。

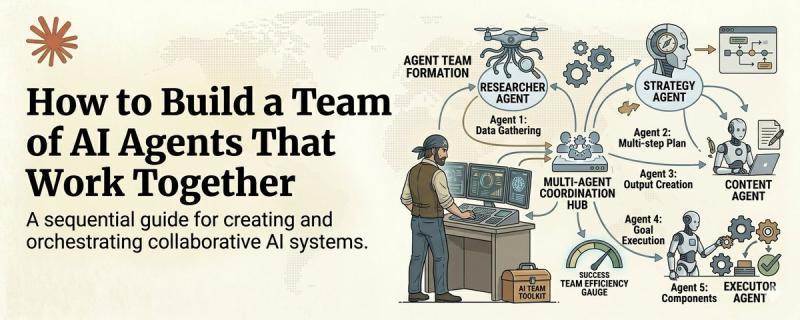

JSON 输出与 Tool Calls:搭建编码 Agent

JSON 输出:让结果可被机器消费

JSON 输出模式非常适合做结构化开发工具,比如:

- 代码审查报告

- Lint 总结

- TODO 提取

- 漏洞初筛

- 迁移计划

- 测试建议

- CI 注释

官方 JSON 输出指南建议:

- 使用

response_format={"type":"json_object"} - 在提示词里明确提到「json」

- 合理设置

max_tokens,降低 JSON 被截断的概率

Return valid json only.

Analyze this diff and return:

{

"summary": "string",

"issues": [

{

"severity": "critical|major|minor",

"file": "string",

"line": "number|null",

"issue": "string",

"suggested_fix": "string"

}

],

"tests_to_add": ["string"]

}

官方也提醒:在 JSON 输出模式下,API 偶尔可能返回空内容。生产环境里要:

- 加重试

- 严格校验 JSON

- 给用户一个安全的兜底,而不是假设每次都能成功解析

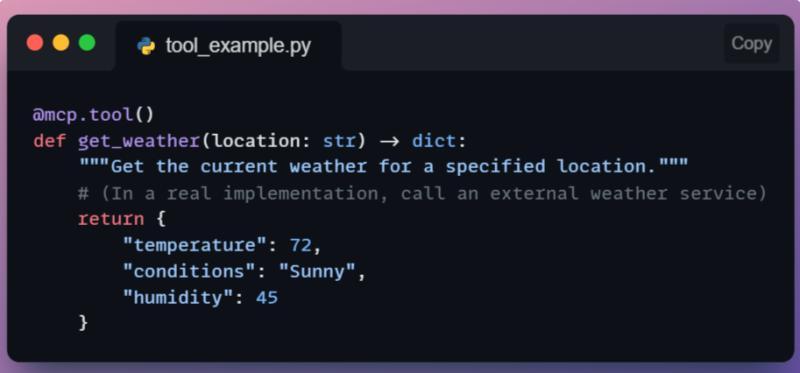

Tool Calls:让模型「看见」真实仓库

Tool Calls 适合做真正的编码 Agent,比如:

- 搜索仓库文件

- 读取文件内容

- 运行测试命令

- 查看依赖信息

- 查询 CI 状态

关键点是:模型不会自己执行工具。你的应用必须:

- 解析模型请求的函数

- 校验参数

- 控制权限

- 执行后把结果再喂回模型

严格工具模式目前是 Beta:

- 需要

base_url="https://api.deepseek.com/beta" - 在函数定义里加

strict:true

即便如此,执行前依然要对参数做安全检查,尤其是涉及 Shell、数据库或网络访问的工具。

什么时候该开思维模式(thinking mode)?

适合思维模式的场景

deepseek-reasoner 或显式 thinking 模式,适合这些真正需要深度推理的任务:

- 堆栈信息模糊的疑难调试

- 算法推导和极端边界分析

- 多文件代码库的整体理解

- 架构方案对比与权衡

- 测试失败归因

- 带隐式依赖的大型重构

- 多种实现策略的比较

不太确定这个划分是不是绝对准确,但从目前的用户反馈看,大致方向是对的。

如何在 API 里开启思维模式

在官方 DeepSeek API 里,思维模式可以通过两种方式打开:

- 直接用

model="deepseek-reasoner" - 用 OpenAI SDK 时,通过

extra_body传入 thinking 参数:

response = client.chat.completions.create(

model="deepseek-chat",

messages=messages,

extra_body={"thinking": {"type": "enabled"}}

)

思维模式输出会把推理过程放在 reasoning_content,最终答案放在 content。普通多轮对话时,不要把旧的 reasoning_content 再当成用户输入丢回去;但在工具循环里,要按官方工具调用模式处理,因为有些场景下需要当前轮的 reasoning_content 才能正确继续。

对终端用户产品来说,展示给用户的内容更适合是「简洁、可执行、可验证」的结论,而不是完整推理长文。需要更深入实现细节时,可以参考官方思维模式指南。

API 还是本地模型:怎么选?

托管 API 的优势

官方托管 API 对大多数生产级编码工具更友好,因为它提供:

- 最新行为和别名

- OpenAI 兼容集成

- JSON 输出、Tool Calls、思维模式

- FIM、Chat Prefix Completion 等 Beta 能力

你不用自己管模型部署、扩容和更新,只要关注产品逻辑和成本控制。

本地模型的适用场景

本地模型适合:

- 必须离线或强隐私的环境

- 不希望代码片段离开本机或内网

- 想深入玩推理框架、量化、加速等

但「本地隐私」只有在这些也都本地或私有时才成立:

- 推理运行时

- UI 和插件

- 日志与遥测

- 网络配置

编码场景下,R1-Distill、DeepSeek-Coder、DeepSeek-Coder-V2 在合适硬件上都能用;完整的 DeepSeek-R1 和 DeepSeek-V3.2 体量非常大,不是普通笔记本的目标。官方模型卡里写到:

- DeepSeek-R1 / R1-Zero:总参数约 671B,激活参数 37B,128K 上下文

- R1-Distill:基于 Qwen、Llama 的 1.5B、7B、8B、14B、32B、70B 等多种 checkpoint

- DeepSeek-V3.2:开源权重、MIT 许可,约 685B 参数

- DeepSeek-V3.2-Speciale:偏深度推理,不支持工具调用

如果你需要带工具的 Agent 工作流,不要默认所有 V3.2 变体都合适,要看具体模型卡说明。

控制成本与上下文:开发者版「省钱指南」

为什么编码任务特别费 token

开发者习惯一股脑把整文件、长堆栈、diff、依赖文件、日志、测试输出全贴进去,这会让:

- 输入 token 飙升

- 延迟变高

- 费用难以预估

更聪明的做法是:

- 只发相关片段,而不是整个仓库

- 带上文件路径和函数名,帮助模型理解上下文

- 先用检索或仓库搜索,再喂给模型

- 大日志先总结,再问根因

- 要求返回「补丁」而不是整文件重写

- 日常任务用

deepseek-chat,复杂分析再用deepseek-reasoner - 使用上下文缓存时,监控 cache-hit / cache-miss 的输入 token

当前官方定价与缓存机制

截至 2026 年 4 月 18 日,官方定价页面给出的价格大致为:

- 缓存命中输入:约 0.028 美元 / 1M token

- 缓存未命中输入:约 0.28 美元 / 1M token

- 输出:约 0.42 美元 / 1M token

价格可能调整,做产品或结算前要再查一遍官方定价和成本计算器。上下文缓存可以在重复前缀(系统提示、仓库说明、长上下文前缀)时显著降成本,但只有「前缀」部分会触发缓存,不是所有请求都能享受低价。

对编码工具来说,值得重点监控:

- 输入 / 输出 token 数

- 缓存命中 / 未命中 token

- 请求延迟

- 失败率与重试

- 工具调用重试

- JSON 解析错误

- 用户可见错误率

如果你怀疑服务可用性问题,也可以结合状态检查工具一起看。

AI 生成代码的安全清单

在把 AI 生成代码合入生产前,可以过一遍这份清单:

- 跑单测、集成测试和回归测试

- 跑 lint、格式化和类型检查

- 做安全审查,重点看注入、鉴权、访问控制、反序列化、文件操作和依赖风险

- 核对包名、版本和许可证

- 不在提示词里粘贴密钥、Token、证书或生产凭据

- 解析 JSON 前先校验

- 执行仓库、Shell、数据库或网络工具前校验参数

- 先在预发环境跑数据库迁移

- 生产改动必须有人审

- 日志里避免长期存储敏感代码或用户数据

有团队分享过一个教训:他们在日志里长期保留了模型输出,结果半年后做安全审计时才发现日志里混入了用户隐私数据,清理成本极高。

常见误区:别再这样用 DeepSeek 写代码

- 把 DeepSeek-Coder 当成当前托管 API 模型

- 以为

deepseek-reasoner就是原始 R1,本质上它是 DeepSeek-V3.2 的思维模式 - 所有小任务都用思维模式,导致延迟和成本双高

- 试图用温度等采样参数「调教」思维模式,而官方说明这些参数在思维模式下不生效

- 一股脑粘整个仓库,而不是选片段、diff、日志和测试

- 在提示词里粘贴密钥或私钥

- 不跑测试就信任生成代码

- 忽略 JSON 截断或空 JSON 响应,不做重试和校验

- 以为本地输出一定等于托管 API 输出,忽略 checkpoint、运行时、提示模板、量化和采样差异

- 以为工具调用会自动执行,忘了在应用层做参数校验和权限控制

- 复制过期的 API 别名映射,不再对照官方文档

最后给开发者的使用建议

如果你现在就要把 DeepSeek 接到项目里,一个相对稳妥的组合是:

- 日常解释、重构、测试生成、代码审查总结、结构化报告、带工具的编码工作流:用

deepseek-chat - 多步调试、模糊堆栈、架构决策、算法分析、多文件推理:再开

deepseek-reasoner或思维模式 - 需要中间补全:用 FIM Completion Beta

- 需要从特定前缀继续输出(比如只要代码):用 Chat Prefix Completion Beta

- 想在 Claude Code 里试 DeepSeek:走 Anthropic 兼容路径

- 只有在隐私、离线、实验或基础设施控制有明确需求时,再上本地模型

每一次把 AI 生成的代码推向生产前,都别跳过这些动作:跑测试、校验结构化输出、审查工具调用参数、对照最新官方文档确认模型和参数行为。这个判断方法在不少团队里已经被反复验证有效,值得你收藏下来,哪天要给同事做内部分享时也能直接拿来用。

常见问题

Q:日常开发默认用 deepseek-chat 还是 deepseek-reasoner 更合适?

A:日常开发建议默认用 deepseek-chat,只在遇到复杂调试或多文件推理时再切到 deepseek-reasoner。原因是 deepseek-chat 延迟更低、成本更可控,对解释代码、重构、写测试、审查 diff 等常规任务已经足够,而思维模式会显著增加输出长度和推理时间。实操上,你可以在工具里加一个「升级为深度分析」按钮,只有当用户明确需要更深入推理时才调用 deepseek-reasoner,同时在日志里记录两种模式的使用比例和效果,定期评估是否需要调整默认策略。

Q:怎么判断一段 AI 生成的代码能不能直接上生产?

A:最直接的判断是:是否通过了完整测试、代码审查和安全检查,而不是「看起来没问题」。原因在于模型可能会编造依赖、忽略边界条件或引入安全隐患,这些肉眼很难一次看全。建议做法是:先在预发环境跑单测、集成测试和回归测试,再让至少一名熟悉业务的工程师做代码审查,重点检查鉴权、数据写入、异常处理和日志;涉及数据库迁移或支付逻辑时,强制要求双人审查和回滚方案,避免一次性大改直接落到生产。

Q:使用 DeepSeek 写 SQL 和 Shell 命令时,如何降低「删库」风险?

A:核心原则是「先解释再执行」,并且优先在只读或测试环境里验证。模型生成的 SQL 或 Shell 命令,第一步应该让它自己解释每一行的作用和潜在风险,比如是否会修改数据、是否可能影响大量行、是否存在注入风险。你可以在提示词里明确要求:只生成只读查询、禁止 DROP/DELETE/UPDATE,或要求所有危险操作都加上显式确认步骤。执行前,在测试环境跑一遍并核对影响范围,生产环境则建议通过变更单或审批流程,由有经验的工程师最终拍板。

Q:本地部署 DeepSeek 模型真的就完全私有了吗?

A:本地部署只解决了「推理权重在自己机器上」这一层,不能自动保证整体私有。风险点在于:很多桌面 UI、插件、日志系统和监控工具会把请求或输出发往第三方服务,如果不关掉这些通道,代码和数据依然可能外泄。可操作建议是:检查并关闭所有外部遥测和云同步功能,确认推理服务、前端 UI、日志存储都在内网或本机;对敏感仓库再加一层限制,比如只允许通过受控的 CLI 工具访问模型,并在组织层面制定「哪些代码可以被喂给模型」的明确规范。

Q:如何写出对 DeepSeek 友好的调试提示词?

A:一个好的调试提示词,至少要包含语言、框架版本、期望行为、实际行为、完整堆栈和相关代码片段,而不是一句「帮我修」。原因是模型需要足够上下文才能做出可靠推断,缺少任何一块都会让它开始「猜」。建议结构是:先用几行自然语言描述问题背景,再列出「Expected / Actual / Stack trace / Relevant code」,最后明确输出要求,比如「返回最小安全修复方案,并列出需要补的测试」。你可以把这个模板固化到 IDE 插件或内部文档里,让团队成员在提问时自动套用,长期看能显著提高调试效率和答案质量。