AI资讯

AI资讯日本伊藤忠科技与理光联合推出搭载理光LLM的小型AI服务器 可放置于办公桌旁

日本伊藤忠科技解决方案株式会社(简称CTC)与日本理光株式会社于27日宣布,联合开发了一款结合了理光自家大型语言模型(LLM)的小型桌面AI服务器,支持在本地环境中使用生成式AI。该产品将通过日本理光日本公司开始提供。 此次推出的产品基于本地AI设备“NVIDIA DGX Spark”的OEM版本,体积小巧,尺寸为150×150×50.5毫米(宽×深×高),适合放置于办公桌旁。尽管体积紧凑,但具备

按标签聚合查看文章内容。

AI资讯

AI资讯日本伊藤忠科技解决方案株式会社(简称CTC)与日本理光株式会社于27日宣布,联合开发了一款结合了理光自家大型语言模型(LLM)的小型桌面AI服务器,支持在本地环境中使用生成式AI。该产品将通过日本理光日本公司开始提供。 此次推出的产品基于本地AI设备“NVIDIA DGX Spark”的OEM版本,体积小巧,尺寸为150×150×50.5毫米(宽×深×高),适合放置于办公桌旁。尽管体积紧凑,但具备

AI资讯

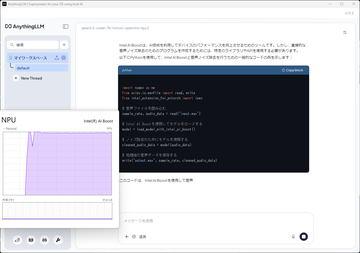

AI资讯大约一年半前,在《Ubuntu日和》第58回中,笔者曾以调侃的方式介绍了如何让Ubuntu识别Ryzen AI的NPU,但当时指出其实并无实用价值。那时只是抱着“总有一天能用上”的期待介绍,然而那一天一直未曾到来。 不过,最近情况终于发生了变化。支持Ryzen AI的框架FastFlowLM现已支持Linux系统,相关版本已发布。同时,AMD开发的本地LLM服务器Lemonade也正式支持Lin

AI资讯

AI资讯谷歌将Gemini 3的先进技术带入开源领域,推出了Gemma 4系列多参数开源模型,支持多模态输入和多语言处理。

AI资讯

AI资讯在现代PC中,虽然大多数都配备了NPU(神经网络处理单元),但其实际使用频率却非常低。NPU作为专门用于高效处理AI任务的处理器,符合微软Copilot+ PC标准的40TOPS性能时,Windows系统会自动调用其标准功能。尽管这些功能的实用性和使用频率存在争议,但理论上用户随时可以启用它们。 然而,未达到该性能标准的Intel Core Ultra系列(代号Arrow Lake)中的NPU“

AI资讯

AI资讯谷歌AI概览在搜索结果中提供的摘要存在大量错误,可能引发前所未有的信息误导危机。

AI资讯

AI资讯美国谷歌于4月16日(当地时间)推出了“Android CLI”,这是一款面向Android应用开发的命令行界面工具,支持使用编码代理。该工具能够将大型语言模型(LLM)消耗的令牌数量减少70%,并且代理在仅使用标准工具集导航任务时,完成任务的速度是之前的三倍。 目前,“Android CLI”处于预览阶段,提供了以下主要功能: SDK管理:通过命令“android sdk install”仅获

AI资讯

AI资讯Arcee是一家仅有26名员工的美国初创公司,凭借2000万美元的紧缩预算,打造了一个拥有4000亿参数的开源大型语言模型(LLM)。近日,Arcee发布了其最新的推理模型,名为Trinity Large Thinking。该公司CEO Mark McQuade向TechCrunch表示,这款模型是“非中国公司发布的最强大的开源权重模型”。 正如这番话所暗示的,Arcee的目标令人支持:它希望为美

AI资讯

AI资讯加拿大人工智能初创公司Cohere正计划收购总部位于德国的Aleph Alpha,此举得到了两国政府的支持,旨在为企业提供一个主权可控的AI解决方案,以应对由美国科技巨头主导的AI市场。“主权AI”指的是企业和政府能够完全掌控自身数据的系统,而非将数据通过微软或谷歌等美国公司处理。 作为大型语言模型开发者,Aleph Alpha和Cohere在各自国家均有一定影响力,但在全球范围内仍远远落后于Op

AI资讯

AI资讯中国AI实验室DeepSeek近日推出了其最新大型语言模型DeepSeek V4的两个预览版本——V4 Flash和V4 Pro。这是继去年发布的V3.2版本及其备受关注的R1推理模型之后的重要升级。DeepSeek表示,这两款模型均采用了专家混合(mixture-of-experts)架构,拥有高达100万令牌的上下文窗口,能够处理大型代码库或文档输入。专家混合技术通过激活部分参数来降低推理成本

AI资讯

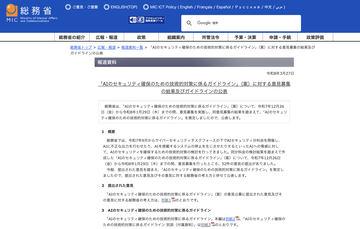

AI资讯日本总务省于3月27日发布了面向AI开发者和提供者的《确保AI安全的技术对策指南》。 该指南的发布基于2025年6月内阁决议的《实现数字社会重点计划》。总务省结合自2025年9月起举行的网络安全工作组AI安全分科会的讨论及公众意见征集,制定了本指南,旨在展示确保AI安全的技术对策实例。最终版本于2025年12月完成意见征集后正式公布。 指南内容参考了总务省与日本经济产业省共同制定的《AI企业指南

AI资讯

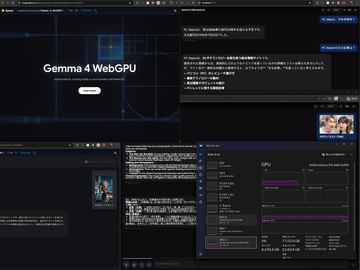

AI资讯截至2026年,想要在本地体验大型语言模型(LLM),通常需要下载并启动如LM Studio的软件,下载模型,进行配置和运行。虽然步骤不算复杂,但对普通用户来说门槛仍然较高。大家可能更希望像使用云服务一样,只需打开网页浏览器访问一个URL,就能轻松运行本地LLM。 实现这一目标的关键技术是WebGPU。本文将介绍如何利用Web浏览器和WebGPU轻松运行本地LLM,并推荐几个可以立即体验的相关网

AI资讯

AI资讯日本NTT公司成功开发出全球首创的推理技术,能够在不降低精度的情况下缩减大型语言模型(LLM)中的输入输出单位“Token”的词汇量,实现不同LLM之间Token词汇的统一。 大型语言模型通过“Token”这一单位处理文本,推理时会基于概率预测下一个Token。然而,不同LLM使用的Token词汇通常各不相同,这导致模型之间无法直接比较或共享推理过程中的预测结果,形成了所谓的“词汇壁垒”。因此,