AI资讯

AI资讯数百万美国人选择与AI对话代替看医生,却收到严重错误的医疗建议

尽管谷歌的人工智能不再建议用户“吃石头”或自信地告诉用户在披萨上涂胶水,但即使是最先进的AI聊天机器人在提供医疗建议方面仍然表现极其不可靠。 本周发表在《JAMA Network Open》期刊上的一项新研究中,研究人员让21个前沿大型语言模型(LLMs)在面对真实且患者可能提出的症状时“扮演医生”角色。 结果令人震惊。当面对可能对应多种疾病的模糊症状时,AI的失败率超过80%;即使是包含体检发

按标签聚合查看文章内容。

AI资讯

AI资讯尽管谷歌的人工智能不再建议用户“吃石头”或自信地告诉用户在披萨上涂胶水,但即使是最先进的AI聊天机器人在提供医疗建议方面仍然表现极其不可靠。 本周发表在《JAMA Network Open》期刊上的一项新研究中,研究人员让21个前沿大型语言模型(LLMs)在面对真实且患者可能提出的症状时“扮演医生”角色。 结果令人震惊。当面对可能对应多种疾病的模糊症状时,AI的失败率超过80%;即使是包含体检发

AI资讯

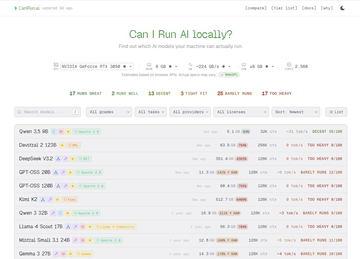

AI资讯自从ChatGPT问世以来,以大型语言模型(LLM)为核心的人工智能技术迅速普及。其中,能够在个人电脑或智能手机上本地运行LLM的“本地LLM”也逐渐受到关注。 然而,对于初学者来说,最大的难题之一是完全无法判断自己当前设备能够运行多大规模的模型,性能表现如何。 在本地运行LLM时,几乎成为事实标准的“LM Studio”软件可以自动检测电脑的硬件规格,判断现有的GPU和内存容量是否足以加载模型

AI资讯

AI资讯美国Unigen公司于4月13日(当地时间)发布了搭载其自主研发AI加速芯片「EdgeCortix SAKURA-II」的E1.S接口AI加速模块「Amaretti E1.S」。 【11时52分更正】文章最初误称为M.2接口,现已更正为E1.S接口,特此致歉。 Amaretti E1.S是一款功耗仅10瓦,AI处理性能高达60TOPS的E1.S接口AI加速器。它支持最大32GB内存,凭借每瓦6T

AI资讯

AI资讯专家警告,大型语言模型未能覆盖绝大多数口语交流,这一盲点可能带来深远影响。

AI资讯

AI资讯人工智能是一个深奥且复杂的领域。该领域的科学家们常用专业术语来解释他们的研究内容,因此我们在报道人工智能行业时也不得不使用这些技术词汇。为此,我们整理了一份术语表,定义了文章中常用的一些重要词汇和短语。 我们将定期更新这份术语表,随着研究人员不断发现推动人工智能前沿的新方法,同时识别新兴的安全风险,我们会添加新的条目。 AGI 人工通用智能(AGI)是一个模糊的概念,通常指的是在许多甚至大多数任务

AI资讯

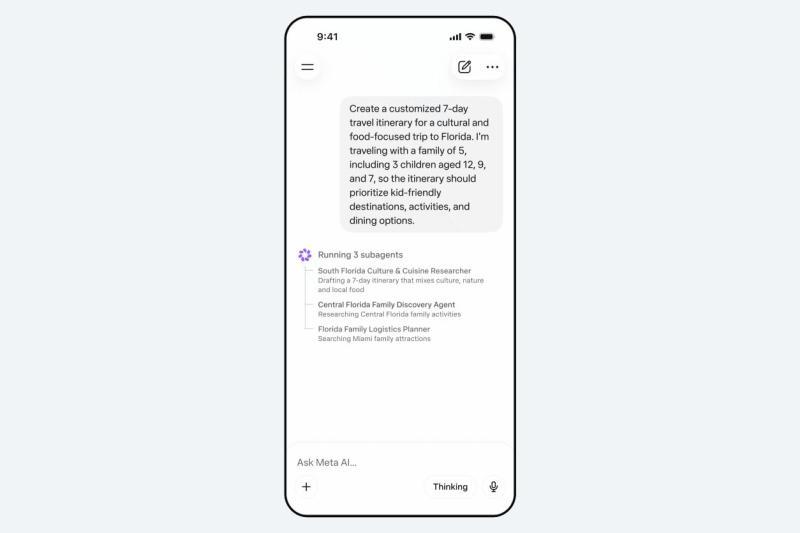

AI资讯Meta推出专为产品设计的高效大型语言模型,支持多模态推理,未来将应用于多平台。

AI资讯

AI资讯在我们全新系列《初创企业如何利用Claude构建产品》中,我们聚焦那些通过AI改变行业的高速成长企业。本文分享了Carta Healthcare开发其临床数据抽取平台Lighthouse背后的工程经验,以及为什么在构建大规模AI系统时,语境工程与模型能力同等重要。 临床登记库收集具有相同诊断、手术或病症患者的标准化数据。医院向登记库提交数据以进行结果对比、发现护理缺口并推动质量改进,但登记库的价值

AI教程

AI教程人工智能代理简介及应用场景 欢迎参加“人工智能代理入门”课程!本课程将为您提供构建人工智能代理的基础知识和实用示例。 加入Azure AI Discord社区,与其他学习者和AI代理开发者交流,解答您在课程中的疑问。 课程开始,我们将深入了解什么是人工智能代理,以及如何在应用程序和工作流程中有效使用它们。 课程内容 本课涵盖: 什么是人工智能代理及其不同类型? 人工

AI资讯

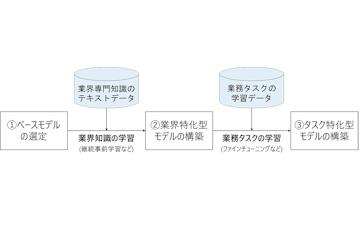

AI资讯日本国家野村综合研究所(NRI)于27日宣布,在日本经济产业省及国立研究开发法人新能源·产业技术综合开发机构(NEDO)支持的生成式AI开发力强化项目“GENIAC(Generative AI Accelerator Challenge)”第三期(2025年8月至2026年3月)中,成功提升了针对特定行业和任务的大型语言模型(LLM)的构建方法的精度与效率。 NRI将该LLM集成到AI代理系统中,

AI资讯

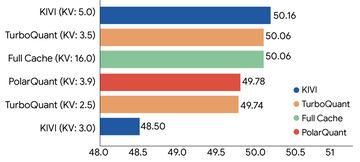

AI资讯美国谷歌公司发布了一种名为“TurboQuant”的压缩算法,旨在解决大型语言模型(LLM)运行时大量内存消耗的问题。该算法通过向量量子化技术,将内存使用量降低至原来的六分之一。详细内容预计将在2026年4月23日召开的国际学习表征会议(ICLR 2026)上公布。 当前的人工智能技术通过向量来理解和处理语言、图像等信息。虽然向量技术强大,但它们会消耗大量内存。为了让计算机无需低速搜索庞大数据库

AI资讯

AI资讯随着人工智能在编辑和媒体领域的广泛应用,各大网站纷纷制定相关使用规范。本周,维基百科宣布禁止编辑者使用AI生成的文本,尽管并未完全禁止AI参与其编辑流程。 根据最新的政策更新,维基百科明确规定“禁止使用大型语言模型(LLM)生成或重写条目内容”。这一新规定对之前较为模糊的表述进行了明确,之前的政策仅表示“LLM不应被用来从零开始生成新的维基百科条目”。 AI在维基百科条目中的使用已成为该网站庞大且

AI资讯

AI资讯2026年3月5日发布的LTX-2.3版本,在本地AI生成视频领域迈出了重要一步。该版本支持同时生成对白、旁白、背景音乐和音效,支持HD及全高清分辨率,视频最长可达20秒。 这让人不禁想尝试能否制作出类似日本Sora 2的视频作品。Sora 2的核心在于能够从简单的提示词自动生成多个场景、对白和音乐,连剧情构思也实现自动化。要在本地复现这一点,LTX-2.3之前还需加入剧情生成模块,而利用大型语