AI资讯

AI资讯企业惨痛教训:用人类培训AI替代工作引发安全与法律危机

一家AI公司雇佣急需工作的人员训练AI模型,却因黑客攻击引发多起诉讼,暴露出AI供应链的脆弱性。

按标签聚合查看文章内容。

AI资讯

AI资讯一家AI公司雇佣急需工作的人员训练AI模型,却因黑客攻击引发多起诉讼,暴露出AI供应链的脆弱性。

AI资讯

AI资讯一名旧金山女子控告OpenAI,指控ChatGPT助长其暴力跟踪者的妄想,且在她请求帮助时未予以干预。

AI资讯

AI资讯纽约时报此前对一家AI驱动的医疗营销初创公司Medvi进行了正面报道,但忽略了其面临的监管和法律问题,现已补充相关内容。

AI资讯

AI资讯六个月前,AI数据训练初创公司Mercor刚刚完成了一轮3.5亿美元的C轮融资,估值达到100亿美元,正处于高速发展阶段。然而,3月31日该公司承认遭遇数据泄露事件后,陷入了前所未有的困境。 据称,一个黑客组织声称从Mercor系统中窃取了4TB的数据,涉及候选人档案、个人身份信息、雇主数据、源代码以及API密钥等敏感信息。Mercor尚未确认数据的真实性,仅表示正在调查此事,并将继续与客户和承包

AI资讯

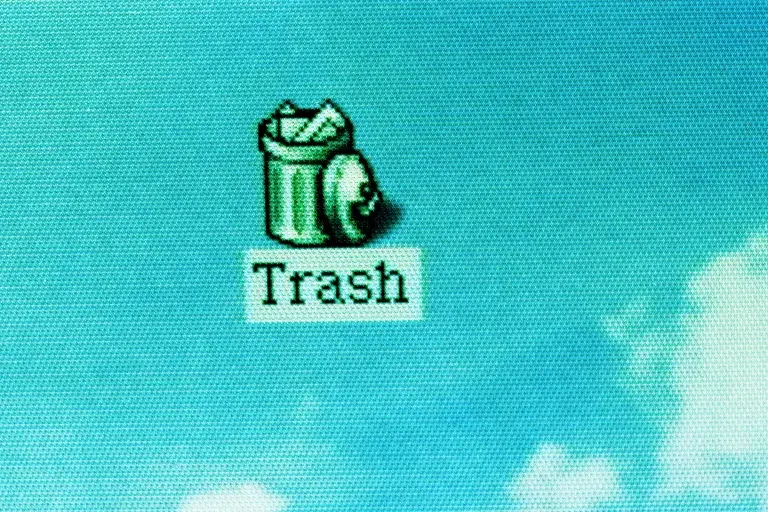

AI资讯一位联邦法官支持Anthropic公司,在其与特朗普政府的复杂法律争斗中,授予该科技公司针对政府近期将其标记为“供应链风险”的命令的禁令。据《华尔街日报》报道, 加利福尼亚北区联邦法官丽塔·F·林周四下令特朗普政府撤销将Anthropic认定为安全风险的最新决定,并停止要求联邦机构与该公司断绝合作的命令。 林法官在庭审中表示:“这看起来像是试图削弱Anthropic。”她最终认为政府的命令侵犯了该

AI资讯

AI资讯法官林表示,五角大楼将Anthropic公司列为供应链风险,似乎是在“试图削弱”该公司。她认为,这种做法看起来像是在惩罚Anthropic,因为该公司试图将合同争议公之于众,这显然可能违反了第一修正案。 Anthropic已提起两起联邦诉讼,指控特朗普政府将其列为安全风险的决定属于非法报复。政府是在Anthropic推动限制其人工智能技术军事用途后,才对其贴上这一标签。周二的听证会是在旧金山提起的

AI资讯

AI资讯大英百科全书及其子公司韦氏词典起诉OpenAI,指控其未经授权使用受版权保护的内容训练AI模型,这是继起诉Perplexity后的又一起法律行动。

AI资讯

AI资讯Anthropic于上周五下午向加州联邦法院提交了两份宣誓声明,反驳五角大楼称该AI公司对国家安全构成“不可接受风险”的说法,并指出政府的指控基于技术误解以及在数月谈判期间从未提出的主张。 这两份声明随同Anthropic针对国防部的诉讼回复文件一并提交,案件将于3月24日(周二)在旧金山由法官Rita Lin审理。 争议始于2月底,当时特朗普总统和国防部长Pete Hegseth公开宣布与Ant

AI资讯

AI资讯三名匿名原告在加州联邦法院提起诉讼,指控埃隆·马斯克旗下公司xAI未能阻止其AI模型生成可识别未成年人的性虐待图像。

AI资讯

AI资讯美国司法部坚称将Anthropic列为“供应链风险”符合宪法,预计诉讼将失败。争议源于Anthropic限制Claude模型的军事用途,政府强调法律合规与惩罚措施。

AI资讯

AI资讯一对佛罗里达夫妇因拖欠几百美元的业主协会费用,选择不直接争议费用本身,而是借助生成式人工智能(AI)自行起诉业主协会,声称州法律使得收取费用非法。他们利用AI不断生成大量法律文件,导致案件迅速失控,甚至引用了1970年针对有组织犯罪的《反敲诈勒索及腐败组织法案》(RICO),提出业主协会及其律师涉嫌大规模阴谋欺诈业主。 这对夫妇的诉讼文件数量激增,内容越来越荒诞,律师称他们“像挥舞着剑攻击任何可能

AI资讯

AI资讯美国司法部律师在旧金山联邦法院提交的文件中表示,“第一修正案并不赋予Anthropic单方面对政府合同条款进行强加的权利,Anthropic未能提供任何支持这一激进结论的依据。” Anthropic正在两个法院地点挑战五角大楼对其施加的限制标签,该标签可能因安全漏洞担忧而禁止公司参与国防合同。Anthropic认为,特朗普政府在贴标签并阻止其技术在国防部内部使用时超越了权限。如果该限制持续,Ant