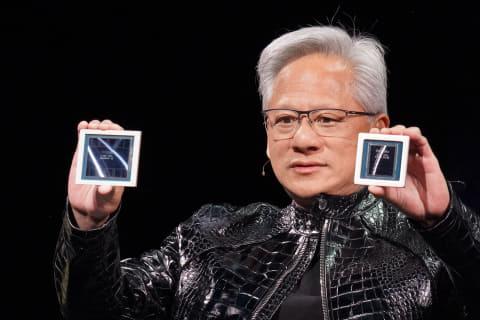

2026年3月16日,日本NVIDIA在其年度AI解决方案盛会GTC 2026上举行了由联合创始人兼CEO黄仁勋主持的主题演讲。演讲中,NVIDIA宣布将整合此前与Groq签订非独占许可协议的推理加速器LPU技术,应用于其AI数据中心产品。

基于Groq技术的Groq 3 LPU推理加速器发布

NVIDIA此次发布的“Groq 3 LPU”是一款专注于AI推理的加速器,采用了2025年底与Groq签订许可协议的技术。Groq专注于开发低延迟、低功耗的AI推理加速器LPU(语言处理单元),其架构通过流水线式数据处理和芯片内SRAM大幅减少了芯片间数据传输和外部内存访问,从而显著降低了功耗。

传统CPU和GPU架构中频繁的芯片间通信和内存访问是功耗增加的主要原因,而LPU通过优化这两方面,实现了同等计算任务下更低的能耗。

Groq 3 LPU的主要规格如下:

| 项目 | Rubin GPU | Groq 3 LPU | 对比 |

|---|---|---|---|

| 内存 | 288GB HBM4 | 500MB SRAM | 1/500 |

| 内存带宽 | 22TB/s | 150TB/s | 7倍 |

| 性能 | 50PFLOPS (NVFP4) | 1.2PFLOPS (FP8) | 1/25 |

| 晶体管数量 | 3360亿 (芯片+HBM4) | 980亿 (芯片) | 约29% (芯片) |

Groq 3 LPU配备500MB SRAM,内存带宽高达150TB/s,性能为1.2PFLOPS(FP8精度)。虽然内存容量和性能较Rubin GPU较低,但内存带宽提升了7倍,晶体管数量也大幅减少,预示其功耗将显著降低。

NVIDIA将Groq 3 LPU以机架形式提供,称为“NVIDIA Groq 3 LPX推理加速机架”,每个机架内集成256个Groq 3 LPU。该产品设计与NVIDIA于今年1月CES发布的基于Vera Rubin的NVL72机架服务器配合使用,前者适合低延迟、高能效的中小规模推理任务,后者则适合超大规模模型的高吞吐量需求。

NVIDIA表示,结合Rubin基的NVL72和Groq 3 LPX后,整体吞吐量提升35倍,性价比提升约10倍。

Vera CPU架构细节及256核Vera CPU机架发布

今年1月CES上,日本NVIDIA发布了基于Arm架构的新CPU“Vera”和新GPU“Rubin”,并推出了搭载这些芯片的“NVIDIA Vera CPU机架”。此次GTC 2026上,NVIDIA进一步披露了Vera CPU的详细架构。

Vera CPU采用自研的基于Armv9.2的“Olympus核心”,每颗CPU集成88个核心。Olympus核心具备10宽指令解码器、基于神经引擎的分支预测技术(每时钟周期可进行两次分支预测),以及针对PyTorch优化的指令缓冲区。与上一代Grace相比,Vera实现了1.5倍的每时钟周期指令执行数(IPC)。

Vera支持SOCAMM LPDDR5内存,最大容量1.5TB,带宽达到1.2TB/s,功耗仅为上一代的一半,带宽提升两倍。

此外,Vera支持第6代NVLink,GPU连接带宽达1.8GB/s,CPU间NVLink支持最多连接两颗CPU。

基于这些特性,Vera CPU机架可容纳最多256颗Vera CPU,配备最高400TB LPDDR5内存(带宽300TB/s)和64颗NVIDIA BlueField-4 DPU(用于卸载CPU网络负载),整体性能约为上一代Grace的两倍。

目前推理任务多依赖x86架构的AMD或Intel CPU,NVIDIA希望通过Vera及其机架产品抢占这一市场,成为其重要战略产品。