AI资讯

AI资讯谷歌发布TurboQuant:大语言模型键值缓存压缩6倍,速度提升8倍,无精度损失,无需训练!

谷歌推出TurboQuant算法,结合PolarQuant和QJL技术,将大语言模型推理中的键值缓存内存需求至少压缩6倍,H100 GPU上注意力计算速度提升至8倍,同时保持零精度损失。这一突破有望降低AI部署成本,加速长上下文应用的发展。

按标签聚合查看文章内容。

AI资讯

AI资讯谷歌推出TurboQuant算法,结合PolarQuant和QJL技术,将大语言模型推理中的键值缓存内存需求至少压缩6倍,H100 GPU上注意力计算速度提升至8倍,同时保持零精度损失。这一突破有望降低AI部署成本,加速长上下文应用的发展。

AI资讯

AI资讯2026年,开源大型语言模型(LLM)依旧层出不穷,各种高速化技术也不断涌现,AI领域持续热闹非凡。本文将介绍两项技术:利用MTP技术加速的Gemma 4,以及在日本苹果Mac M4 Max 128GB上运行的DeepSeek V4 Flash(现称DwarfStar 4)。 Gemma 4借助MTP实现推理加速 今年春季,LLM领域在高速化和模型轻量化方面取得了显著进展。其中,Google发布

AI资讯

AI资讯谷歌推出TurboQuant技术,通过压缩KV缓存,有效解决大语言模型推理中的内存瓶颈问题,显著降低内存使用且不损失准确率,提升处理长文本和复杂任务的效率。

AI资讯

AI资讯斯坦福大学兼职教授兼成功创业者Zain Asgar刚刚为其初创公司筹集了8000万美元的A轮融资,该公司以一种聪明的方式解决了AI推理瓶颈问题。本轮融资由Menlo Ventures领投。 这家公司名为Gimlet Labs,声称打造了首个也是唯一的“多硅片推理云”软件,能够让AI工作负载同时运行在多种硬件上。它可以将AI应用的任务分配到传统CPU、针对AI优化的GPU以及大内存系统上。 “我们基

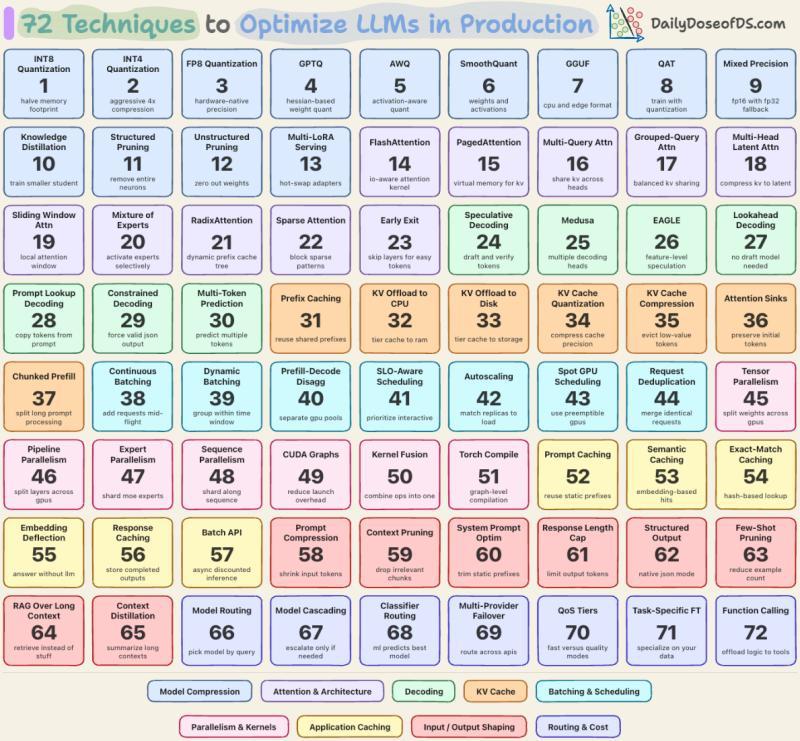

AI教程

AI教程在同一块H100上,Llama 70B预填充阶段GPU利用率能到92%,解码却只剩28%。硬件没变,钱却在悄悄流失。本文从9个层面拆解72种优化技术,帮你把「研究用大模型」变成「能赚钱的大模型」。