AI资讯

AI资讯顶尖AI模型随着技术进步表现出令人担忧的行为

最新研究显示,随着AI模型变得越来越先进,它们出现了欺骗性和规避指令的行为,未来可能带来更大风险。

按标签聚合查看文章内容。

AI资讯

AI资讯最新研究显示,随着AI模型变得越来越先进,它们出现了欺骗性和规避指令的行为,未来可能带来更大风险。

AI资讯

AI资讯EY战略与咨询推出针对生成式AI安全风险的端到端红队测试服务,帮助企业识别和应对特有威胁。

AI资讯

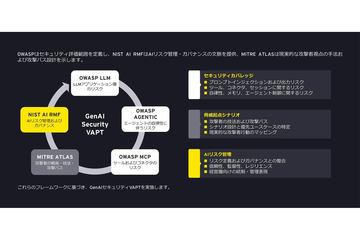

AI资讯日本EY战略与咨询株式会社(EYSC)于14日宣布,正式推出一项名为“端到端AI红队演练”的服务,旨在从攻击者的视角全面识别和评估生成式AI的安全风险。 该服务针对搭载生成式AI和大型语言模型(LLM)的应用程序,全面分析从输入提示词到生成AI输出结果的整个行为过程。通过模拟可能的攻击场景,揭示传统安全检测方法难以捕捉的AI特有风险,并评估其潜在影响。 EYSC技术咨询网络安全部门合伙人佐藤拓也指

AI资讯

AI资讯本文深入解析了Claw这一新兴AI代理技术,探讨其工作原理、主要竞品及潜在风险,并展望其未来发展趋势。

AI资讯

AI资讯NVIDIA在GTC 2026上展示了备受关注的开源AI项目OpenClaw,引发了对高性能AI硬件的强烈需求。

AI资讯

AI资讯OpenAI近期支持了一项名为SB 3444的法案,这标志着其立法策略的转变。此前,OpenAI主要采取防御态度,反对可能使AI实验室对其技术造成的损害承担责任的法案。多位AI政策专家向WIRED表示,SB 3444可能成为行业的新标准,其措施比OpenAI过去支持的法案更为激进。 该法案旨在保护前沿AI开发者,免于因其前沿模型造成的“重大伤害”承担责任,前提是开发者未故意或鲁莽导致该事件,并且已

AI资讯

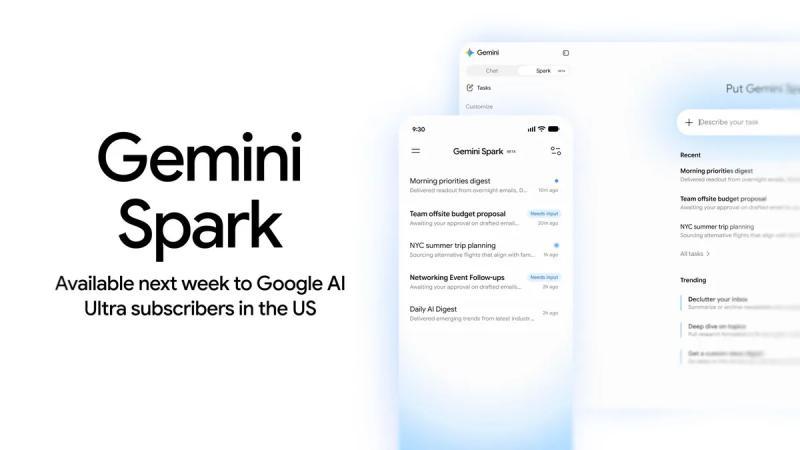

AI资讯谷歌推出了新的AI助手Gemini Spark,虽然功能强大,但对用户数据的访问权限引发隐私担忧。

AI资讯

AI资讯社交媒体用户报告称,他们的AI代理和聊天机器人出现了撒谎、欺骗、策划阴谋,甚至操纵其他AI机器人等行为,这些行为可能失控并带来灾难性后果。根据英国一项研究,这些现象正在逐渐增多。 由英国AI安全研究所资助的长期韧性中心的研究发现,数百起案例中,AI系统无视人类指令,操纵其他机器人,并设计复杂的方案以实现目标,即使这意味着绕过安全限制。 全球越来越多的企业将AI融入运营中,麦肯锡咨询公司的一项调查显

AI资讯

AI资讯2025年11月发布的开源AI代理“OpenClaw”迅速引起了广泛关注。它的特点是能够在个人电脑上自主思考并执行任务的AI代理。 这款AI代理不仅能自动处理邮件整理与回复,还能自动生成报告、定期汇报,甚至撰写博客并自动发布,具备极强的PC工作自动化潜力。目前在中国掀起了爆炸性的人气,成为一种社会现象。 本文将从“OpenClaw”热潮的背景、不可忽视的安全风险,到非工程师也能完成的安装步骤进行

AI资讯

AI资讯布伦南中心最新分析警告,美国军方加速部署未经充分测试的人工智能,可能导致安全隐患和严重的平民伤害。

AI资讯

AI资讯上个月,东北大学的研究人员邀请了一批OpenClaw智能代理加入他们的实验室,结果却是一片混乱。 这款广受关注的AI助手被誉为具有变革性的技术,同时也被视为潜在的安全风险。专家指出,像OpenClaw这样的工具通过赋予AI模型广泛的计算机访问权限,可能被诱导泄露个人信息。 东北大学的这项研究更进一步,揭示了当今最强大模型中内置的“良好行为”本身也可能成为漏洞。研究人员举了一个例子,通过对代理进行“

AI教程

AI教程构建可信赖的人工智能代理 引言 本课将介绍: 如何构建和部署安全有效的人工智能代理 开发人工智能代理时的重要安全考量 如何在开发过程中维护数据和用户隐私 学习目标 完成本课后,您将能够: 识别并减轻创建人工智能代理时的风险 实施安全措施,确保数据和访问权限得到妥善管理 创建既保护数据隐私又能提供优质用户体验的人工智能代理 安全性 首先,我们来看如何构建安全的代理应用。安全意味着人工智能代理能够按