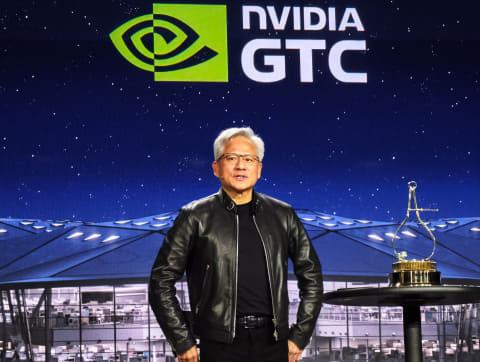

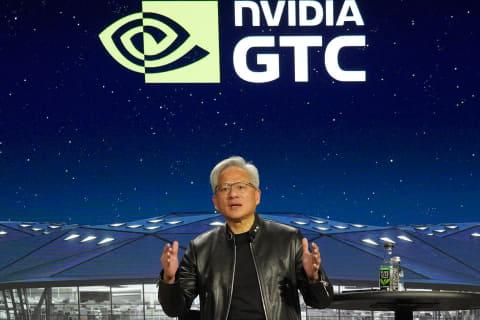

NVIDIA于2026年3月15日至19日举办了年度AI解决方案盛会GTC 2026。3月16日,NVIDIA CEO黄仁勋在活动第二天参加了问答环节,介绍了新产品和战略规划。

从1999年推出“GeForce 256”到2006年引入CUDA

黄仁勋自1993年创立日本NVIDIA以来,一直担任CEO,是公司历史上唯一的CEO。NVIDIA最初专注于PC图形芯片,1995年推出了“NV1”图形芯片,随后1997年发布“RIVA 128”,1998年“RIVA TNT”,1999年“RIVA TNT2”,在PC图形市场获得广泛认可。

1999年9月,NVIDIA发布了“GeForce 256”,首次使用了GPU(图形处理单元)这一术语,奠定了GPU作为图形芯片名称的行业标准。值得一提的是,当时的发布会在英特尔年度活动“Intel Developer Forum”举办的酒店房间内举行,显示出当时NVIDIA相较于巨头英特尔的规模仍较小。如今,经过25年,两者的市场地位已发生巨大变化。

2006年,NVIDIA发布了CUDA,这是一款由现任企业事业部负责人伊恩·巴克和斯坦福大学学生团队开发的软件。黄仁勋敏锐地发现了CUDA的潜力,将巴克团队纳入公司,并正式发布CUDA。2026年正值CUDA发布20周年,黄仁勋在GTC开幕演讲中也特别提及了这一里程碑。

当时的GPU主要用于3D图形处理,专注于PC和游戏机的3D游戏,架构复杂且不易通用。Windows通过驱动和Direct3D等API抽象GPU,实现软件兼容性。CUDA则将GPU抽象为统一的指令集架构(ISA),使得不同代GPU对应用程序呈现一致接口,类似于x86 CPU的兼容性,极大推动了GPU的通用计算应用。

2010年代中期,深度学习AI兴起,研究者们发现用CPU训练模型耗时数月,而采用GPU+CUDA后训练时间缩短至数天甚至数小时,GPU迅速成为AI开发不可或缺的计算平台。

近年来,生成式AI模型规模大幅增长,GPU从单卡使用发展到数据中心集群,规模从最初的8卡扩展到72卡,甚至通过2019年收购的Mellanox网络技术,实现了数千至数万GPU的规模化连接。CUDA的抽象能力使得无论是单卡还是大规模集群,软件无需修改即可扩展性能。

目前,云服务巨头和大型企业纷纷部署GPU,NVIDIA 2026财年营收达到2159亿美元,同比增长65%,远超行业平均水平。

黄仁勋:NVIDIA已成为AI推理领域的领导者

在GTC的媒体问答环节,黄仁勋面对数百名记者的提问,耐心回答并延长了30分钟。针对NVIDIA以创纪录的200亿美元收购Groq,黄仁勋表示,NVIDIA已在AI推理市场占据领导地位,第三方机构也予以认可。2025年起,NVIDIA加大推理领域投入,推出NVL72、NVFP4、Dynamo等解决方案,并稳步推进。

关于AI数据中心建设的资金风险及Groq与自家GPU产品的竞争问题,黄仁勋指出,推理市场潜力从2025年估计的5000亿美元提升至1万亿美元,涵盖Blackwell和Vera Rubin GPU解决方案,以及单独销售的Vera CPU机架,Groq也在其中。AI数据中心建设可提升经济价值25%,随着趋势加速,市场规模有望达到1.5万亿美元。存储系统性能提升也将成为未来增长点。

NVIDIA不仅提供GPU,还提供从硬件到软件的全栈AI数据中心解决方案,成为客户构建AI工厂和数据中心的重要合作伙伴。60%的数据中心业务来自五大云服务商,这些客户利用NVIDIA技术为其客户提供AI解决方案。

针对Vera CPU是否会取代x86在数据中心的角色,黄仁勋表示,Vera专为数据密集型工作负载和电力受限环境设计,性能是现有CPU的两倍以上,采用LPDDR5内存,单线程性能世界领先。云服务商过去追求最大核心数以降低成本,但AI需求不同,CPU需保证GPU持续高效运行,Vera Rubin正是为此设计,支持存储、CPU、网络、计算及代理型AI工作负载。

关于新Rubin是否会替代Blackwell,黄仁勋认为这取决于客户数据中心建设阶段,类似iPhone不同代产品共存,预计Vera Rubin的99%销售为新增市场。

谈及推理新精度NVFP4,黄仁勋介绍其与Tensor核心引擎紧密结合,能动态调整计算精度,节能同时提升计算量,推动GPU计算效率大幅提升。利用Vera Rubin和NVL72架构,同功耗下性能提升35倍。未来AI不仅是大型语言模型,更是代理型系统。

推进内存节能,采用LPDDR6的Rosa平台

黄仁勋表示,NVIDIA提供全栈AI数据中心产品,涵盖GPU、CPU及多种内存技术(HBM、LPDDR、SRAM),选择最适合的方案。当前其他厂商数据中心CPU多用DDR4/5,能效较低,NVIDIA率先在Grace和Vera采用LPDDR5,未来Rosa将采用LPDDR6。

AI对内存需求巨大,涉及短期记忆、工作记忆和超大记忆层次,未来推理和代理型AI广泛应用,需数万亿美元投资,半导体制造将更加繁忙。NVIDIA与拥有全球顶尖制造能力的日本台湾TSMC紧密合作,Groq LPU则与三星合作制造,同时与内存、网络、硅光子供应链伙伴协作。

对于美国商务部长提出将台湾制造能力40%迁至美国的目标,黄仁勋认为短期内难以实现,TSMC不仅是工厂,还构建了完整供应链,无法一夜搬迁。TSMC已在美国亚利桑那州布局供应链,但全球半导体需求持续增长,短期内难达成40%。

DLSS 5实现更高画质,OpenClaw改变工作方式

黄仁勋介绍,DLSS是神经图形技术,结合生成式AI提升图形表现。Cosmos是专注3D物体的世界AI模型,推动“扩展生成搜索”,基于文本和事实数据生成内容。数据库如SQL仍然重要,保证生成内容的真实性,人类可介入控制生成结果。

关于游戏数据对世界AI模型的作用,黄仁勋指出部分游戏物理不严谨,需谨慎使用,但结合现实观测数据可辅助训练。随着技术进步,3D图形控制的世界AI模型甚至能生成训练数据,拓展未来可能。

OpenClaw作为开源代理型AI工具,使用简单,用户只需指示目标,AI自动学习和执行任务。NVIDIA内部广泛应用OpenClaw,显著提升工作效率和项目进度。AI并未减少工作量,反而因效率提升使工作更繁忙。历史上PC、互联网、移动设备都曾带来类似变化,AI将极大缩短任务完成时间,改变生活方式。

对日本制造业的启示:跳过IT革命,直接拥抱AI

黄仁勋谈及中国市场,表示NVIDIA已获得美国政府许可,正在恢复向中国客户供应H200芯片,供应链重建顺利,未来将带来好消息。美国前总统特朗普强调美国应保持技术领导地位,防止不必要的市场流失,NVIDIA持有H200许可并已有订单,黄仁勋对此持乐观态度。

谈及未来十年风险,黄仁勋的管理哲学是“不裁员、不无聊、不死亡”,即保持员工稳定,避免公司陷入惰性,持续创新。

针对中东战争及台湾局势对公司影响,黄仁勋表达对以色列和台湾员工的关切,强调公司全力支持员工,期望各方保持冷静与和平,共同度过难关。

关于欧洲市场,黄仁勋指出德国、日本和瑞典在机电一体化领域领先,制造业严格要求产品完美,软件则习惯先发布后修正,文化差异导致美国主导IT革命。但现在有了OpenClaw,用户无需编程即可指令AI,跳过IT革命直接进入AI时代,为德国和日本制造业带来新机遇。AI与机电一体化融合将推动机器人产业飞跃发展。