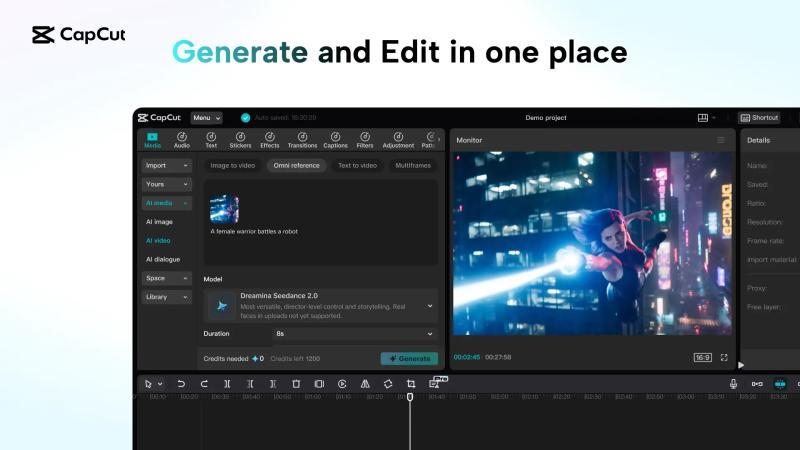

OpenAI可能正在减少其在视频生成市场的投入,近期关闭了其Sora应用,但字节跳动周四确认,其最新的音视频生成模型Dreamina Seedance 2.0已开始在其视频编辑平台CapCut中逐步推出。

字节跳动表示,该模型允许创作者通过提示词、图片或参考视频来草拟、编辑并同步视频和音频内容。

此次分阶段上线将首先覆盖巴西、印度尼西亚、马来西亚、墨西哥、菲律宾、泰国和越南的CapCut用户,未来将逐步扩展到更多市场。

此前有报道称,Dreamina Seedance 2.0的全球推广曾被暂停,原因是字节跳动正在处理涉及知识产权的争议,这些争议引发了好莱坞的批评,指控其涉嫌版权侵权。这也解释了该模型目前在CapCut中仅限于部分市场上线的原因。

在中国,用户可以通过字节跳动的剪映应用使用该模型。

字节跳动在公告中提到,该视频生成模型即使没有参考图像,仅凭几句描述也能生成场景。CapCut在渲染逼真的纹理、动作和光影效果方面表现出色,支持多种视觉角度,这些功能可用于编辑、增强或修正创作者自己的素材。

此外,创作者还可以利用该模型基于早期概念或草图测试创意,避免在拍摄真实视频前的资源浪费。

Dreamina Seedance 2.0适用范围广泛,包括烹饪教程、健身指导、商业或产品介绍以及动作类视频等,后者历来是AI视频模型的难点。

该模型支持最长15秒的视频片段,涵盖六种画面比例。

在CapCut中,Dreamina Seedance 2.0将应用于多个功能模块,包括AI视频编辑和视频生成工具Video Studio,同时也将接入字节跳动的AI生成平台Dreamina及其营销平台Pippit。

鉴于模型能生成高度逼真的内容,字节跳动已设置安全限制,禁止模型基于含有真实面孔的图片或视频进行生成,同时CapCut也会阻止未经授权的知识产权生成。(如果限制机制完全有效,该模型现在应该已在美国上线,显然仍在进行调整。)

此外,Dreamina Seedance 2.0生成的内容将带有隐形水印,便于在平台外识别模型生成的视频,有助于权利方在必要时提出下架请求。

字节跳动表示,将与专家和创意社区合作,持续迭代和提升模型能力。