日本OpenAI于3月17日发布了全新小型AI模型“GPT-5.4 mini”和“GPT-5.4 nano”。这两款模型继承了GPT-5.4的核心特性,同时实现了更高的速度和更高效的运行性能。

GPT-5.4 mini相比之前的GPT-5 mini,运行速度提升超过两倍,且在编码、推理、多模态理解及工具使用等方面性能显著增强。该模型适合对响应速度要求较高的工作负载,如编码助手和辅助任务的子代理,能够快速响应、稳定调用工具,并高效处理复杂专业任务。

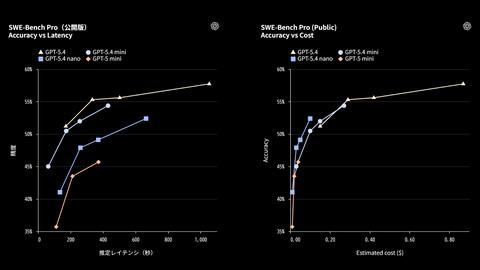

在编码性能基准测试(SWE-Bench Pro)中,GPT-5.4 mini在相似延迟条件下表现优于GPT-5 mini,且在保持高速运行的同时,精度接近GPT-5.4。计算机操作相关基准(OSWorld-Verified)也显示其性能较GPT-5 mini有大幅提升。

该模型已通过ChatGPT、API和Codex提供服务。在ChatGPT中,免费版和Go计划用户可通过选择Thinking模式使用,其他计划用户则在GPT-5.4 Thinking速率限制后自动切换。API支持40万令牌的上下文窗口,费用为每百万输入令牌0.75美元,输出令牌4.5美元。

GPT-5.4 nano则是针对速度和成本优化的最轻量、最快速模型,性能较之前的GPT-5 nano有显著提升。它适合处理分类、数据提取、排序及相对简单的辅助任务,常用作子代理。

GPT-5.4 nano仅通过API提供,费用为每百万输入令牌0.2美元,输出令牌1.25美元。