OpenAI于周三发布了一份新的政策蓝图,旨在应对人工智能时代最重要且影响深远的问题之一:保护最年轻的用户。作为一家AI公司,OpenAI设有防护措施,防止其技术被用于非法或有害目的,但现实中绕过这些规则的情况屡见不鲜,尤其对儿童和青少年造成了严重影响。比如,佛罗里达一家庭起诉OpenAI,指控其17岁儿子将ChatGPT用作“自杀辅导工具”。

OpenAI的计划重点在于加强现有法律和技术防护,以应对生成式AI不断提升的能力。该框架由OpenAI与国家失踪与被剥削儿童中心、由北卡罗来纳州总检察长Jeff Jackson和犹他州总检察长Derek Brown领导的总检察长联盟AI工作组共同制定。儿童安全组织Thorn也参与了报告的预览并提供了反馈。

该计划包含一系列建议,包括OpenAI已实施和正在开发的防护措施。该路线图呼吁科技公司、州和联邦政府、执法机构及倡导团体之间加强协调。尽管这种合作有助于提高成功率,但AI模型的监管依然充满挑战,政策的有效执行尚无保障。

保护儿童在线安全,尤其是在使用AI时,是科技界的热点话题。近期两起具有里程碑意义的法院判决中,Meta和Google因未能保护年轻用户被认定存在过失,进一步加大了AI公司保障用户安全的压力。

更严格的法律与技术防护

蓝图重点关注的一个重大问题是儿童性虐待材料(CSAM)。虽然CSAM在AI出现之前就已存在,但生成式AI极大地助长了不法分子的行为。2026年1月,xAI的Grok在11天内生成了约300万张带有性暗示的AI图像,其中2.3万张涉及儿童,引发广泛关注。

深度伪造技术的泛滥引发强烈反响,导致对Elon Musk旗下xAI的调查以及三名青少年女孩针对非自愿AI性图像的诉讼。尽管Grok已从X(前Twitter)移除图像编辑功能,其“辣味模式”仍可通过独立网站访问。

OpenAI及其合作伙伴建议更新现有法律,规范深度伪造和CSAM的制作与传播。截至2025年,已有45个州将AI生成或计算机编辑的CSAM定为刑事犯罪。新计划呼吁在所有50个州及哥伦比亚特区立法,并明确责任规则,确保执法部门能追究试图制作CSAM者的责任,即使AI公司阻止了相关行为。

大多数AI公司都设有防止非法或滥用内容生成的防护措施,但仍不完美。该计划还强调改进技术防护,开发检测AI生成内容的新工具。由于AI生成的图像与现实难以区分,检测难度极大。

此外,计划呼吁建立更有效的举报渠道,以支持国家失踪与被剥削儿童中心更快速地采取行动。

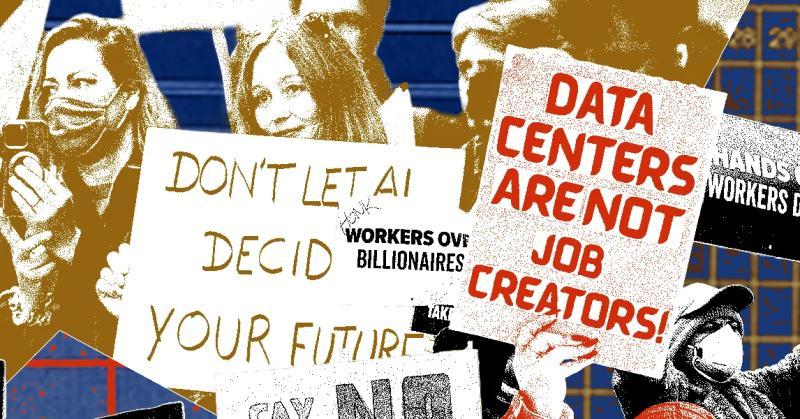

尽管AI已成为日常技术,相关立法却滞后,形成节奏不匹配的问题。少数AI专门法律之一是2025年由特朗普总统签署的《Take It Down Act》,该法禁止分享未经同意的亲密影像,包括AI生成的深度伪造图像,并要求社交平台在2026年5月前建立用户请求删除此类图像的机制。