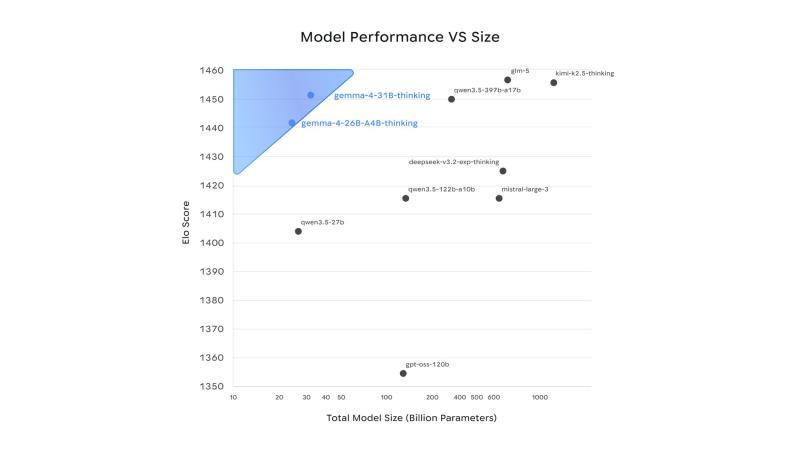

谷歌DeepMind最新发布的Gemma 4系列模型,为开源AI模型领域带来了极具突破性的进展。继Allen Institute团队的突然离职和GPT-OSS项目的不确定性后,Gemma 4的发布无疑为美国开源模型的未来注入了强心剂。31B参数的密集版本在性能上与Kimi K2.5(744B-A40B)和Z.ai GLM-5(1T-A32B)等顶尖模型不相上下,但参数量远低于它们,同时采用了多种创新架构设计:

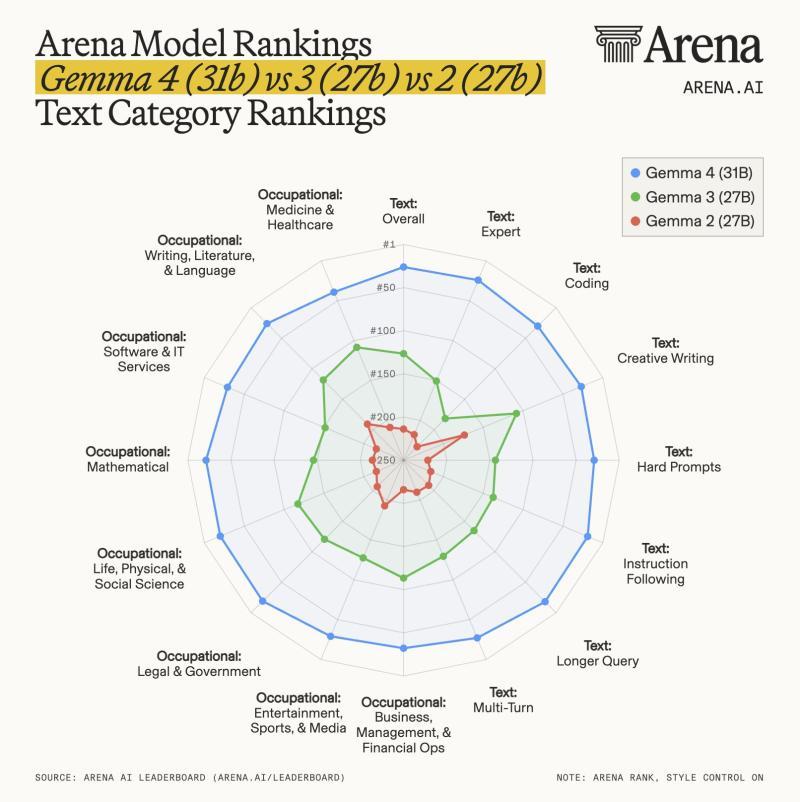

从Arena发布的历年排名趋势图可以看出,Gemma 4在多个标准基准测试(如GPQA和AIME)中相较Gemma 3有显著提升:

此次Gemma 4采用了更为宽松的Apache 2.0许可证,支持视频和图像的原生处理,支持可变分辨率,且在OCR和图表理解等视觉任务上表现出色。E2B和E4B版本还原生支持音频输入,具备语音识别和理解能力。

其卓越的本地设备运行能力引发了业界猜测,Gemma 4或将成为苹果与谷歌合作下新一代Siri的基础模型。

主要亮点

- 开源许可:首次采用商业友好的Apache 2.0许可证,极大促进了模型的广泛应用。

- 多模态支持:文本、视觉、音频三模态原生支持,适配多种应用场景。

- 长上下文能力:大型模型支持最长256K的上下文长度,适合复杂推理和代理任务。

- 多样化模型规模:包括31B密集模型、26B MoE模型(活跃参数约4B)及面向移动和物联网的E4B、E2B边缘模型。

架构创新

Gemma 4采用了混合注意力机制和独特的MoE层设计,具体包括:

- 每层嵌入(Per-Layer Embeddings)

- 无显式注意力缩放,可能整合于归一化权重中

- QK和V的归一化处理

- 大模型共享K/V矩阵

- 小模型采用激进的KV缓存共享

- 滑动窗口大小为512和1024

- 部分维度的RoPE编码,局部和全局层使用不同参数

- 软限制机制(softcapping)

- 视觉方面支持原生宽高比处理

- 音频处理采用更小的帧窗口

这些设计使Gemma 4在保持高效推理的同时,具备更强的多模态理解能力。

生态系统支持

Gemma 4发布当天即获得了多款主流本地推理框架的支持,包括:

- llama.cpp

- Ollama(需版本0.20以上)

- vLLM(支持GPU/TPU等硬件)

- LM Studio

- Transformers及transformers.js

- Modular/MAX生产级推理支持

本地推理性能表现优异,例如在M2 Ultra上,Gemma 4 26B A4B版本通过llama.cpp实现了300 tokens/s的实时视频处理速度。

代理与工具链发展

Gemma 4被广泛视为本地代理引擎的理想选择,支持OpenClaw、Hermes等开源代理框架。Hermes Agent已实现多内存提供商的插件式集成,并推出了本地语义索引插件“Enzyme”,实现8毫秒级查询响应。

此外,模型与训练框架的紧密结合(Model–Harness Training Loop)成为提升模型能力的关键路径,LangChain等工具也确认开源模型已足够支持复杂工具调用和文件操作。

其他前沿动态

- Anthropic发布了Claude模型中的“情绪向量”研究,展示了情绪概念对模型行为的调节作用。

- OpenAI推出了ChatGPT在Apple CarPlay上的语音模式,并调整了Codex的计费策略。

- Perplexity发布了面向税务申报的智能代理工作流“Navigate my taxes”。

总结

Gemma 4不仅在模型性能上实现了跨越式提升,更在多模态支持、开源许可和生态系统建设上树立了新标杆。它的发布标志着谷歌DeepMind在推动开源AI模型本地化和多模态应用方面迈出了坚实步伐,未来有望在智能助手、边缘计算等领域发挥重要作用。