注:AIE欧洲活动即将售罄!迈阿密AIE门票和有限赞助机会即将开放——正如社交媒体热议所示,演讲嘉宾们正积极准备中,我们也将参加!

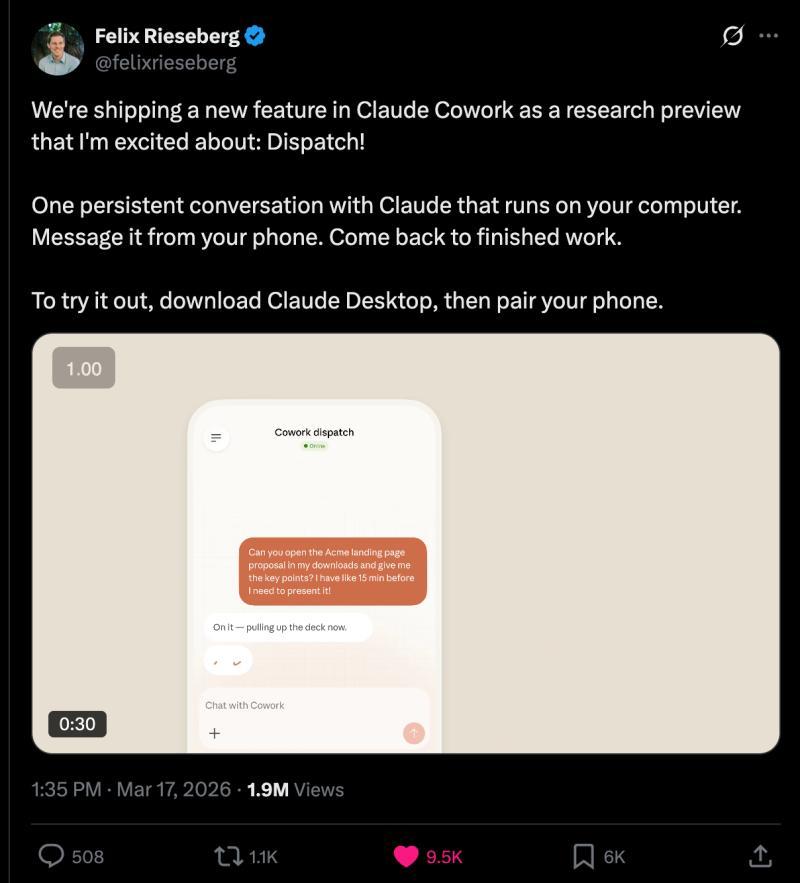

巧合的是,今天的主访嘉宾Felix也发布了本期标题故事:

swyx: Claude Cowork的远程控制功能实现了吗?还没有,对吧?

Felix: 很好的问题。

swyx: 很快就会有。

今天,Felix正式发布了相关内容:

多位业内人士,包括SimonW和Ethan Mollick,都对其表现给予了积极评价,认为其优于OpenClaw。正如昨日Jensen所言,每家公司都需要一套OpenClaw战略。Anthropic曾因与Clawdbot合作失利而备受关注,如今他们带来了一个相当不错的解决方案。

欢迎收听完整播客,了解Claude Cowork的起源故事、应用场景及设计理念,尤其是其在沙箱环境和Electron技术选择上的技术细节。

AI推特动态回顾

OpenAI发布GPT-5.4 Mini/Nano,聚焦小型编码优化模型

- OpenAI推出了GPT-5.4 mini和nano,覆盖API、ChatGPT和Codex。GPT-5.4 mini速度是GPT-5 mini的两倍多,专注于编码、多模态理解和子代理,API支持40万上下文窗口。评测显示mini在多个测试中接近大型GPT-5.4表现,但仅使用30%的Codex配额,成为许多后台编码和子代理的默认选择。

- 开发者关注其编码价值,同时也指出价格较高和真实性权衡。mini的输入价格为0.75美元/千次,输出4.5美元/千次,nano价格也高于之前版本。第三方评测结果不一,部分测试显示推理能力优异,另一些则显示对错误前提的抵抗力较弱。OpenAI也承认行为调优仍有改进空间。

代理基础设施:沙箱、子代理与开放式SWE

- 代码执行代理成为产品架构核心。LangChain推出LangSmith沙箱实现安全的临时代码执行,并开源了模仿Stripe、Ramp和Coinbase内部系统的Open SWE,集成Slack、Linear和GitHub,支持子代理和中间件,推动从聊天助手向可部署工程代理转变。

- 子代理和安全执行成为生态系统主流功能。OpenAI Codex支持子代理,GPT-5.4 mini特别适合此场景。Hermes Agent发布v0.3.0,拥有插件架构、Chrome远程控制、IDE集成、本地语音模式和隐私保护,表明代理价值越来越依赖安全执行环境和可组合技能。

架构研究:层间注意力与Mamba-3模型

- “垂直注意力”引发关注,Moonshot发布Attention Residuals论文,提出跨层注意力机制,扩展了传统序列水平的注意力。社区指出字节跳动也有类似实现,且该方法计算开销较低。

- Mamba-3模型强调推理效率,结合线性和状态空间模型,提升模型强度和解码速度,适合强化学习和长序列推理任务,显示研究者仍在探索减轻Transformer瓶颈的方案。

GTC大会:NVIDIA推动代理与开放模型,强调基础设施

- 黄仁勋强调未来计算机是“代币制造工厂”,推理驱动下一波算力浪潮。LangChain加入NVIDIA Nemotron联盟,Hugging Face发布多款NVIDIA支持的开放模型。

- 企业代理工具备受关注。H Company发布Holotron-12B多模态模型,Perplexity推出面向企业的Comet浏览器,集成CrowdStrike Falcon。黄仁勋指出AI基础设施市场仍处早期,未来潜力巨大。

开源工具、本地代理与开发者生态升级

- 本地和私有代理工作流持续优化。Hugging Face发布CLI扩展,自动匹配本地模型和硬件,Unsloth推出支持500+模型的开源Web UI,训练速度提升两倍,VRAM使用降低70%。Ollama增加网页搜索插件,支持无头模式。

- “开放编码代理”生态逐渐成型,趋向模型无关的执行框架、结构化技能和临时执行环境。LangChain的Deep Agents和Hermes Agent插件系统成为代表,显示代理部署层面创新成为新前沿。

推特热议话题

- OpenAI小模型发布引发广泛关注,尤其在编码代理领域。

- Cursor基于强化学习的上下文压缩技术提升了长程编码任务表现。

- Mamba-3架构更新被视为序列建模领域的重要进展。

- Unsloth Studio开源产品备受本地训练和推理用户欢迎。

- Kimi Attention Residuals论文引发架构设计热议。

Reddit AI社区热点回顾

/r/LocalLlama与/r/localLLM讨论

1. Unsloth Studio发布及功能

- Unsloth Studio作为开源无代码Web界面,支持本地训练和运行500+模型,兼容Llama.cpp,支持Python和bash代码执行、多模态输入,具备自动修复工具调用、数据集自动生成等功能,支持Mac、Windows和Linux。用户对其功能丰富和易用性表示认可,期待AMD支持。

- 部分用户质疑LMStudio是否为高级用户首选,认为vLLM或llama.cpp是更佳替代。

2. Qwen3.5-9B文档基准测试表现

- 阿里巴巴Qwen3.5-9B在文档AI任务中表现优异,尤其在关键信息提取和表格理解方面领先,但在某些OCR和手写识别任务上落后于OpenAI GPT-5.4。其高能效和适合低端硬件运行的特点被看好。

3. Mistral Small 4及DGX Station现状

- Mistral Small 4为1190亿参数混合模型,支持256k上下文,具备推理效率和多模态输入能力,采用128专家的MoE架构,开源许可下支持商业使用。用户关注其激活参数数目及工具调用表现。

- NVIDIA DGX Station通过OEM渠道发售,价格约8.5-9万美元,定位高性能AI工作站,支持先进内存架构但无视频输出,适合企业和研究机构。

非技术AI社区动态

- 关于NVIDIA Nemotron 3 Ultra模型的性能宣称引发质疑,用户关注基准测试的公平性和模型版本。

- Stable Diffusion社区分享了LTX 2.3 LORA模型训练细节及OldNokia UltraReal LoRA复古相机风格模型,展示了AI在创意领域的应用。

- Anthropic CEO预测未来三年内50%入门级白领职位将被AI取代,引发对就业影响的广泛讨论和担忧。

- NBC新闻调查显示美国公众对AI的负面看法超过对ICE的看法,反映出对AI潜力与实际应用之间差距的担忧。

AI Discord频道关闭通知

遗憾的是,Discord渠道今日关闭,我们将不再以此形式提供服务,但新的AINews版本即将发布。感谢大家的支持!