在人工智能伦理与国家安全交汇的敏感时刻,NVIDIA首席执行官黄仁勋于GTC 2026技术大会上公开呼吁科技行业领袖在讨论AI风险时保持克制。他强调,虽然有必要揭示技术潜力,但刻意制造恐慌可能适得其反,甚至削弱国家竞争力。

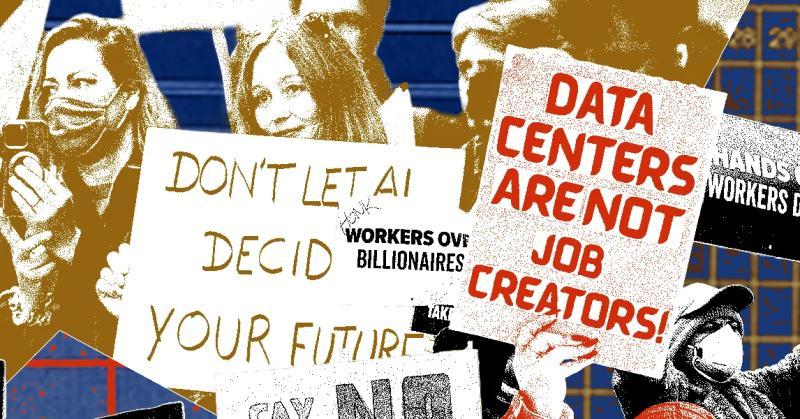

此言论正值AI初创巨头Anthropic与美国政府冲突升级之际。作为Claude聊天机器人的开发者,Anthropic因坚持合同中禁止其AI工具用于国内监控和全自动武器系统的条款,与五角大楼断绝合作。随后,特朗普政府将Anthropic列为“供应链风险”,并计划终止其所有政府项目。

“它是软件,不是生命体”

针对公众舆论中出现的“AI威胁论”,黄仁勋做出了冷静评估。他直言:“AI既非生命体,也非外星生物,没有意识,本质上只是计算机软件。”他警告称,极端、灾难性且无证据的言论可能造成远超想象的实际伤害。

乐观展望:营收或达数万亿美元

尽管Anthropic当前面临法律纠纷和压制危机,黄仁勋对其财务前景持高度期待。他预测,到2030年,Anthropic的营收可能超过1万亿美元,并认为该公司CEO达里奥·阿莫代的预测相对保守。

供应链多元化的战略考量

除了行业争议,黄仁勋还谈及全球芯片制造的风险管理。他重申,AI供应链必须实现多元化布局。为降低过度集中带来的潜在威胁,NVIDIA正积极推进在韩国、日本及美国本土的生产安排,确保这一“战略物资”的供应韧性。

在黄仁勋看来,美国在AI领域面临的最大风险不是技术本身,而是因过度愤怒或偏执导致的技术应用停滞。围绕安全、伦理与国家利益的争斗,正成为重塑AI产业格局的关键力量。