产品详细介绍

通义实验室是阿里云面向大模型与生成式AI推出的统一入口与能力平台,聚合了通义千问大语言模型、万相视觉生成大模型以及多模态交互套件等核心产品,为企业与开发者提供从模型体验、能力调用到行业落地的一体化服务。

1. 千问大语言模型:全能型通用智能底座

通义千问是超大规模预训练的大语言模型,通过万亿级参数规模与海量数据训练,具备以下核心能力:

- 自然语言理解与生成:支持多轮对话、长文本理解、摘要、改写、问答、创意写作等多种文本任务,适用于客服问答、知识助手、内容创作等场景。

- 代码理解与生成:支持多种主流编程语言的代码补全、注释生成、错误定位与修复、算法示例生成,可用于智能编程助手、自动化脚本生成等开发场景。

- 视觉理解:具备图像内容识别、场景理解、物体识别等能力,可结合文字进行图文问答、图文检索等应用。

- 音频理解:支持对音频内容进行识别与理解,可与文本、图像等模态结合,构建更自然的多模态交互体验。

- 工具使用与AI Agent:通过工具调用与Agent框架,千问可以联动搜索、数据库、业务系统等外部工具,实现任务分解、自动执行与结果反馈,适合构建业务助手、运营助手等智能代理。

- 角色扮演与个性化交互:支持设定不同角色人设与语气风格,适用于虚拟IP、陪伴型机器人、教育辅导等拟人交互场景。

通义千问提供从旗舰、均衡到轻量极速等多种规格模型,既能满足高精度复杂任务需求,也能兼顾终端侧、边缘侧的低延迟与低算力部署需求。

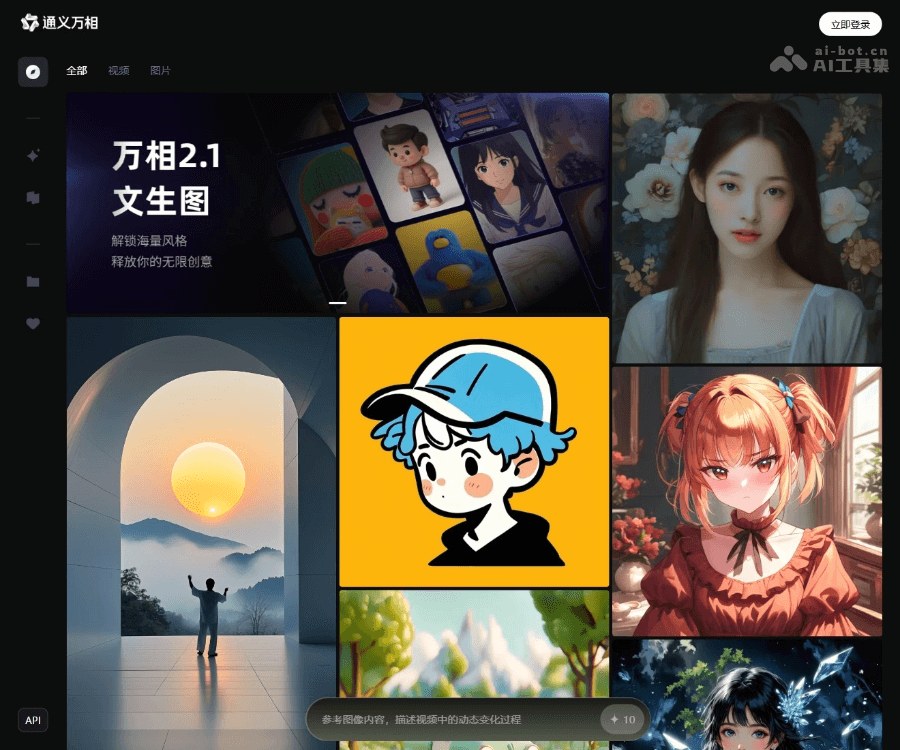

2. 万相视觉生成大模型:全模态创作引擎

万相是通义实验室推出的视觉与多模态生成大模型,采用原生多模态统一框架进行训练,具备图像、视频、声音等多模态生成与理解能力,在画面质量、语义理解、运动幅度、物理规律遵循与艺术质感等方面处于行业领先水平。

核心特性包括:

- 高质量图像生成:支持写实风格、插画风格、艺术风格等多种类型的图像创作,适用于电商设计、品牌海报、游戏美术、IP形象设计等场景。

- 视频生成与编辑:

- 视频角色参考生成:可基于参考人物形象生成风格统一的视频内容。

- 智能多镜头叙事:自动生成多镜头、多场景的视频片段,支持故事化表达。

- 视频换人与图生动作:支持在视频中替换人物形象,或根据静态图片生成动态动作视频。

- 自然音画同步:在视频生成中实现动作、表情与音频的自然同步,提升整体观感与沉浸感。

- 图文混排输出:支持图像与文字的混合排版生成,适用于营销物料、长图文内容、教育课件等。

通过万相,用户可以从简单的文字描述出发,快速生成符合需求的视觉与多媒体内容,大幅提升创作效率。

3. 多模态交互与行业场景解决方案

依托通义千问与万相,通义实验室提供面向多种终端与行业的多模态交互能力:

-

智能终端与物联网设备:

- 基于千问大模型与多模态交互套件,可为玩具、穿戴设备、陪伴机器人、智能家居等终端设备赋予听觉、视觉与语言综合理解能力。

- 支持语音对话、图像识别、情绪感知等功能,打造更自然、更拟人的交互体验。

-

社交与虚拟IP场景:

- 面向社交拟人交互,集成实时对话、文字翻译、物体识别等能力。

- 支持虚拟IP打造、虚拟主播、虚拟客服等形象的构建与运营,实现实时情感化对话与个性化互动。

-

智能出行与车载助手:

- 依托千问大模型,集成出行助手、智能规划、智能推荐、长期记忆等能力。

- 可为车载系统、出行应用提供路线规划、行程管理、语音助手、内容推荐等服务,打造安全、愉悦的智能出行体验。

-

企业与行业应用:

- 通过API与SDK,企业可将通义大模型能力嵌入客服、办公、营销、运营、制造、教育等业务系统中。

- 支持私有化部署与定制化微调,满足数据安全与行业知识注入需求。

通义实验室官网提供统一入口,用户可以在同一平台上了解全系列大模型产品、最新行业资讯与前沿应用案例,并快速体验与接入相关能力。

简单使用教程

以下为基于通义实验室官网的一般性使用流程示例,实际操作以官网最新界面与文档为准。

步骤一:访问官网与注册登录

- 打开浏览器,访问通义实验室官网:https://tongyi.aliyun.com。

- 点击页面中的“登录”或“免费体验”等入口,使用阿里云账号登录;如无账号,可按提示完成注册。

- 登录成功后,进入通义实验室主控制台或产品聚合页面。

步骤二:体验通义千问对话与文本能力

- 在首页或产品列表中找到“通义千问”或“大语言模型”入口。

- 进入在线体验界面,在对话输入框中输入你的问题或需求,例如:

- “帮我写一段新品发布会邀请函。”

- “解释一下多模态大模型的基本原理。”

- “生成一段Python代码,实现读取CSV并统计平均值。”

- 点击发送,等待模型返回结果。

- 可通过继续追问、补充条件等方式进行多轮对话,逐步优化输出内容。

步骤三:体验万相图像与视频生成

- 在通义实验室页面中找到“万相”或“视觉生成大模型”入口。

- 进入创作界面后,选择需要的创作类型,例如“图像生成”“视频生成”或“图文混排”。

- 在文本描述框中输入你的创作需求,例如:

- “日落海边的写实风格照片,用于旅游海报。”

- “一段30秒的科技感城市夜景短视频,多镜头切换。”

- 如界面支持,可上传参考图片或视频,启用“角色参考”“视频换人”等高级功能。

- 点击生成,等待系统完成渲染,并在结果中选择满意版本进行下载或再次调整。

步骤四:接入多模态交互与行业场景

- 在官网导航中查找“文档”“开发者中心”或“API/SDK”相关入口。

- 根据业务需求选择对应能力:

- 语言对话与知识问答:选择通义千问API。

- 图像/视频生成与编辑:选择万相相关API。

- 多模态交互套件:选择适配智能硬件、车载系统或App的解决方案。

- 按文档指引获取访问密钥(AK/SK)或调用凭证,并在你的应用或服务中配置。

- 使用示例代码或SDK进行首次调用测试,确认接口返回正常后,再集成到正式业务流程中。

步骤五:优化与安全合规配置

- 在控制台中查看调用日志与用量统计,评估模型效果与成本情况。

- 根据业务反馈,调整提示词(Prompt)、模型规格与温度等参数,以获得更符合场景的输出。

- 如涉及敏感数据或行业合规要求,可参考官网提供的安全合规指南,配置数据隔离、访问控制与内容审核策略。

- 持续关注通义实验室官网的“最新动态”或“行业资讯”,了解模型更新、能力升级与新场景案例,及时迭代你的应用方案。