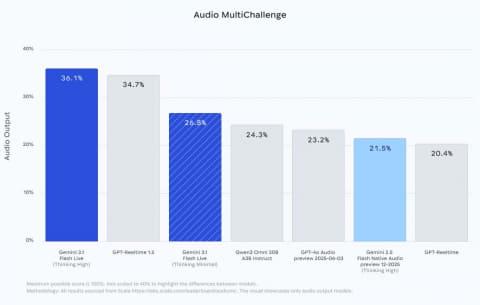

美国谷歌公司于26日(美国时间)发布了进一步提升实时对话体验的“Gemini 3.1 Flash Live”。该音频模型是迄今为止质量最高的,能够实现下一代“语音优先”AI所需的速度和自然节奏。借助Gemini 3.1 Flash Live,谷歌在日本推出了支持语音和摄像头的新搜索功能“搜索 Live(Search Live)”。

Gemini 3.1 Flash Live已作为预览版通过谷歌AI Studio中的Gemini Live API向开发者开放,企业用户可通过Gemini Enterprise for Customer Experience使用,普通用户则可通过搜索 Live和Gemini Live体验该功能。

该版本提升了构建语音优先代理的可靠性,增强了对音调的理解能力,相较于2.5 Flash Native Audio,更精准地识别音高和语速等声学细节。此外,它还能动态调整对用户烦躁或困惑情绪的响应。

在嘈杂环境下的任务处理能力也得到了加强。美国Verizon、LiveKit和The Home Depot等企业对3.1 Flash Live在其工作流程中的表现给予高度评价。

普通用户可通过Gemini Live和搜索 Live使用该技术,实现从日常简单问答到复杂对话的更自然、更有用的响应。

基于3.1 Flash Live模型的Gemini Live不仅响应速度更快,还能追踪两倍长度的对话内容,使得长时间的头脑风暴过程中思路得以连续保持。

搜索Live现已全球上线🌍

AI模式下的互动多模态对话现已覆盖200多个国家和地区。

此次更新由Gemini 3.1 Flash Live驱动,这是我们迄今为止最高质量的音频和语音模型。该模型还具备多语言能力。

—— 谷歌官方推特,2026年3月26日

搜索 Live在日本正式启动

随着3.1 Flash Live的发布,谷歌开始了“搜索 Live”的全球推广。用户可在200多个国家和地区使用自己偏好的语言进行搜索及实时多模态对话,日本也已正式支持该功能。

搜索 Live结合了语音和摄像头,支持用户通过谷歌搜索的“AI模式”进行互动式对话。

使用搜索 Live时,用户只需在谷歌应用中点击搜索栏下方的“直播”图标,语音提问后即可获得语音回答,随后还能继续追加问题或通过相关网页链接查看详细信息。

当用户想了解眼前物品时,例如想知道室内植物叶子发黄的原因,可以启用摄像头添加视觉信息。搜索功能会识别摄像头画面内容,并推荐更详细的网络资源链接。

此外,用户还可以在谷歌镜头中启用搜索 Live,或点击“文字转录”按钮查看文本形式的回答,也可以通过输入文字继续提问。

值得一提的是,3.1 Flash Live生成的语音中嵌入了SynthID水印,该水印直接融入音频输出,确保能够准确检测AI生成内容,有效防止错误信息的传播。