近日,AI领域发生了多起引人关注的事件。微软挖走了AI2的领导团队,OpenAI的Sora应用成为Side Quest大清洗中的首个牺牲品(可能还有Atlas),而LiteLLM则暴露出影响几乎所有Python AI项目的严重供应链安全漏洞。

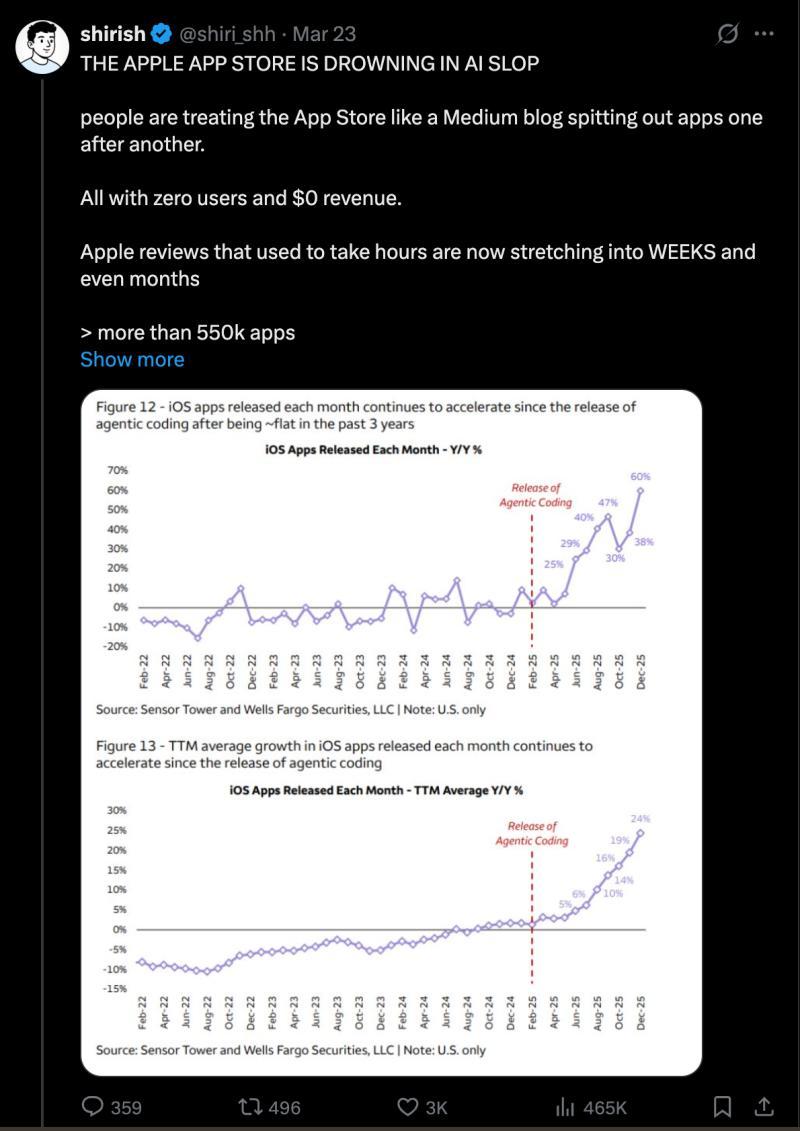

虽然这些事件会随着时间逐渐淡出视野,但它们反映出一个持续的趋势:无论是苹果这样的传统应用商店,还是Dreamer等AI原生应用商店,都面临着巨大的挑战。下图展示了这一趋势的核心问题:

尽管关于AI是否会取代所有SaaS的争论仍在继续,但越来越多有创业精神的人尝试通过编写vibecode应用并希望实现百万美元级别的退出。传统应用商店的审核流程正面临崩溃,尤其是在苹果开始以政策理由封禁如Replit和Vibecode等vibecode应用的背景下。2026年,传统软件分发模式明显失效,我们在年初就将“对低质应用的战争”定为关键主题,这张图表成为理解苹果App Store及类似平台与开放网络之间长期竞争格局的重要参考。

在AI推特社区,Anthropic发布了多代理框架的工程文章,强调代理能力更多依赖于协调机制而非单一模型。Figma推出了MCP服务器,实现了设计画布的直接AI编辑,GitHub和Cursor也相继支持了这一工作流,标志着工具调用正逐步成为产品原生功能。Nous发布了Hermes Agent v0.4.0,成为个人代理运行时的重要进展。AI2推出了MolmoWeb开源浏览器代理,GenReasoning发布了涵盖数百万强化学习任务的OpenReward平台,推动了开放代理生态系统的标准化。

在推理和系统优化方面,vLLM和Transformers团队都报告了显著的性能提升。Hugging Face推出了hf-mount,支持将Hub数据集和模型挂载为本地文件系统,极大便利了代理的内存和存储管理。Optimal Intellect发布了GPU原生求解器Moreau,谷歌研究团队推出了TurboQuant压缩算法,均体现出优化重心正从模型规模转向运行时和系统层面。

安全领域,LiteLLM PyPI版本遭遇供应链攻击,恶意代码试图窃取凭证并横向传播,凸显了代理软件的攻击面已扩展至整个文件系统。社区呼吁加强权限管理和依赖审计,避免过度依赖宽泛权限。

组织动态方面,微软继续吸纳AI2核心团队成员,强化其超级智能项目。OpenAI宣布未来一年将投入10亿美元用于基础设施建设,重点聚焦AI韧性,并传出新大型语言模型“Spud”已完成初步开发,Sora应用则逐步关闭,显示出OpenAI正收缩产品线,专注核心模型和基础设施。

在Reddit社区,关于本地LLM的安全问题、性能优化和模型评测讨论热烈。LM Studio被误报为恶意软件,LiteLLM安全事件引发广泛关注。Rust实现的Fox推理引擎展示了显著性能提升。Qwen3.5 27B模型的“通用语言”特性引发研究兴趣。FlashAttention-4在特定GPU上实现了极高的推理性能。SillyTavern扩展实现了游戏NPC的动态交互。中国LLM市场活跃,字节跳动、阿里巴巴、腾讯、百度等巨头纷纷推出多样化模型,开放权重模型发布速度快于美国,形成强劲竞争态势。

此外,AI社区对AGI的定义和实现存在争议,NVIDIA CEO黄仁勋声称AGI已实现引发讨论。Anthropic的Claude AI新增了电脑操作能力和“Auto Dream”记忆管理功能,提升了代理的实用性和智能水平。OpenAI的Sora应用宣布关闭,反映出AI应用产品化的挑战。

总体来看,2026年AI生态正经历深刻变革,传统应用商店和软件分发模式面临瓦解,安全风险和系统优化成为焦点,开源与商业力量的博弈日益激烈。苹果对低质应用的严厉打击,是这一大环境下的缩影,预示着未来软件生态将更加重视质量、安全与创新的平衡。