日本GMO互联网、NTT东日本、NTT西日本及QTnet联合完成了基于IOWN APN的东京至福冈远程分布式AI基础设施的技术验证。该平台在东京部署存储设备,在福冈配置GPU,实现了远程分布式环境下的实用AI开发能力。

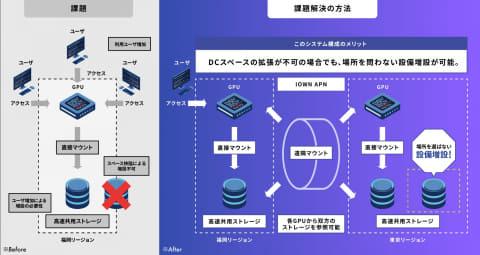

此次验证是在生成式AI和大型语言模型(LLM)需求急剧增长的背景下进行的,考虑到数据中心空间限制及企业对数据本地管理的需求,四家公司共同探讨了远程连接GPU与存储的技术可行性。

验证过程中,使用了GMO GPU云的GPU与大容量存储设备,评估了图像分类任务和大型语言模型处理任务的训练时间。所用模型包括图像识别模型“ResNet”和大型语言模型“Llama2 70B”。

技术环境方面,GMO互联网集团位于日本东京涩谷区的第二总部与QTnet位于日本福冈市的数据中心通过IOWN APN(100GbE)连接。GPU服务器“NVIDIA HGX H100”部署在福冈,存储设备“DDN AI400X2”部署在涩谷。

结果显示,大型语言模型训练中,本地环境耗时24.87分钟,远程环境耗时24.99分钟,性能下降仅约0.5%。图像分类任务中,本地环境耗时13.72分钟,远程环境耗时14.38分钟,表明即使涉及数据读取的处理,远程环境也能达到实用水平。

未来应用场景包括:在保持企业自主管理的大规模及机密数据的同时,利用远程云GPU进行AI训练;结合现有本地环境与云GPU的混合运维;通过地理分散计算资源和存储,实现灾害或故障时的业务连续性计划(BCP)。

四家公司计划推动IOWN APN的普及,并加强与云服务提供商及地方数据中心的合作,致力于将IOWN APN作为AI基础设施的核心骨干,实现社会层面的广泛应用。