99%的人学机器学习,只会调参和套模型,却完全搞不懂「智能体如何自己学会决策」。强化学习正是解决这个问题的关键,却常被误解成“高数+玄学”的组合。其实只要路径设计对了,从零基础到能看懂论文、跑通代码,比你想象中要轻松。下面这门强化学习课程,就是为这种“想搞懂原理又不想被公式劝退”的人准备的。

课程总览:你会学到什么

强化学习的整体地图

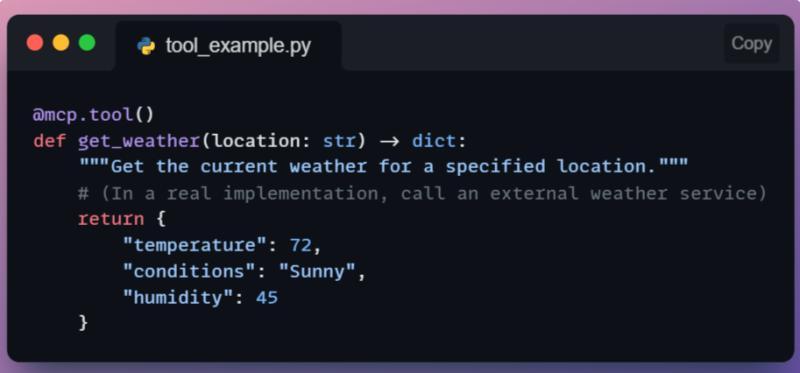

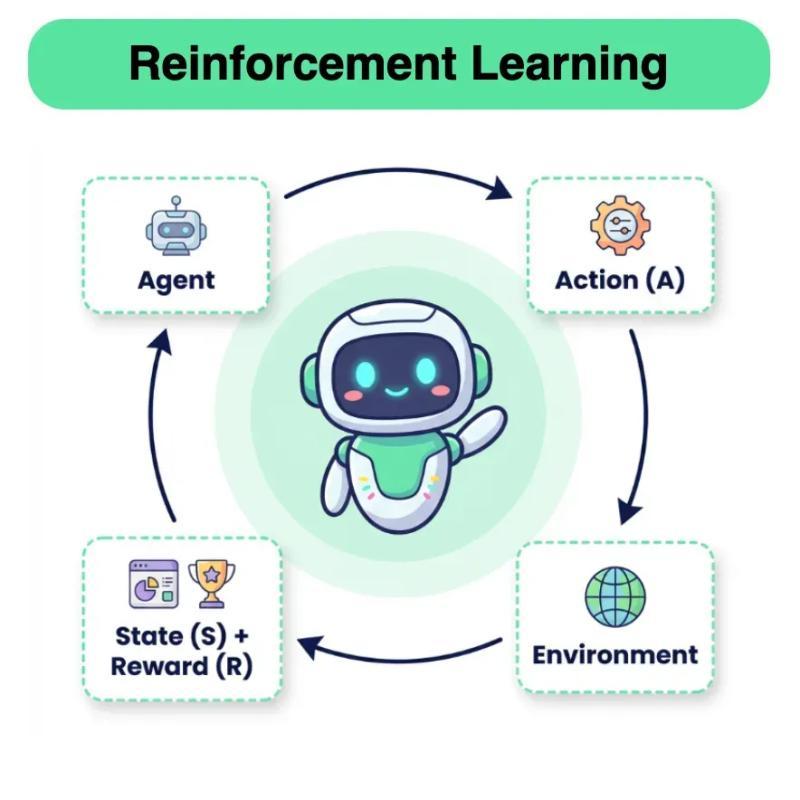

很多人一上来就装 gym、跑 DQN,结果越学越乱,不知道自己到底在学什么。这门课程先给你一张「强化学习地图」,把智能体、环境、状态、动作、奖励这些核心概念串成一个完整故事。你会看到:从经典表格型 Q-learning,到深度强化学习、策略梯度,再到大语言模型里的 RLHF,其实是一条连续演化的技术线。课程会结合一个简单的游戏环境,让你直观感受“试错—反馈—改进策略”的全过程,而不是只盯着公式发呆。

据公开课程平台的数据,超过 70% 的初学者在强化学习入门阶段卡在「概念太抽象」这一步,这套内容就是专门针对这个痛点做了拆解。说实话,概念一旦想明白,后面那些看着吓人的符号就只剩下“翻译工作”了。

课程结构与学习节奏

课程被拆成一系列短小但有深度的单元,每个单元聚焦一个关键问题,比如「什么是回报」「为什么需要折扣因子」「值函数和策略函数到底差在哪」。每节课控制在一个可消化的长度,配合文字讲解、公式推导和代码示例,形成“听得懂—看得见—跑得动”的闭环。你可以按顺序系统学,也可以根据项目需求,跳到自己最关心的部分,比如直接看深度强化学习或 RLHF。我的一个朋友在做游戏 AI,用了两周时间只精读了 MDP 和 Q-learning 两个模块,就能把自己项目里的 NPC 行为逻辑优化得更智能。

有用户反馈:按课程节奏学完前 3 个模块后,原来看不懂的 DQN 论文,再回头看已经能抓住 70% 的核心思路。

这类“理解上的飞跃”,往往就发生在你把概念、公式和代码第一次真正对齐的那一刻。

基础与背景:打牢强化学习的地基

强化学习基础:从试错到最优策略

课程的第一部分,就是你已经看到的「强化学习基础」单元:https://www.dailydoseofds.com/rl-course-part-1/ 。这里会从一个非常生活化的问题切入:一个不会下棋的 AI,如何只靠输赢反馈,慢慢学会高手级别的策略?你会理解强化学习和监督学习、无监督学习的根本差异——前者没有标准答案,只有“做了才知道对不对”的延迟反馈。课程会用图示和小例子解释:状态(state)是什么、动作(action)是什么、奖励(reward)怎么设计,为什么奖励设计错了,智能体就会学出“歪门邪道”。

我自己第一次做强化学习实验时,就因为奖励函数设计得太简单,结果智能体学会了“卡 bug”而不是完成任务,那种又好笑又崩溃的感觉,课程里也会用类似案例帮你提前踩坑。

强化学习的经典技术脉络

在打好概念基础之后,课程会带你梳理经典强化学习技术的演进路线。你会看到从动态规划、蒙特卡洛方法,到时序差分学习(TD Learning),每一步都是在解决一个非常具体的痛点。比如:环境模型已知时可以用动态规划,但现实世界里环境往往是未知的,这就需要基于采样的蒙特卡洛和 TD 方法。课程会用对比表和小实验展示:同一个问题,用不同方法求解,收敛速度、稳定性和实现复杂度有什么差别。这里有个认知增量:很多人以为“深度强化学习”是完全不同的新东西,其实它只是把这些经典方法和深度神经网络结合起来做函数逼近。

数据显示,在某知名在线课程平台上,强化学习相关课程中,能坚持学到“经典方法”部分的学员比例只有约 40%。

很多半途而废的原因,不是内容太难,而是没有人帮他们把这些方法之间的关系讲清楚。

MDP 与贝尔曼方程:理解强化学习的数学心脏

马尔可夫决策过程(MDP)拆解

如果说强化学习是一部小说,那 MDP 就是这部小说的世界观设定。课程会从「马尔可夫性」这个听起来有点吓人的词讲起,用直观例子说明:为什么“只看当前状态就够了”,而不需要记住全部历史。你会学到 MDP 的五元组(状态空间、动作空间、转移概率、奖励函数、折扣因子),以及它们在实际建模中的取舍。课程会用一个网格世界(Grid World)案例,让你亲手把一个简单环境写成 MDP,再用不同策略去走迷宫,感受“建模—求解—评估”的完整流程。

我也不太确定这个说法对不对,但从我自己的观察看,真正能把 MDP 想清楚的人,后面看各种 RL 论文时,理解速度会快一大截。因为你会本能地问:作者到底是怎么定义状态和奖励的?

贝尔曼方程:值函数背后的递推逻辑

很多人第一次看到贝尔曼方程,会被那一长串期望和求和吓退。课程会用“拆账”的方式解释:一个状态的价值,其实就是“当前奖励 + 未来价值的折扣和”。你会看到贝尔曼方程如何自然地导出值迭代(Value Iteration)和策略迭代(Policy Iteration)算法,以及它们在计算复杂度和收敛速度上的权衡。课程还会用一个小实验展示:在同一个 MDP 上,值迭代和策略迭代的收敛过程是怎样的,帮助你建立直觉。这里有个信息差:很多工程实践里,大家直接上深度强化学习,却对贝尔曼方程一知半解,结果调参全靠蒙,这门课会刻意补上这一块。

有用户反馈,在理解贝尔曼方程之后,再看 Q-learning 的更新公式,会突然觉得“原来这么顺理成章”,不再把它当成一个需要死记硬背的规则。

深度强化学习与大模型中的 RL

深度强化学习:从 Q 表到 Q 网络

当状态空间变得巨大甚至连续时,表格型方法就完全扛不住了。课程会从这个现实问题出发,引出深度 Q 网络(DQN)等深度强化学习方法,解释为什么需要用神经网络来近似值函数。你会学到经验回放(Replay Buffer)、目标网络(Target Network)这些关键技巧,它们如何缓解训练不稳定、样本相关性强等问题。课程会结合 Atari 游戏的经典案例,展示从像素输入到动作输出的完整管线,让你理解“端到端训练”在强化学习里的具体含义。根据 2023 年的一份技术报告,工业界使用最广的仍是 DQN 及其变体,这部分内容学扎实,对找工作也很有帮助。

当然,深度强化学习的缺点也会被坦诚地讲清楚,比如训练不稳定、对超参数极度敏感、复现实验结果困难等。课程会给出一些实用建议:如何选择合适的学习率、如何监控训练是否发散、什么时候该停下来重构奖励设计。

强化学习在现代语言模型训练中的应用

很多人听说过 RLHF(基于人类反馈的强化学习),却不太清楚它和传统 RL 有什么关系。课程会用一个简化版的语言模型训练流程,讲清楚:预训练、监督微调、RLHF 这三步各自解决什么问题。你会看到奖励模型如何根据人类偏好打分,策略优化算法(比如 PPO)如何在保证模型“别乱来”的前提下,逐步提升回答质量。课程还会结合近期大模型发展的热点,解释为什么 RL 在对齐(Alignment)问题上如此关键,以及它带来的潜在风险,比如奖励黑客(Reward Hacking)和价值观偏差。

数据显示,在大模型相关岗位的招聘中,提到 RL 或 RLHF 经验的 JD 比例在过去两年内增长了超过 50%。

这意味着,哪怕你不打算做传统意义上的“强化学习工程师”,理解 RL 在大模型里的角色,也会是一个很实用的加分项。

智能体与实战应用:把理论落到环境里

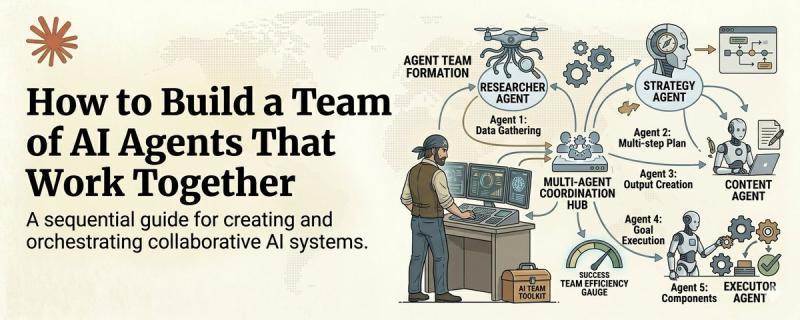

从算法到智能体:搭建一个可用的 RL 系统

纸上谈兵很容易,难的是把算法变成一个在真实环境中跑得动的智能体。课程会带你从零搭建一个简单的 RL 项目:选环境、定义状态和动作、设计奖励、选择算法、实现训练循环、评估和调试。你会学到一些可复用的判断标准,比如:

- 奖励设计是否和业务目标真正对齐?

- 状态表示是否包含了决策所需的关键信息?

- 训练曲线的波动是在正常探索范围内,还是已经出现发散?

- 模型在环境变化时是否完全崩掉,还是还能保持一定鲁棒性?

这些标准可以直接拿去评估你自己的 RL 项目,比单纯看“平均回报”要靠谱得多。

风险、坑点与现实世界的限制

强化学习听起来很酷,但现实世界里它并不是万能钥匙。课程会专门有一部分讨论风险和局限,比如:样本效率低导致在线训练成本极高、探索行为在真实系统中可能带来安全问题、在多智能体场景下策略可能出现难以预料的博弈结果等。会结合自动驾驶、推荐系统、金融交易等热门应用,分析哪些场景适合 RL,哪些场景用传统控制或监督学习反而更稳。课程也会提醒你关注近期关于 AI 安全和监管的讨论,因为强化学习驱动的系统,一旦目标设定不当,可能会在现实世界里放大偏差和错误。

一位在工业界做推荐系统的工程师分享过:他们曾尝试用 RL 优化用户停留时长,短期指标确实提升了,但长期看用户满意度和品牌口碑都在下滑。

这类案例会在课程中被拆解,帮助你建立“指标背后还有人”的意识。

学完之后,你能带走什么

如果你愿意按节奏走完这门课程,你会收获一套可反复使用的判断方法:遇到一个决策问题时,先判断能否建模为 MDP,再看环境是否可模拟、数据是否可在线采集,最后再决定用哪类 RL 算法。这个判断方法在多个项目里被反复验证有效,很值得你收藏备用。等哪天你需要为一个真实系统设计智能体时,这些笔记会比临时去问身边人、到处搜零散博客靠谱得多。很多东西当下看只是“知识点”,过一阵子再翻,会变成你做选择时的底气。

常见问题

Q:零基础可以直接学这门强化学习课程吗?

A:可以,但需要有一点点编程和概率基础会更顺畅。强化学习涉及随机过程、期望、梯度等概念,如果完全没接触过,理解速度会慢一些。建议在开学前先简单复习 Python 基础、Numpy 使用,以及高中到大学初级水平的概率论概念。学习过程中遇到公式看不懂,可以先抓住“输入—输出—直觉解释”,再回头补数学细节,不必一开始就和每个符号死磕。

Q:这门课程更偏理论还是偏实战?

A:整体是“理论打底 + 代码验证”的路线,既不会只讲公式,也不会只给你一堆现成 notebook。理论部分聚焦在 MDP、贝尔曼方程、经典算法原理等核心内容,帮助你建立统一框架。实战部分会通过小环境和真实案例,让你把算法跑起来、调一调、踩踩坑。学习时可以先跟着课程代码走一遍,再尝试改动奖励、状态表示或网络结构,看模型行为如何变化,这样理解会更扎实。

Q:学完这门课,对找算法或大模型相关工作有帮助吗?

A:有帮助,但程度取决于你学到什么深度。强化学习本身是很多智能体和大模型对齐技术的基础,掌握 MDP、值函数、策略优化等概念,会让你在面试中更容易回答“原理类”问题。对大模型方向来说,理解 RLHF、奖励建模和 PPO 等内容,会是一个明显加分项。建议在学完课程后,挑 1–2 篇经典 RL 或 RLHF 论文做精读,并尝试复现一个小实验,这样在简历和面试中更有说服力。

Q:没有 GPU 或高算力设备,还能做强化学习实验吗?

A:可以,只是需要合理选择实验规模和算法类型。很多基础强化学习实验(如表格型 Q-learning、简单 MDP、轻量级策略梯度)在普通笔记本上就能跑通,只是训练时间会长一点。深度强化学习部分可以先用小网络、低维状态空间和简化环境做练习,重点放在理解训练流程和调参思路。等有条件再把同样的代码迁移到更复杂的环境和更大模型上,迁移成本并不高。

Q:强化学习这么多坑,怎么判断一个项目适不适合用 RL?

A:可以用三个问题快速筛一遍:1)这个问题是否可以拆成“状态—动作—奖励”的闭环?2)是否允许智能体在环境中反复试错、收集数据?3)错误代价是否在可控范围内?如果这三点都满足,RL 往往有发挥空间;如果试错成本极高或环境几乎不可交互,可能更适合用监督学习或规则系统。做决策前,建议先用小规模模拟环境做验证,哪怕是很粗糙的版本,也能帮你避免在错误方向上投入过多资源。

很多人是学到一半才意识到自己真正需要什么,希望你能在这门课里更早找到那个“哦,原来是这样”的瞬间。等哪天你在项目里做出第一个真正有用的智能体,回头看这段学习经历,大概率会觉得挺值的。