在 LM Studio 本地运行 DeepSeek 模型的流程其实很简单:先下载或导入兼容的 DeepSeek 模型,再在 LM Studio 应用中加载即可。加载完成后,你就可以完全离线与 DeepSeek 对话,甚至通过本地 API 把它当作“自建 ChatGPT 服务”使用。

本文是一个独立、非官方的 DeepSeek + LM Studio 使用参考,重点讲解:

- 如何选择合适的 DeepSeek 模型

- 在 LM Studio 中下载或导入模型的两种路径

- 推荐的一套“基础参数配置”

- 遇到“太慢 / 不稳定 / 占内存 / 输出怪异”等情况时如何调参

- 如何把 DeepSeek 作为本地 API 服务器使用

- 本地服务器的安全与隐私注意事项

- 常见问题排查思路

不同硬件、不同 DeepSeek 变体的最佳设置会有差异,文中的参数可以视作“起步参考”,再根据自己机器和任务慢慢微调。

提示: DeepSeek 是“推理型”模型,很多 R1 风格的模型会在正式回答前输出类似 ... 的推理过程。这是正常现象。如果你只关心最终答案,可以直接忽略 `` 部分。

一、在 LM Studio 中选择合适的 DeepSeek 模型

1. DeepSeek R1 与蒸馏模型概览

DeepSeek 提供了一系列开放权重的推理模型,其中原始的 DeepSeek-R1 是一个总参数量约 671B、每次前向激活约 37B 参数的大型推理模型。它主要面向服务器级算力,不适合普通个人电脑本地部署。

本地使用时,大多数人会选择 DeepSeek-R1 的蒸馏模型,即把大模型的推理能力“压缩”到更小的架构中。官方蒸馏家族目前包括:

- 1.5B

- 7B

- 8B

- 14B

- 32B

- 70B

这些蒸馏版本在保留主要推理风格的同时,大幅降低了本地部署的算力和内存门槛。

一般建议:

- 普通本地用户:优先从 7B 或 8B 蒸馏模型开始

- 有较大显存 / 内存:再考虑 14B、32B 甚至 70B

- 原始 671B R1:需要服务器级多卡环境,不适合作为个人本地模型

2. 量化模型 vs 全精度模型

很多 DeepSeek 模型都提供了 量化版本(如 4-bit、8-bit 整数),可以在略微牺牲精度的前提下,大幅降低显存 / 内存占用。LM Studio Hub 和社区通常会提供现成的 GGUF 量化文件(如 4-bit GGUF)。

选择建议:

- 机器内存 / 显存紧张:优先选 4-bit 或 8-bit 量化版本

- 想跑更大的模型:用量化版往往比小号全精度更划算

- 不建议极端量化(如 3-bit),容易明显拉低回答质量

3. 安全下载与来源校验

下载 DeepSeek 模型时,务必从 官方或可信来源 获取,并尽量校验文件完整性:

- 官方 Hugging Face 组织:

deepseek-ai - LM Studio 内置模型目录或社区列表

常见官方命名示例:

DeepSeek-R1-Distill-Llama-8BDeepSeek-R1-0528-Qwen3-8B

下载前后可以:

- 核对模型名称与发布账号是否为

deepseek-ai或其他可信组织 - 如提供校验和 / hash,下载后对比确认

- 阅读模型卡与评论,留意是否有异常警告

二、把 DeepSeek 加入 LM Studio 的两条路径

选好模型后,在 LM Studio 中有两种常见接入方式:

路径 A:通过 LM Studio 模型目录直接下载(推荐给新手)

- 打开 LM Studio,进入 Discover(发现)标签页。

- 在搜索框输入

DeepSeek。 - 在列表中找到合适的 DeepSeek 模型(如 7B、8B、14B 等蒸馏版本)。

- 确认发布者为官方或可信账号(如

deepseek-ai),再点击 Download。 - 下载完成后,模型会出现在 My Models 中,点击 Load 即可在聊天界面使用。

优点:

- LM Studio 会自动配置模型元数据与提示模板

- 不用自己管理目录结构

路径 B:从本地文件手动导入

如果你已经从 Hugging Face 等渠道下载了 GGUF 等格式的 DeepSeek 模型,可以手动导入。

方式 1:使用 LM Studio CLI 导入(更简单)

lms import /path/to/your/model.gguf

该命令会将模型复制 / 移动到 LM Studio 的内部模型目录(通常类似:

~/.lmstudio/models///)。导入完成后重启或刷新 LM Studio,即可在 My Models 中看到并加载。

方式 2:手动放置文件

- 在 LM Studio 模型目录下创建与“发布者 / 模型名”一致的文件夹结构,例如:

deepseek-ai/DeepSeek-R1-0528-Qwen3-8B/ - 将模型文件放入该目录,如:

DeepSeek-R1-0528-Qwen3-8B.gguf - 重启 LM Studio,若结构正确会自动识别。

手动导入检查清单:

- 目录名与模型名尽量保持与官方一致

- 优先使用 GGUF 格式,兼容性最好

- 确认文件完整未损坏

- 若识别失败,检查 LM Studio 版本是否支持该格式

小提示:

首次加载 DeepSeek 后,可以先发一个简单问题测试是否正常工作。第一次响应略慢属正常,因为模型需要“预热”。看到 ... 再跟随正式回答,也是部分推理模型的正常表现。

三、DeepSeek 在 LM Studio 的推荐基础参数

DeepSeek 属于“先思考再回答”的推理模型,参数设置会明显影响推理质量与速度。下面是一套通用的基础配置思路,你可以在模型设置(齿轮图标)中调整,也可以在对话时临时修改。

1. 上下文窗口(Context Window / Max Context Length)

不同 DeepSeek 检查点支持的最大上下文长度不同,本地可用长度还取决于:

- 模型本身的最大 context

- 运行时与量化方式

- 你的 RAM / VRAM

建议:

- 不要盲目把所有模型都拉到 128K 上下文

- 任务只需要短对话时,用尽量小的上下文,如 4k–8k token

- 上下文越大:

- 每个 token 计算越慢

- 占用内存越多

什么时候调大?

- 需要喂入长文档或超长对话时,可以接近模型最大值

- 但要意识到性能会明显下降

什么时候调小?

- 机器内存吃紧、只做短问答时

- 比如设成 1024 token,用于快速单轮问答,能节省不少资源

原则:能满足任务的最小上下文,就是最优上下文。

2. 最大输出长度(Max Output Tokens / Max New Tokens)

该参数控制模型最多能生成多少 token。对 DeepSeek 来说,需要同时容纳:

- `` 推理过程

- 最终回答

建议:

- 起步可以给一个相对宽松的上限,避免推理中途被截断

- 复杂问题的 `` 可能就要几十到几百 token

什么时候调大?

- 经常出现回答被截断的情况

- 复杂推理、长解释类任务(可拉到 1024 或更高)

什么时候调小?

- 模型容易“话多”“跑题”时

- 希望多轮对话中每轮回答更精简

3. 温度与采样参数(Temperature / Top-p / Top-k)

温度控制输出的随机性:

- 高温度(如 1.0):更发散、更有创意,但推理稳定性下降

- 低温度(如 0.2–0.4):更确定、更可复现,适合代码、数学、严谨分析

对本地运行的 DeepSeek R1 风格推理模型,常见的起步配置:

- Temperature:≈ 0.6

- Top-p:≈ 0.9–0.95

- Top-k:≈ 40–50

这是一套社区验证过的“好用默认值”,不是官方标准。

什么时候调低温度 / Top-p?

- 回答风格不稳定、同一问题多次回答差异很大

- 推理过程啰嗦、东拉西扯

什么时候调高温度?

- 需要头脑风暴、创意写作、开放式探索

调整建议:

- 每次只小幅调整(如温度改 0.1–0.2)

- 观察 `` 风格与最终答案的变化

目标是:既能清晰逐步推理,又不过度重复或胡言乱语。

4. 重复惩罚 / 频率惩罚 / 存在惩罚

这些参数用于抑制模型重复同样的句子或短语。DeepSeek 的链式推理有时会在 `` 里“打转”,不断重复类似思路。

建议:

- 开启轻微的重复惩罚(Repeat Penalty)

- 如有 presence / frequency penalty,也可设置为小值

什么时候调高?

- `` 中反复重复同一句话或同一段推理

- 回答中明显出现“复读机”现象

注意:

- 惩罚过高(如 >1.5)可能导致语言变得生硬、突然换话题

- 若发现输出变得过于简短或不愿重申关键点,可适当调回

5. System Prompt 与指令格式

在 LM Studio 中,对话通常由:

- System 消息(可选,全局角色与风格说明)

- User / Assistant 消息

LM Studio 会自动为每个模型应用合适的 提示模板(prompt template),你一般不需要手动加 User: / Assistant: 之类标签。

基础用法:

- System 可以留空,或简单写:

You are a helpful assistant. - DeepSeek 仍会按自己的推理风格输出 `` + 答案

什么时候自定义 System Prompt?

- 想控制语气、角色或输出风格时,例如:

You are an expert AI tutor. Explain answers clearly and step by step.

- 需要指定“简洁回答”“偏重代码”“偏重教学”等风格

注意:

- 不要用 System Prompt 强行“禁止思考”或完全压制 ``,容易与模型训练目标冲突

- 如果只想缩短推理过程,可以写:

- “Keep the `` section concise.”

6. 流式输出(Streaming)

LM Studio 支持 逐 token 流式输出,非常适合 DeepSeek:

- 可以实时看到 `` 推理过程

- 不必等整段回答生成完才看到内容

建议:

- 默认保持开启

什么时候关?

- 不想看到推理过程,只想一次性看到最终答案

关闭后:

- LM Studio 会在后台生成完整回答,再一次性展示

- 你无法中途打断或观察推理是否跑偏

7. GPU / CPU 加速与分层加载

DeepSeek 可以纯 CPU 跑,但有 GPU 的话强烈建议利用:

- 在模型设置中,通常可以设置:

- GPU Layers / GPU Memory Fraction

- 是否启用 Flash Attention 等加速

基础策略:

- 尽量让模型尽可能多地驻留在 GPU 中

- 例如:6GB 显存 + 8B 量化模型,通常可全模型上 GPU

遇到显存不足(OOM)时:

- 减少 GPU 层数,让部分层回落到 CPU

- 或改用更小 / 更高量化的模型

一般来说:

- 一个完全装得下 GPU 的 4-bit 模型,往往比

- 一个大一号但大部分在 CPU 的模型

体验更好。

CPU-only 用户:

- 确保 LM Studio 使用了所有 CPU 线程

- 优先选择 4-bit 等量化小模型

四、DeepSeek:稳定性 vs 速度 调参手册(按症状排查)

下面按“症状 → 调整建议”的方式,给出一份实用调参速查表。

症状 1:生成速度太慢

可能表现:每个回答都要等很久,甚至一两分钟。

可以尝试:

-

换更小或更高量化的模型

- 14B 在纯 CPU 上往往会非常慢

- 换成 7B / 8B 4-bit 量化,速度会明显提升

-

确认 GPU 是否在工作

- 在 LM Studio 设置中增加 GPU 层数

- 确保没有误选 CPU 后端

-

降低上下文长度

- 不要把 max context 拉到 64k、100k 这种极值

- 一般问答 4k–8k 足够

-

开启可用的加速选项

- 如 Flash Attention、speculative decoding 等(若 LM Studio 与模型支持)

-

接受一定的“思考时间”

- DeepSeek 的链式推理本身就比“直接给答案”的模型慢

- 如果只是 `` 较长但仍在合理范围,可以视为推理换来的质量

症状 2:模型重复、卡在循环里

表现:

- `` 中不断重复同样的句子 / 思路

- 回答中一遍遍重述同一结论

调整:

-

提高重复惩罚

- 例如从 1.1 调到 1.2–1.3

-

略微降低温度

- 如从 0.6 降到 0.4–0.5

-

缩短或重置上下文

- 长对话中,模型可能不断引用之前的 ``

- 可以:

- 使用 LM Studio 的滚动窗口 / 截断策略

- 手动删掉早期对话

-

在提示中明确要求“不要重复”(次要手段)

-

尝试更大一点的模型变体

- 某些小模型更容易陷入循环

- 8B 通常比 7B 稳定一些

症状 3:回答质量忽高忽低、不稳定

表现:同一问题多次提问,推理路径和结论差异很大。

调整:

-

降低随机性

- 降低 Temperature / Top-p

- 如温度从 0.8 降到 0.5

-

保持提示结构稳定

- 尽量用相似的提问方式

- 复制曾经得到好答案的提问格式

-

在 System 或 User 中鼓励“认真逐步思考”

- 如:“请仔细、逐步推理后再给出结论。”

-

尝试更大模型

- 14B / 32B 通常在逻辑稳定性上优于 7B / 8B

-

无关问题新开会话

- 避免旧对话上下文干扰新问题

症状 4:内存不足 / 程序崩溃

表现:

- 加载模型时报错或 LM Studio 直接退出

- 生成过程中系统卡死

调整:

-

换更小或更高量化的模型

-

降低上下文长度

-

启用 JIT 加载与自动卸载(auto-evict)

- 只在需要时加载模型,用完自动卸载

-

关闭其他占内存 / 显存的大型程序

-

GPU OOM 时,把更多层放回 CPU

-

升级 LM Studio 或模型版本

- 新版本通常会改进内存管理与兼容性

症状 5:输出乱码或完全不通顺

可能原因:

- 模型文件损坏

- 模型与 tokenizer / 提示模板不匹配

排查:

-

重新下载模型并校验文件

-

确认使用了正确的提示模板

- 最简单的方式:直接通过 LM Studio 模型目录重新下载

-

关闭不兼容的工具 / 插件集成

-

尝试更高精度量化(如从 4-bit 换 8-bit)

症状 6:本地 API 服务器不响应 / 连接失败

排查步骤:

- 确认服务器已启动

- 在 Developer 标签页打开“Start server”

- 或命令行运行:

lms server start

-

确认访问地址与端口正确

- 默认:

http://localhost:1234 - 若改过端口,要同步修改客户端配置

- 局域网访问需启用“Serve on Local Network”,并使用主机局域网 IP

- 默认:

-

检查是否启用鉴权

- 若开启了“Require Authentication”,每个请求都要带:

Authorization: Bearer

- 若开启了“Require Authentication”,每个请求都要带:

-

检查防火墙 / 网络策略

-

确认模型已加载

- 未加载模型时,部分接口会报错或无响应

- 可通过 UI 手动 Load,或使用

/api/v1/models/load接口

-

查看 LM Studio 日志

- 命令行运行:

lms log stream - 观察是否有“模型名不识别 / JSON 格式错误”等提示

- 命令行运行:

症状 7:调了一堆参数后,模型行为变得很奇怪

表现:

- 不再输出 ``

- 回答质量明显下降

处理:

- 恢复到一套“基础参数”

- 卸载并重新加载模型

- 一次只改一个参数,逐步观察

- 必要时查阅社区经验或官方文档

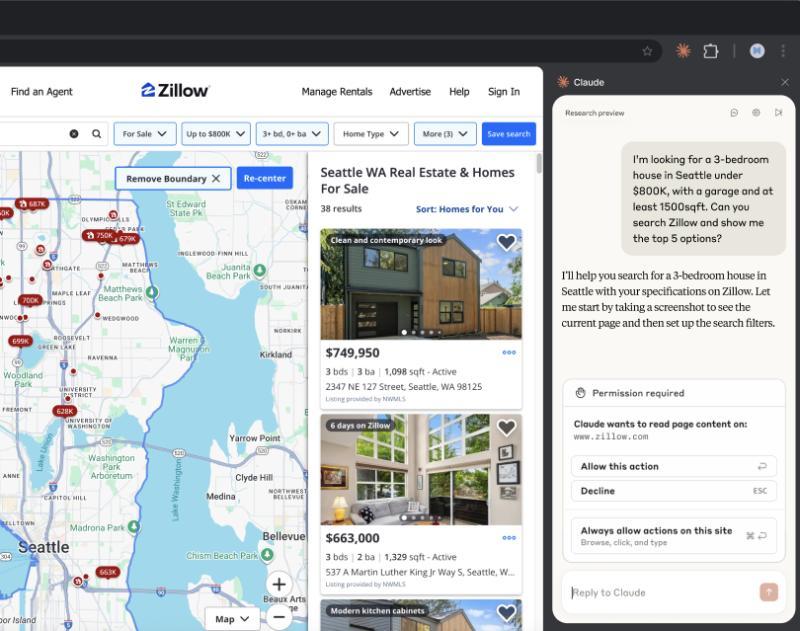

五、在 LM Studio 中把 DeepSeek 跑成本地服务器(本地 API)

LM Studio 的一大亮点是可以把本地模型“变成一个 API 服务”,让其他应用像调用 OpenAI 一样调用你的本地 DeepSeek。

1. 启动本地服务器

图形界面方式:

- 打开 LM Studio,进入 Developer 标签页(如未显示,可在设置中开启 Developer Mode)。

- 点击 / 切换 Start server 开关。

- 默认会在

localhost:1234启动服务器,UI 中会显示类似:Server running at http://127.0.0.1:1234

命令行方式:

lms server start

停止服务器:

lms server stop

2. 服务器配置要点

在 Developer → Server Settings 中,你可以:

- 修改端口(避免与其他服务冲突)

- 开启 / 关闭 Require Authentication(是否需要 token)

- 是否 Serve on Local Network(允许局域网其他设备访问)

- 是否开启 MCP / CORS 等高级选项

默认只监听 localhost,这是最安全的配置。

3. 两类主要 API 接口

LM Studio 提供两套 API:

- 原生 REST API:

/api/v1/...- 支持模型加载 / 卸载、下载状态、状态会话等

- OpenAI 兼容 API:

/v1/...- 兼容 OpenAI 的

chat/completions、responses等 - 方便直接复用 OpenAI 官方或第三方 SDK

- 兼容 OpenAI 的

4. 使用 OpenAI 兼容接口的示例

cURL 示例:/v1/chat/completions

curl http://localhost:1234/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "deepseek/deepseek-r1-0528-qwen3-8b",

"messages": [

{"role": "user", "content": "What is the capital of France?"}

]

}'

关键字段:

model:LM Studio 中识别的模型 ID- 可通过 UI 的 My Models 或

GET /v1/models查看

- 可通过 UI 的 My Models 或

messages:与 OpenAI Chat API 相同的消息数组

返回示例(结构类似 OpenAI):

{

"id": "chatcmpl-...",

"object": "chat.completion",

"created": 1695761234,

"model": "deepseek/deepseek-r1-0528-qwen3-8b",

"choices": [

{

"index": 0,

"message": {

"role": "assistant",

"content": "...\nThe capital of France is Paris."

},

"finish_reason": "stop"

}

]

}

若开启了鉴权,需要在 cURL 中额外加:

-H "Authorization: Bearer YOUR_TOKEN"

Python 示例:使用 OpenAI 官方 SDK

from openai import OpenAI

client = OpenAI(

base_url="http://localhost:1234/v1",

api_key="lm-studio", # 若启用鉴权,替换为真实 token

)

completion = client.chat.completions.create(

model="deepseek/deepseek-r1-0528-qwen3-8b",

messages=[

{"role": "user", "content": "Hello, DeepSeek! How can I run you locally?"}

],

temperature=0.6,

)

print(completion.choices[0].message.content)

要点:

base_url指向本地 LM Studio 服务器的/v1api_key只是占位符,除非你开启了鉴权model名称需与 LM Studio 中一致

5. 其他集成注意事项

- 多客户端并发:可以同时有多个应用访问本地 DeepSeek,但总算力有限,并发多时速度会下降

- 有状态 vs 无状态:

/api/v1/chat支持服务端维护会话/v1/chat/completions需要客户端自己维护消息历史

- 其他端点:如

/v1/completions、/v1/embeddings等,具体以 LM Studio 文档为准

通过本地服务器,你就相当于在自己机器上搭建了一个“私有 ChatGPT”,可以接入各种工具、IDE、自动化脚本,而数据始终留在本地。

六、本地服务器的安全与隐私(DeepSeek 相关要点)

在本地跑 DeepSeek 的最大优势之一是:数据不出本机。但一旦开启服务器,就要考虑安全与隐私。

1. Localhost vs 局域网暴露

- 默认只监听

localhost:- 只有本机程序能访问

- 安全性最高,推荐默认保持

- 启用“Serve on Local Network”后:

- 局域网内其他设备也能访问

- 适合在家中多设备共享,但需确保:

- 路由器密码安全

- 不在公共 Wi-Fi 环境下开启

强烈不建议:直接把 LM Studio 端口映射到公网。

2. 对外开放时务必启用鉴权

如果你确实需要局域网甚至远程访问:

- 在 Server Settings 中开启 Require Authentication

- 生成 API Token

- 所有客户端请求都必须带:

Authorization: Bearer

如需更高安全性,可考虑:

- 在本地再加一层 Nginx / Caddy 反向代理

- 使用 HTTPS 与额外认证

3. 本地数据足迹

虽然不会上传到云端,但本地仍会留下数据痕迹:

- 聊天记录:

- LM Studio 可能会在本地保存会话历史

- 可在配置目录(如

~/.lmstudio)中查找并手动清理

- 日志:

- 使用

lms log stream或开启调试时,部分对话可能写入日志

- 使用

- 模型缓存:

- 仅包含权重与编译缓存,不含你的对话

如果你处理的是高度敏感数据:

- 使用系统级磁盘加密

- 定期清理 LM Studio 的聊天与日志文件

- 在多用户系统上使用独立 OS 账户

4. 完全离线运行

模型文件下载完成后:

- DeepSeek 推理完全可以在 断网状态 下运行

- LM Studio 只在:

- 下载模型

- 检查更新

- 使用在线功能 时需要联网

你可以:

- 启用 LM Studio 的 Offline Mode

- 或直接物理断网,确保所有数据只在本机流转

5. 远程访问的“硬化”建议

若确实需要从外网访问家里的 DeepSeek:

- 优先使用 VPN(如 WireGuard / OpenVPN)

- 或使用 SSH 隧道做临时端口转发

- 避免直接把 1234 端口暴露在公网

同时:

- 监控 LM Studio 日志,留意异常请求

- 一旦发现可疑访问,立即关闭服务器或禁用网络暴露

总之:默认本地使用是非常安全的;只要不主动把端口暴露出去,你的数据基本不会离开电脑。

七、常见问题排查:DeepSeek + LM Studio

问题 1:模型加载失败 / 一直卡在加载

排查步骤:

-

检查 LM Studio 版本

- 确保使用最新版本,以支持最新 GGUF / 量化格式

-

检查内存 / 显存占用

- 打开任务管理器 / 系统监视器

- 点击 Load 时若内存瞬间拉满再掉,通常是 OOM

- 换更小或更高量化模型,或关闭其他程序

-

确认文件格式正确

- LM Studio 主要支持 GGUF / GGML / MLX 等

- 若误下了 PyTorch

.bin/safetensors,需要转换或重新下载 GGUF

-

检查目录结构

- 手动导入时,目录名需与模型名匹配

-

查看错误日志

lms log stream,再尝试加载

-

直接通过 LM Studio 模型目录重新下载

问题 2:生成速度极慢

除前文“症状 1”外,还可检查:

- GPU 是否因显存不足而完全未被使用

- CPU 是否因节能模式被严重降频

- 是否一次性塞入了超长文本(几十万 token)

问题 3:DeepSeek 理解不了指令 / 回答偏题

可能原因与解决:

-

提示格式问题

- 自己调用 API 时,确保

role正确(system / user / assistant)

- 自己调用 API 时,确保

-

System Prompt 冲突

- 过于强硬的系统指令可能与用户问题矛盾

- 先清空 System Prompt 再试

-

模型本身能力限制

- 小模型在复杂逻辑 / 冷门知识上会犯错

- 重要问题可换更大模型或交叉验证

-

适度微调参数

- 提高系统指令权重(若 UI 支持)

- 用 System Prompt 明确“简洁 / 详细 / 步骤化”等要求

问题 4:集成第三方工具时 API 调用总失败

排查:

-

确认客户端支持自定义 API Base

-

HTTP vs HTTPS

- 很多工具默认只接受 HTTPS

- 需要在配置中显式允许

http://localhost:1234

-

超时设置

- 若启用 JIT 加载,大模型首次加载时间较长

- 适当调大客户端超时时间

-

对照 LM Studio 文档检查请求格式

- 特别是 JSON 字段名、模型 ID 是否正确

八、总结

在 LM Studio 中本地部署 DeepSeek,可以让你在自己的电脑上拥有一套强大的推理型 AI:

- 不依赖云端,数据完全留在本地

- 可按硬件条件自由选择模型大小与量化方式

- 通过参数调优,在“速度 / 稳定性 / 细致推理”之间找到平衡

- 通过本地服务器,把它无缝接入各种工具与工作流

建议的实践路径:

- 从 7B / 8B 蒸馏量化模型起步

- 使用文中推荐的基础参数作为默认配置

- 遇到问题时,按“症状 → 调整”表逐项排查

- 只在确有需要时才对外开放 API,并配合鉴权与网络安全措施

随着本地 LLM 生态快速发展,DeepSeek 与 LM Studio 也会持续更新。可以关注 DeepSeek 社区与 LM Studio 官方文档,获取最新模型、量化方案与性能优化技巧。

无论是代码辅助、复杂问答,还是学习与研究,只要合理调参与配置,本地版 DeepSeek 都能在你的机器上发挥出相当可观的推理能力。祝你在本地自托管的 DeepSeek 之旅中玩得尽兴、用得安心。