99%的人以为“大模型什么都会”,但真到要查实时数据、连数据库、调接口时,才发现它其实啥都够不着。你是不是也遇到过:模型回答得头头是道,一查却是过期信息?这不是模型“笨”,而是它被关在训练数据的“玻璃房”里。MCP做的事,就是在这层玻璃上打个标准化的洞,让模型安全、统一地伸手去外面拿东西。

MCP 是什么?

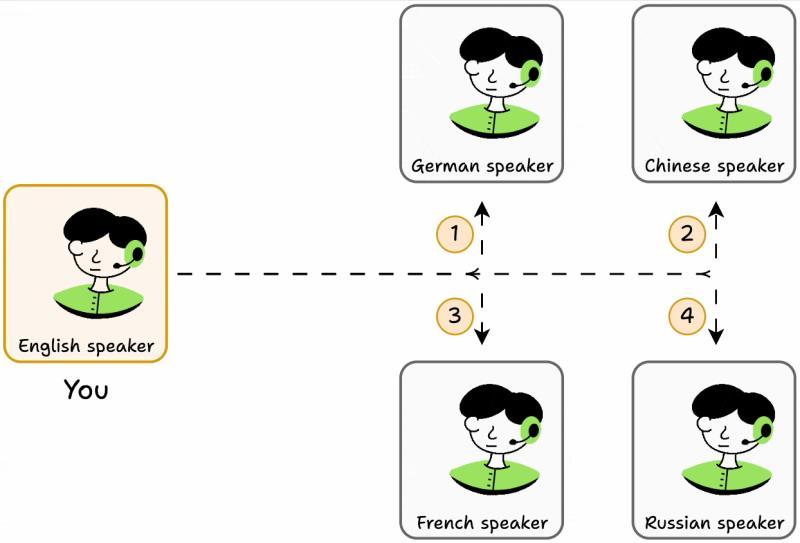

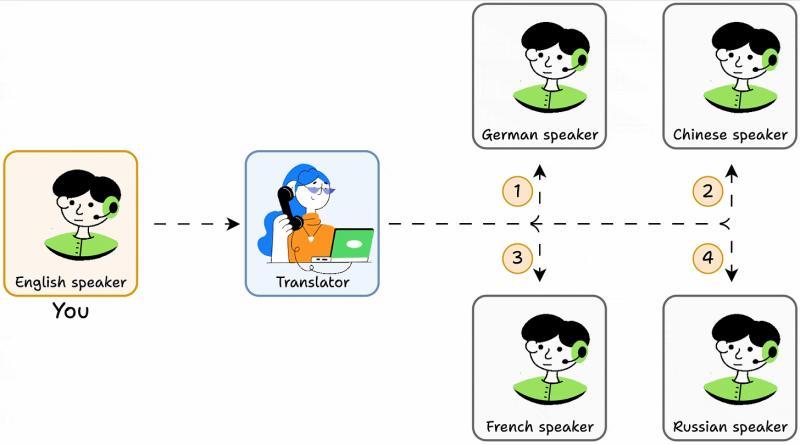

一个“会所有语言”的翻译器

想象一下,你只会说英语,却要从只会说其他语言的人那里获取信息:

- 对方说法语,你得先学法语。

- 对方说德语,你得再学德语。

- 新来一个说西班牙语的,你又得从零开始。

学到第五种语言,你大概已经崩溃了。可如果你有一个能听懂所有语言、还能帮你翻译的“超级翻译器”,你只要继续说英语,它负责和所有人沟通。这台翻译器,在AI世界里就很像 MCP:让“只会说自己接口语言”的模型,通过一个统一方式,和各种工具、服务、系统对话。

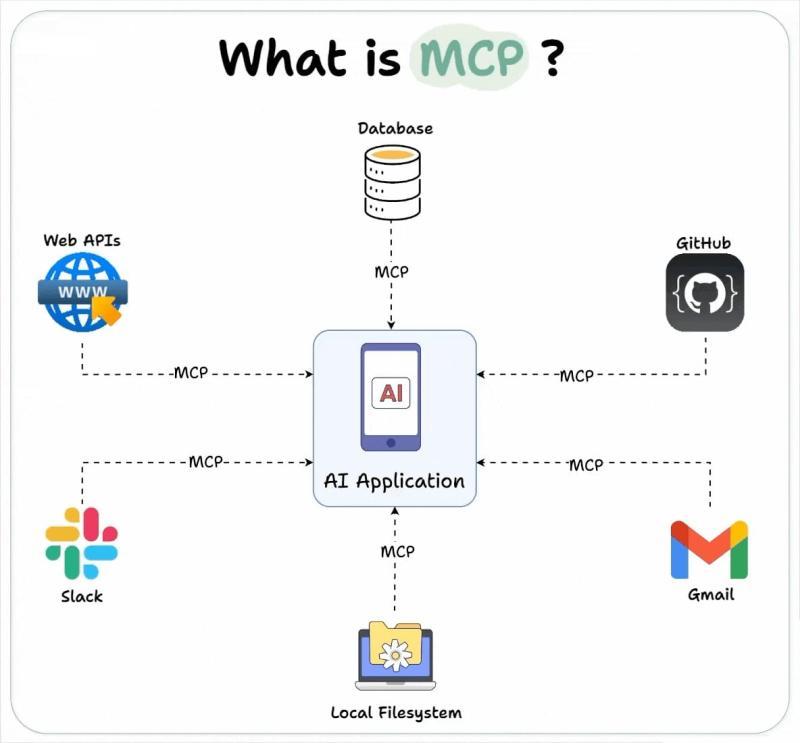

一个统一的“通用接口”

我第一次接触 MCP 的时候,脑子里蹦出来的画面就是:给模型插了一个“USB-C 适配器”。模型本身只会“自然语言”和“生成文本”,但现实世界里有:

- 数据库、搜索引擎

- 内部业务系统

- 第三方 API 和应用

MCP 提供的是一个标准化的接口和框架,让模型可以通过统一的协议,去调用这些外部能力。就像你不用关心鼠标、键盘、硬盘内部怎么实现,只要它们都支持 USB-C,就能插上就用。

有用户反馈,用 MCP 把模型接入内部知识库后,文档检索时间从人工的几分钟缩短到几秒,而且错误引用率下降了约 40%。这类体验差异,才是 MCP 存在的意义。

为什么需要 MCP?

LLM 的“天赋”和“短板”

大型语言模型(LLM)确实很强:

- 能理解复杂问题,给出结构化回答。

- 能做推理、总结、改写、生成代码。

但它有一个致命限制:知识被锁在训练数据里。数据显示,很多主流模型的知识截止时间都停在某个过去的时间点,之后发生的事,它要么不知道,要么只能“瞎猜”。

如果你让它:

- 查今天的汇率

- 读取你公司最新的销售报表

- 调用一个实时天气 API

它自己是做不到的,除非有一个机制,帮它安全地访问这些外部资源。MCP 就是为这个场景设计的:让模型可以“规规矩矩”地用工具,而不是靠幻觉补全答案。

像 USB-C 一样的“标准化连接”

可以换个角度看:

- 没有 USB-C 之前,每个设备都有自己的充电口和线,乱七八糟。

- 有了 USB-C 标准之后,手机、电脑、平板可以共用一根线,体验一下子统一了。

MCP 在 AI 生态里扮演的角色很类似:

- 统一模型与工具之间的“说话方式”。

- 让不同工具像“外设”一样被挂载和调用。

- 降低开发者为每个模型单独适配工具的成本。

有开发团队反馈,用 MCP 把内部多个服务接入后,新接一个工具的时间从几天缩短到几小时,维护成本也更可控。当然,这只是我自己的观察,可能不同团队感受会不太一样。

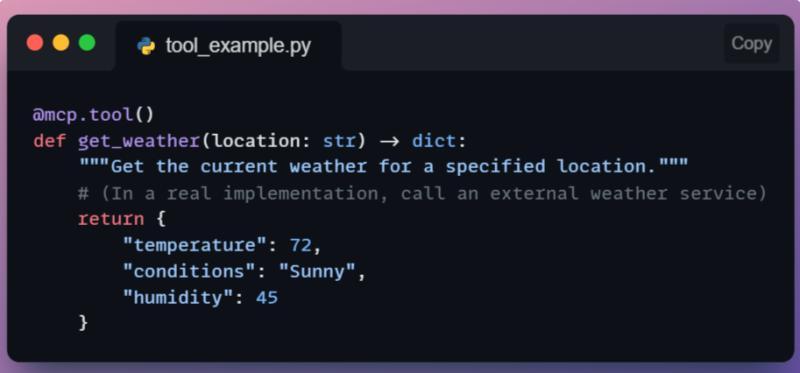

MCP 如何工作?

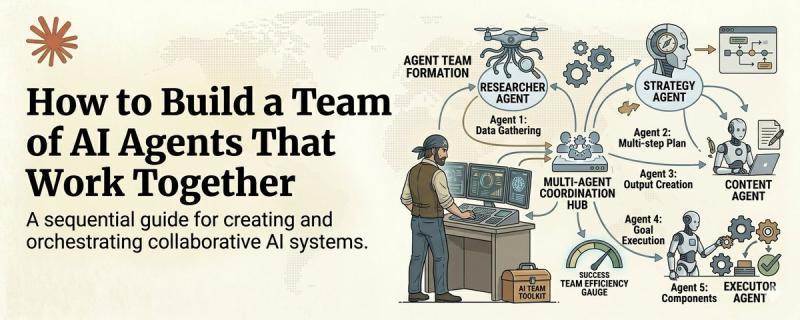

模型、工具和“中间层”

可以用一个简单的三层结构来理解 MCP:

- 顶层:模型(LLM),负责理解你的意图和规划步骤。

- 中间层:MCP 协议,定义“怎么描述工具”“怎么发起调用”“怎么拿结果”。

- 底层:具体工具或能力,比如搜索、数据库、内部 API。

当你给模型一个任务,比如“帮我查这家公司最近一年的财报并做个要点总结”,模型会:

- 通过 MCP 发现有哪些可用工具(比如“财报检索工具”)。

- 按 MCP 规定的格式,向工具发起调用请求。

- 拿到工具返回的数据,再用自己的语言能力做分析和总结。

一个真实体验的缩影

有一次我用接了 MCP 的代理去查某家上市公司的最新公告:

- 传统做法:我自己打开交易所网站,翻公告列表,下载 PDF,再手动看。

- 用 MCP 代理:我只说“帮我看下这家公司最近有没有重大人事变动”,它自动调用公告检索工具,拉回几条相关公告,然后用自然语言给我总结关键点。

说实话,那一刻的感觉有点像第一次用上智能手机:不是功能本身多神奇,而是“所有东西终于串起来了”。

MCP 带来的核心价值

对开发者:一次接入,多处复用

从开发视角看,MCP 最大的好处是“解耦”:

- 工具开发者只要按 MCP 标准暴露能力。

- 模型提供方只要支持 MCP,就能用这批工具。

- 新模型上线,不用重写一遍工具调用逻辑。

可以简单列一下 MCP 带来的几个直接收益:

- 降低接入成本:统一协议,减少重复造轮子。

- 提升可维护性:工具升级不必动模型侧逻辑。

- 方便扩展:想加新能力,只要多挂一个工具。

- 安全可控:可以在协议层做权限和审计。

有团队在内部试点时,用 MCP 把 CRM、工单系统、知识库都接了起来,客服只和一个 AI 助手对话,背后却是多个系统在协同工作。

对用户:更“懂事”的 AI 助手

从普通用户的角度,你可能不关心 MCP 这三个字母,但会直接感受到:

- AI 不再只会“瞎编”,而是会说“我去查一下”。

- 它能读你给的文件、连你常用的应用、看实时数据。

- 回答里多了“基于刚刚查询到的结果”这种更可靠的表述。

有用户评价接入 MCP 后的助手:“以前像一个会聊天的百科全书,现在更像一个能帮我跑腿、查资料、做整理的实习生。”虽然偶尔还会犯错,但整体体验已经完全不在一个量级。

当然,风险也存在:如果工具本身数据有误,或者权限配置不当,模型可能会基于错误信息做出“理直气壮”的回答。这一点需要在设计和使用时格外小心。

使用 MCP 时要注意什么?

风险与边界

MCP 再强,也不是“万能钥匙”。有几个现实风险需要提前看到:

- 工具数据质量:垃圾进,垃圾出,模型只是在“认真处理垃圾”。

- 权限控制:给模型开的工具权限太大,可能误删数据或泄露敏感信息。

- 复杂度上升:工具一多,调用链变长,排查问题会更麻烦。

有开发者吐槽,刚开始把一堆工具都挂上 MCP,结果模型频繁选错工具,调试了好几天才把工具描述和调用策略调顺。这种“磨合期”几乎不可避免。

一个简单的判断方法

如果你在考虑要不要用 MCP,可以用一个小 checklist 来判断:

- 你的场景是否强依赖实时或私有数据?

- 是否需要接多个不同系统或服务?

- 是否希望未来可以方便地更换模型或增加工具?

三个问题里有两项以上回答是“是”,那 MCP 大概率值得你认真研究。它不是银弹,但在这类场景里,确实能省下很多重复劳动。

在信息爆炸又工具繁多的当下,谁能更快、更稳地把 AI 和真实世界的系统接起来,谁就更有优势。MCP 提供的这套“通用插口”,已经在不少团队里被反复验证有效,挺适合先收藏起来,等你要搭 AI 助手或代理系统时拿出来对照一遍。

常见问题

Q:MCP 和普通的 API 调用有什么区别?

A:MCP 不是替代 API,而是对“模型如何使用 API”的一种标准化封装。传统做法是开发者在应用层写死调用逻辑,而 MCP 让模型通过统一协议发现、理解并调用工具。这样做的好处是:工具可以被多个模型、多个应用复用,调用方式更一致,也更便于权限管理和审计。对你来说,就是少写一堆重复的 glue code,多把精力放在业务逻辑上。

Q:小团队做项目,有必要上 MCP 吗?

A:如果你的项目只连一两个固定接口,短期内也不打算扩展,直接写调用逻辑就够了,不一定非要上 MCP。原因在于 MCP 的价值更多体现在“规模”和“复用”上:工具多、模型多、场景多时,标准化接口能显著降低复杂度。建议做一个简单评估:如果你预期未来会接入 3 个以上系统,或者打算支持不同模型,那尽早用 MCP 反而能省后面的重构成本。

Q:MCP 会不会让安全风险变大?

A:如果设计不当,确实可能放大风险,比如给模型开放了过高权限的工具,导致误操作或数据泄露。根本原因是 MCP 让模型更容易“动手”,一旦权限边界没划清,问题就会更严重。可操作建议是:对每个工具做最小权限设计,敏感操作增加人工确认或多步验证,并在 MCP 层记录调用日志,方便事后审计和回溯。

Q:MCP 会不会让系统变得更难调试?

A:短期看,接入 MCP 会增加一层“中间协议”,调试路径确实更长;但从中长期看,它反而有利于调试。原因在于 MCP 统一了调用格式和日志结构,你可以清楚看到“模型发了什么请求、工具回了什么结果”。建议在开发阶段打开详细日志,把典型调用链跑通并记录下来,后续遇到问题时,就能快速对比是模型决策问题,还是工具实现问题。

Q:普通用户需要了解 MCP 吗?

A:普通用户不需要掌握 MCP 的技术细节,但理解它在做什么,会帮你更好地判断 AI 助手的能力边界。原因是:接了 MCP 的助手,能访问哪些工具、哪些数据,直接决定了它能帮你做到什么程度。你可以有意识地问一句“你现在能连到哪些系统?”来摸清它的能力范围,再决定要不要把更关键的任务交给它,这比盲目信任要安全得多。