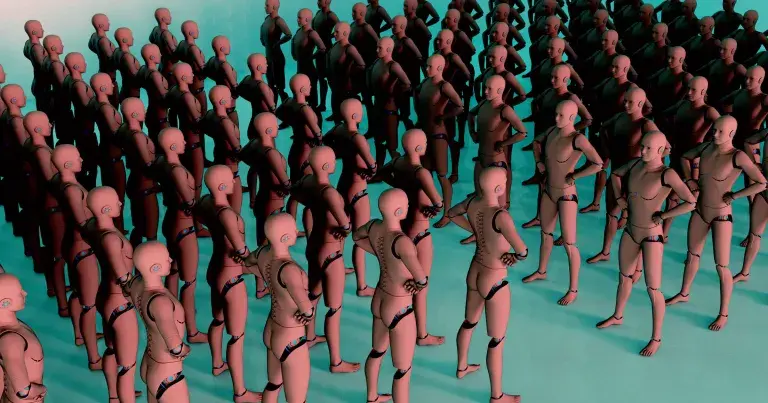

据《科学》杂志最新研究指出,人工智能不仅仅是聊天机器人和表情包生成器,它还可能成为虚假信息的源泉,只需有人开启“水龙头”,虚假信息便会泛滥。该研究重点探讨了大型语言模型(LLM)和自主智能体如何在“全人口范围内”操纵舆论。研究者特别指出了AI群体的威胁:大量自主AI工具通过互联网和社交媒体模仿真实人类,形成庞大的虚假群体。

研究显示,组织化的社交媒体操控已从2017年的28个国家扩展到如今的70个国家,涵盖菲律宾、美国等多个国家。巴西和爱尔兰的选举中出现的AI驱动虚假信息事件表明,民主机构正面临日益复杂的威胁。

论文摘要警告称:“将大型语言模型的推理能力与多智能体架构结合,这些系统能够自主协调,渗透社区,并高效制造共识。”

针对这种干预行为的立法面临诸多难题,例如宣传机器人网络是否属于言论自由范畴。一些AI机器人网络甚至公开作为盈利初创企业运营,吸引风险投资数百万美元。

在AI出现之前,少数不受监管的社交媒体平台已为大规模虚假信息活动创造了条件。这些活动在现实世界中造成了严重后果,如缅甸Facebook助长的罗兴亚种族灭绝事件。

目前,我们已见到AI驱动的虚假信息活动的初步表现,常见于右翼势力煽动对福利领取者或移民的仇恨。

无论AI虚假信息带来何种后果,显然这条道路早已铺就,而政治层面对遏制此类行为的意愿却极为有限。