随着私营企业违约率达到9.2%,创多年新高,风险投资公司Lux Capital近期建议依赖AI的企业务必获得计算资源的书面确认。金融不稳定性波及AI供应链,Lux警告称,口头协议已不再可靠。

然而,还有另一种选择——完全停止依赖外部计算基础设施。能够直接在用户设备上运行的小型AI模型——无需数据中心、云服务商或对手方风险——正变得足够强大,值得关注。西班牙初创公司Multiverse Computing正是这一领域的代表。

这家初创公司此前较为低调,但随着对AI效率需求的增长,情况正在改变。Multiverse对包括OpenAI、Meta、DeepSeek和Mistral AI在内的主要AI实验室的模型进行了压缩,并推出了展示其压缩模型能力的应用程序和API门户,方便开发者访问和构建这些模型。

其CompactifAI应用程序采用了与Multiverse量子启发式压缩技术同名的技术,是一款类似ChatGPT或Mistral Le Chat的AI聊天工具。用户提问,模型回答。不同之处在于,Multiverse内嵌了名为Gilda的模型,该模型体积极小,可实现本地离线运行。

对于终端用户来说,这意味着AI可以在边缘设备上运行,数据不离开设备,也无需联网。但前提是设备必须拥有足够的内存和存储空间。若设备条件不足(许多旧款iPhone即不支持),应用会自动切换至基于云的模型。该切换由Multiverse命名为Ash Nazg的系统自动管理,这一名字源自《指环王》中的至尊魔戒铭文。但一旦切换至云端,应用的隐私优势将大打折扣。

这些限制使得CompactifAI尚未准备好大规模用户采用,且这可能并非其初衷。根据Sensor Tower数据,该应用过去一个月下载量不足5000次。

真正的目标客户是企业。Multiverse现已推出自助API门户,允许开发者和企业直接访问其压缩模型,无需通过AWS Marketplace等平台。

Multiverse首席执行官Enrique Lizaso表示:“CompactifAI API门户为开发者提供了直接访问压缩模型的途径,具备透明度和控制能力,适合生产环境使用。”

API的实时使用监控是其核心功能之一。除了边缘部署的潜在优势外,降低计算成本是企业考虑小型模型替代大型语言模型(LLM)的主要原因之一。

小型模型的能力也在不断提升。Mistral近期发布了优化通用聊天、编码、代理任务和推理的Mistral Small 4,并推出Forge系统,帮助企业定制符合其需求的小型模型。

Multiverse最新压缩模型HyperNova 60B 2602基于开源的gpt-oss-120b模型,声称在保持智能水平的同时,响应速度更快且成本更低,尤其适合自动完成复杂多步骤编程任务的代理编码工作流。

将模型压缩到可在移动设备上运行且仍具实用性的水平是一大挑战。Apple Intelligence通过结合本地模型和云模型解决了这一问题。Multiverse的CompactifAI应用也支持通过API调用gpt-oss-120b云模型,但其主要目标是展示本地模型如Gilda及其后续版本在成本节约之外的优势。

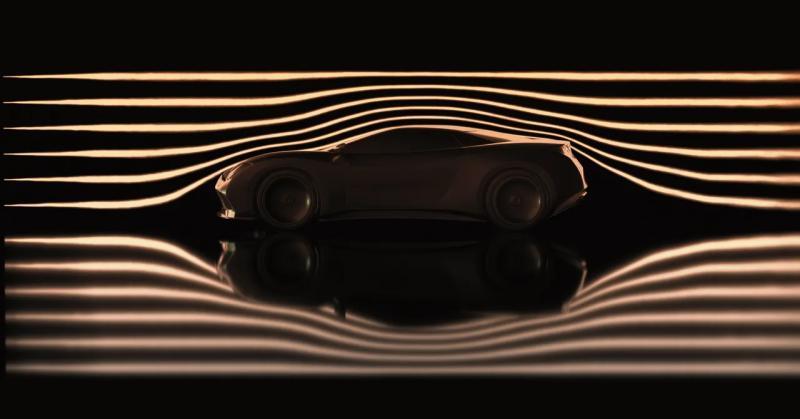

对于关键领域的工作人员来说,本地运行且无需连接云端的模型提供了更高的隐私和系统韧性。更重要的是,这种能力可解锁更多商业应用场景,例如在无人机、卫星等无法保证持续连接的环境中嵌入AI。

Multiverse已服务超过100家全球客户,包括加拿大央行、博世和Iberdrola。扩大客户基础有助于其获得更多融资。去年完成2.15亿美元B轮融资后,传闻其正筹集5亿欧元新一轮资金,估值超过15亿欧元。