ModelScope 魔搭社区是一个面向开发者、研究者与企业用户的 AI 模型开放平台,汇聚了来自各领域的前沿机器学习模型与大模型,提供从模型探索、在线推理、训练微调到部署上线的完整链路能力。用户可以在平台上发现、学习、定制和分享模型,快速构建各类智能应用。

产品详细介绍

ModelScope 魔搭社区由阿里巴巴主导建设,是一个以模型为核心的开放生态平台,目标是降低 AI 技术门槛,让更多个人与企业可以便捷地使用先进的机器学习与大模型能力。

1. 核心定位

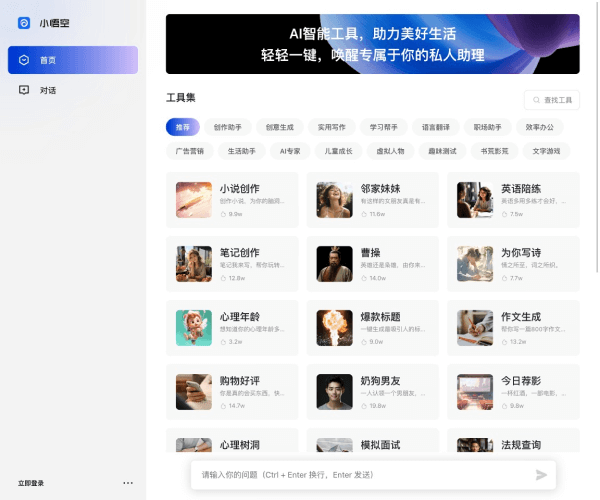

- 模型聚合平台:集中展示来自官方团队、社区开发者和合作伙伴的多领域模型,包括自然语言处理、计算机视觉、语音、多模态、大语言模型等。

- 一站式模型服务:从模型浏览、在线体验、推理调用,到训练微调、部署上线与应用集成,提供端到端的工具与服务。

- 开源与社区共建:支持模型与代码开源托管,鼓励开发者贡献模型、数据集与示例项目,形成活跃的技术社区。

2. 主要功能模块

1)模型库(Model Zoo)

- 提供海量预训练模型与大模型,按任务类型、框架、大小、作者等维度分类检索。

- 支持查看模型说明文档、配置参数、性能指标与适用场景。

- 多种框架支持(如 PyTorch、TensorFlow 等),便于集成到现有工程。

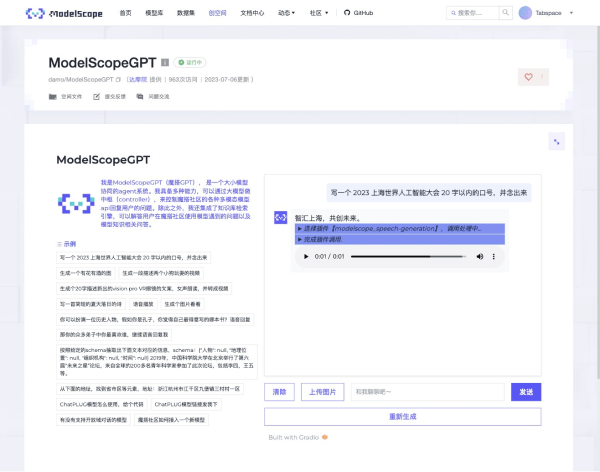

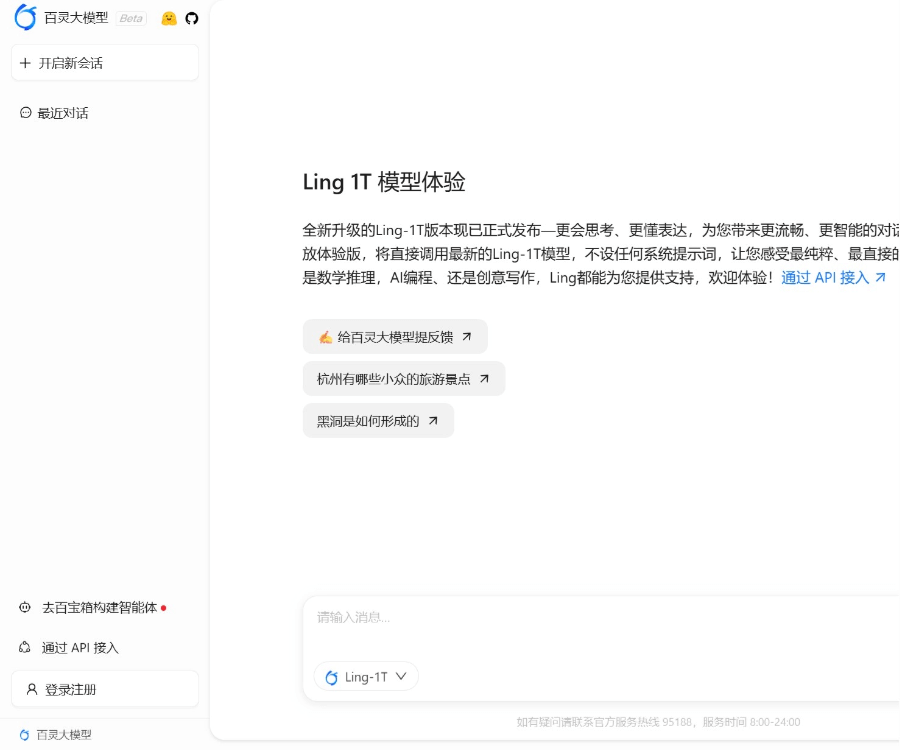

2)在线推理与体验

- 在网页端直接输入文本、图片、音频等数据,快速体验模型效果。

- 支持常见任务如文本生成、翻译、问答、图像识别、图像生成、语音识别与合成等。

- 无需本地环境配置,即可评估模型是否满足业务需求。

3)训练与微调能力

- 提供基于云端资源的训练与微调入口,支持对开源模型进行二次训练。

- 结合数据集管理与任务配置,帮助用户快速构建适配自身场景的定制模型。

- 支持常见训练范式,如监督微调、指令微调、LoRA 等(具体以平台实际支持为准)。

4)部署与应用集成

- 提供模型服务化能力,可将模型部署为在线推理服务。

- 支持通过 API / SDK 调用模型,方便集成到网站、应用、后端服务或业务系统中。

- 部分模型支持一键部署到指定云环境,降低运维与上线成本。

5)社区与资源生态

- 模型作者主页与组织空间,展示作品与解决方案。

- 教程、示例项目与实践案例,帮助新手快速上手。

- 讨论区与 issue 反馈机制,便于交流问题、分享经验与共建生态。

3. 适用人群与典型场景

- 开发者与工程师:快速选型合适模型,集成到应用或服务中。

- 算法研究者:基于开源模型与数据集进行实验、复现与创新研究。

- 企业与团队:构建智能客服、内容生成、图像识别、语音交互等业务能力。

- 学生与学习者:通过在线体验与示例项目,学习 AI 模型的原理与实践。

典型应用场景包括:智能问答与搜索、文本生成与改写、内容审核、图像分类与检测、OCR、语音识别与合成、多模态理解与生成等。

简单使用教程

以下以新用户为例,介绍从访问平台到调用模型的基础流程(具体界面与步骤以实际网站为准)。

步骤一:访问与注册登录

- 打开浏览器,访问官网链接:https://www.modelscope.cn。

- 使用邮箱或第三方账号注册新用户,完成账号激活。

- 登录后可获得更多权限,如收藏模型、创建项目、调用部分受限服务等。

步骤二:浏览与搜索模型

- 在首页或“模型”栏目中浏览推荐与热门模型。

- 使用搜索框输入关键词(如“文本生成”“图像识别”“ASR”等)筛选模型。

- 通过任务类型、框架、作者、语言等筛选条件进一步缩小范围。

- 点击某个模型进入详情页,查看:

- 模型简介与适用场景

- 输入输出格式说明

- 使用示例代码

- 性能指标与版本信息

步骤三:在线体验与推理

- 在模型详情页中找到“在线体验”或“推理”入口。

- 根据模型类型输入测试数据:

- 文本模型:输入一段文本或问题。

- 图像模型:上传图片文件。

- 语音模型:上传音频或录音。

- 点击运行或提交,等待平台返回推理结果。

- 根据效果判断该模型是否满足你的业务或研究需求。

步骤四:本地或云端调用模型

- 在模型详情页查看“使用说明”或“快速开始”:

- 复制示例代码(通常包含安装依赖、加载模型、推理调用等步骤)。

- 根据自己的开发环境(如 Python)调整路径与参数。

- 若平台提供 SDK 或 API:

- 在“文档”或“开发者中心”查看如何获取访问密钥(如 API Key)。

- 按文档说明配置鉴权信息,并在代码中调用对应接口。

- 在本地或服务器环境中运行示例代码,验证调用是否成功。

步骤五:训练与微调(进阶)

- 准备好你的数据集,并确保格式符合平台或模型要求。

- 在平台中找到“训练”“微调”或“任务”入口,创建新任务。

- 选择基础模型、上传或关联数据集,配置训练参数(如学习率、批大小、训练轮数等)。

- 提交任务后,可在控制台查看训练进度与日志。

- 训练完成后,生成的模型可继续在线体验、部署或通过 API 调用。

步骤六:部署与集成(进阶)

- 在模型或训练产出模型的页面,查找“部署”或“服务化”选项。

- 按向导选择部署方式(如在线服务、云端部署等)。

- 部署完成后,获取服务地址与调用示例。

- 在你的业务系统中通过 HTTP 接口或 SDK 调用该服务,实现功能集成。

FAQ 常见问题

1. 使用 ModelScope 是否收费?

平台本身与大部分开源模型浏览通常是免费的,但部分在线推理、训练资源或企业级服务可能按资源或套餐收费,具体以官网说明与计费规则为准。

2. 一定要有深度学习基础才能使用吗?

不一定。对于入门用户,可以通过在线体验与示例项目直接感受模型效果;若需要本地集成或训练微调,则建议具备基本的编程与机器学习知识。

3. 模型能否用于商业项目?

是否可商用取决于具体模型的开源协议与使用条款。使用前请在模型详情页查看许可证(License)与作者说明,确保符合授权范围。

4. 本地环境运行模型需要什么配置?

不同模型对硬件要求不同:

- 小型模型可在普通 CPU 环境运行。

- 大模型或复杂视觉/多模态模型通常需要 GPU 支持。

建议根据模型文档中的环境要求准备相应的软硬件环境。

5. 如何反馈问题或参与社区共建?

你可以:

- 在模型页面提交 issue 或反馈。

- 参与讨论区话题,与其他开发者交流。

- 通过提交模型、数据集或示例项目的方式参与开源共建。

具体参与方式与规范可参考官网的社区与贡献指南。