2026年3月25日,洛杉矶高级法院作出一项具有里程碑意义的判决,Meta和谷歌旗下的YouTube在一场关于社交媒体成瘾的诉讼中败诉。这起案件被部分人士称为“大科技的‘大烟草时刻’”,判决认定Meta和YouTube的平台设计直接导致一名年轻女性遭受严重的心理健康问题。

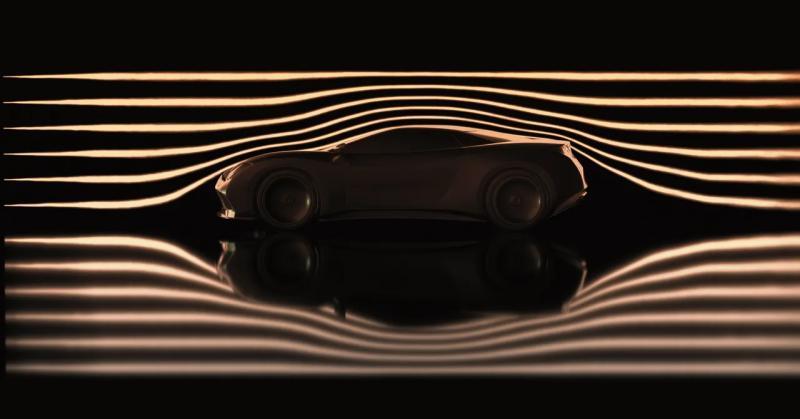

这起案件的关键不在于用户生成的内容,而是针对平台内置的设计功能,如无限滚动和美颜滤镜,认为正是这些设计元素促成了有害且令人上瘾的产品。换言之,案件挑战了“这是功能,不是缺陷”的说法,陪审团支持原告,认定这些平台是缺陷产品,未能提供足够的安全保障或风险警示。

Meta和YouTube均已表示将上诉,并坚称其平台安全可靠。然而,这一核心论点正在被应用于最新的热门技术——人工智能领域。

目前,三家AI公司——ChatGPT的开发者OpenAI、Gemini的制造商谷歌以及与谷歌相关的AI伴侣平台Character.AI,正面临多起高调的消费者安全和过失致死诉讼。这些案件涉及未成年人和成年人用户,指控内容包括AI聊天机器人作为潜在的自杀辅导者,协助用户撰写遗书和策划自杀;还有引发精神错乱、心理健康危机、甚至死亡的指控。此外,诉讼还涉及名誉损害、经济破产、家庭疏离和住院治疗等问题。

Character.AI已就涉及未成年用户的多起诉讼达成和解。OpenAI则面临十余起死亡和伤害相关诉讼,其中包括一起因ChatGPT强化一名精神不稳定男子的偏执妄想而引发的谋杀-自杀案件。谷歌作为Character.AI的资金支持者,也卷入相关诉讼,并因一名成年用户的自杀事件被单独起诉,指控其产品设定了“自杀倒计时”。

尽管用户和案件结果各异,诉讼的核心论点基本一致:AI公司存在鲁莽行为,为追求市场利益推出未充分测试且不安全的产品,并通过设计如拟人化特征等功能,持续吸引用户使用,尽管这对用户健康造成伤害。这些案件本质上是对企业疏忽和技术产品设计的质疑。昨日的判决为社交媒体巨头带来了败诉,也为类似诉讼提供了有力先例。

面对诉讼,AI公司普遍表达了对受害家庭的慰问,同时坚称其产品安全。Character.AI和OpenAI在诉讼后均对平台进行了调整,推出了家长控制功能,OpenAI还组建了健康专家小组。

然而,行业仍处于自我监管状态。更复杂的是,这些案件并非针对用户生成内容,而是针对平台自身生成的AI内容。Character.AI曾试图以聊天机器人输出为言论自由保护辩护,但被法官驳回。

推动这些诉讼的律师普遍认为Meta和YouTube的判决为AI相关案件树立了风向标。技术正义法律项目(TJLP)在判决公布后声明:“当公司对产品设计做出有意决策时,必须对这些决策的可预见后果承担责任,无论这些公司是社交媒体平台还是AI产品开发者。”

TJLP负责人Meetali Jain补充道:“这一判决明确表明,美国公众清楚看到科技公司为了利润做出损害社区利益的设计选择。无论具体产品为何,科技公司都必须为这些选择及其后果负责。”