DeepSeek(深度求索)成立于 2023 年,专注于世界领先的通用人工智能底层模型与技术研发。依托自研训练框架、自建智算集群和万卡级算力,团队在短时间内发布并开源多款百亿级参数大模型,在公开评测和真实场景中均展现出优异的泛化能力,并提供在线对话与 API 接入服务,帮助个人开发者与企业快速使用先进的大模型能力。

产品详细介绍

DeepSeek 是一个以“底层模型 + 自主算力 + 开源生态”为核心的通用人工智能技术平台,目标是持续挑战人工智能前沿难题,并将高性能大模型能力开放给开发者与企业用户。

1. 核心技术与基础设施

1)自研训练框架:

- 针对大规模分布式训练进行深度优化,支持百亿级乃至更大参数规模模型的高效训练与推理。

- 在算力利用率、训练稳定性和成本控制方面进行系统级优化,降低大模型研发门槛。

2)自建智算集群与万卡算力:

- 采用大规模 GPU/AI 加速集群,形成万卡级算力基础设施。

- 支持多模型并行训练、持续迭代和大规模推理服务,为在线 API 和企业部署提供稳定算力保障。

3)高性能推理与服务化能力:

- 针对推理场景进行模型结构与系统层优化,提升响应速度与并发能力。

- 支持在线对话、批量推理、API 调用等多种服务形态,便于集成到各类应用中。

2. 主要大模型产品

1)DeepSeek-LLM 通用大语言模型:

- 面向通用自然语言理解与生成任务,支持多轮对话、内容创作、知识问答、逻辑推理等。

- 在公开评测榜单中表现优异,并在真实样本外具有良好的泛化能力。

- 适用于智能助手、搜索增强问答、内容生成、企业知识库问答等场景。

2)DeepSeek-Coder 代码大模型:

- 专注编程与软件开发场景,支持多种主流编程语言的代码生成、补全、重构与解释。

- 可用于智能编程助手、代码审查、自动化脚本生成、学习编程辅导等。

- 在代码理解与复杂函数生成方面具备较强能力,有助于提升开发效率、降低出错率。

3)DeepSeek-MoE MoE 大模型:

- 国内率先开源的 MoE(Mixture of Experts,专家混合)大模型之一。

- 通过专家路由机制,在保持模型容量巨大的同时控制推理成本,实现“高性能 + 高性价比”的平衡。

- 适合需要大容量模型能力、又对推理成本敏感的企业与平台级应用。

3. 开源与生态

- 多个百亿级参数模型已开源,便于研究者与开发者进行二次开发、微调与部署。

- 支持在主流深度学习框架和云平台上运行,方便集成到现有技术栈。

- 通过开源推动学术研究与产业创新,形成围绕 DeepSeek 模型的工具链与社区生态。

4. 应用场景

- 智能对话与客服:构建 7×24 小时在线智能客服、业务咨询助手。

- 内容创作与运营:用于文案撰写、营销内容生成、报告草稿、脚本创作等。

- 代码开发与运维:为开发者提供代码补全、调试建议、自动生成测试用例等能力。

- 教育与培训:构建个性化学习助手、编程教学助手、知识问答机器人。

- 企业知识与决策支持:结合企业内部知识库,提供检索增强问答与决策辅助分析。

简单使用教程

以下为基于 DeepSeek 在线对话与 API 接入的一般性使用步骤,具体以官网最新文档为准。

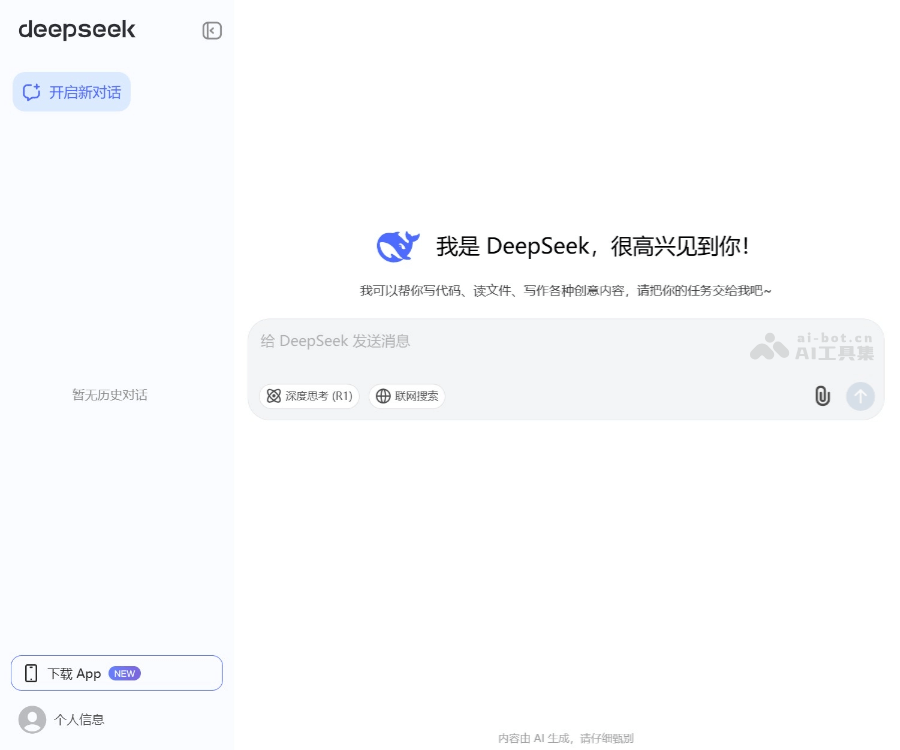

一、快速开始:在线对话

1)访问官网:

- 打开浏览器,访问 https://deepseek.com。

2)注册 / 登录账号:

- 使用邮箱或支持的第三方登录方式创建账号。

- 完成基础信息填写与邮箱验证(如有)。

3)进入对话界面:

- 登录后,在首页或产品入口中选择“和 DeepSeek AI 对话”或类似入口。

- 进入聊天界面后,即可像使用聊天工具一样输入问题或指令。

4)示例用法:

- 通用问答:输入“帮我解释一下大模型中的 MoE 是什么?”

- 内容创作:输入“请帮我写一篇 500 字的产品发布会新闻稿草稿。”

- 学习辅导:输入“用通俗语言讲解一下 Transformer 的基本原理。”

二、API 接入(通用流程示例)

1)获取 API 访问权限:

- 在官网登录后,进入“开发者中心”或“API”相关页面。

- 创建应用或项目,获取 API Key(密钥)。

2)阅读文档与示例:

- 在文档中心查看“快速开始”“API 参考”等章节。

- 了解可用模型(如 DeepSeek-LLM、DeepSeek-Coder、DeepSeek-MoE)的模型名称、参数说明和调用限制。

3)发起基础请求(伪代码示例逻辑):

- 在后端代码中配置:

- 接口地址(Base URL)

- 请求头中加入 Authorization(携带 API Key)

- 请求体中指定 model、prompt(或 messages)、max_tokens、temperature 等参数。

4)处理返回结果:

- 解析接口返回的 JSON 数据,获取模型生成的文本内容。

- 将结果展示在前端页面、终端工具或集成到业务流程中。

5)常见集成场景:

- Web 应用:在网站中嵌入智能问答或写作助手。

- 内部工具:在企业内部系统中集成代码助手、知识问答机器人。

- 插件与扩展:为 IDE、浏览器或办公软件开发智能插件。

三、模型选择与调优建议

1)模型选择:

- 通用对话与内容生成:优先选择 DeepSeek-LLM。

- 编程与技术场景:优先选择 DeepSeek-Coder。

- 需要高容量与高性价比:考虑使用 DeepSeek-MoE。

2)参数调节:

- temperature:控制生成内容的“随机性”,数值越高越发散,越低越稳健。

- max_tokens:限制单次生成的最大长度,避免过长输出影响响应时间与成本。

- top_p / top_k(如支持):进一步控制采样策略,平衡多样性与稳定性。

3)安全与合规:

- 在接入到实际业务前,建议对输出内容进行必要的审核与过滤。

- 对涉及隐私、敏感数据的场景,注意数据脱敏与访问控制。

FAQ 常见问题

Q1:DeepSeek 提供哪些类型的大模型? A:DeepSeek 目前主要提供通用大语言模型 DeepSeek-LLM、代码大模型 DeepSeek-Coder,以及国内首个开源 MoE 大模型 DeepSeek-MoE,并在持续迭代更多模型与版本。

Q2:这些模型是否开源? A:DeepSeek 已开源多个百亿级参数大模型,具体开源模型列表、权重下载地址和使用协议可在官网或官方代码仓库中查看。

Q3:如何开始使用 DeepSeek 的 API? A:在官网注册并登录后,前往“开发者中心”或“API”页面,创建应用获取 API Key,然后根据文档示例在代码中配置接口地址、请求头和请求参数即可调用。

Q4:DeepSeek-Coder 适合哪些人使用? A:DeepSeek-Coder 适合各类开发者、运维工程师、数据工程师以及正在学习编程的用户,可用于代码生成、补全、调试建议、脚本编写和学习辅导等。

Q5:DeepSeek-MoE 有什么优势? A:DeepSeek-MoE 采用专家混合(MoE)架构,在保持巨大模型容量的同时,通过只激活部分“专家”参与推理,降低计算成本,实现更高的性能与性价比,适合对成本敏感但又需要强大模型能力的应用场景。

Q6:是否可以在本地或私有环境部署模型? A:由于 DeepSeek 多款模型已开源,理论上支持在本地或私有云环境部署。具体部署方式、硬件要求和许可条款需参考官方开源仓库与使用协议。

Q7:DeepSeek 的模型在中文场景表现如何? A:DeepSeek 模型在公开评测榜单和真实样本外测试中表现优异,尤其针对中文理解与生成进行了优化,适合中文对话、内容创作和企业级中文应用场景。

Q8:企业接入时需要注意什么? A:企业接入时需重点关注:数据安全与合规、访问控制与权限管理、调用频率与成本控制,以及对输出内容的审核机制。建议在测试环境充分验证后再大规模上线。