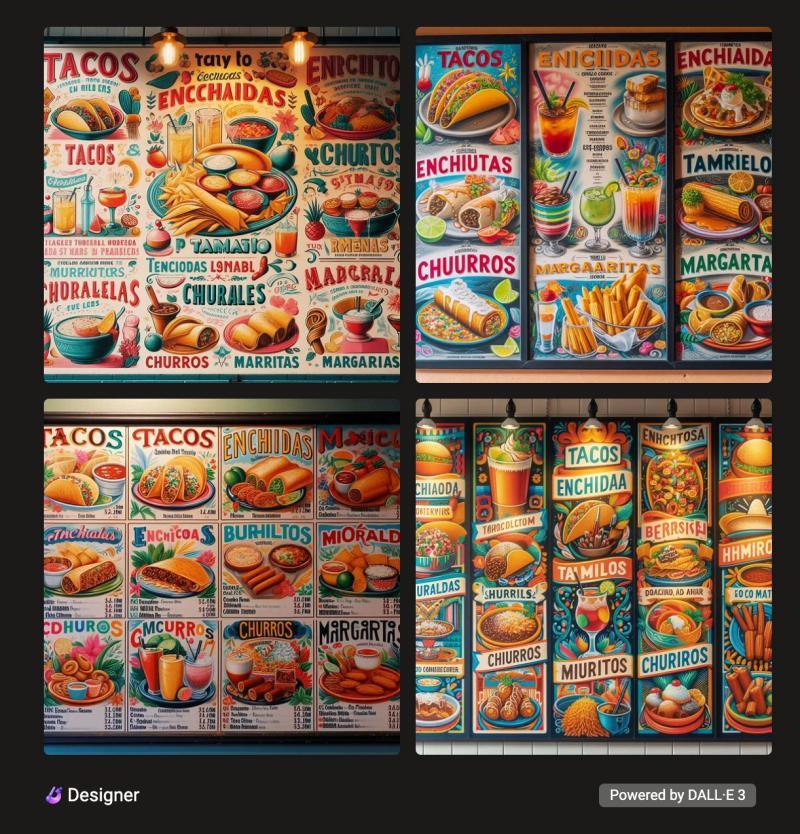

过去,人们很容易区分人类制作的图像和AI生成的图像——仅仅两年前,使用图像模型生成墨西哥餐厅菜单时,常常会出现诸如“enchuita”、“churiros”、“burrto”和“margartas”等不存在的菜名。

如今,当我让全新的ChatGPT Images 2.0模型生成墨西哥餐厅菜单时,它能直接生成一份可以在餐厅使用的菜单,顾客几乎察觉不到异常。(不过,13.50美元的酸橘汁腌鱼价格可能会让人怀疑鱼的质量。)

作为对比,以下是两年前我用DALL-E 3生成的结果(当时ChatGPT还不支持生成图像):

历史上,AI图像生成器在拼写方面表现不佳,因为它们通常采用扩散模型,通过从噪声中重建图像来工作。

Lesan AI的创始人兼CEO Asmelash Teka Hadgu在2024年接受采访时表示:“扩散模型是在重建给定的输入,我们可以假设图像上的文字只占极小一部分,因此图像生成器主要学习覆盖更多像素的模式。”

研究人员随后探索了其他图像生成机制,比如自回归模型,这类模型通过预测图像应有的样子,运作方式更类似于大型语言模型(LLM)。

不过,OpenAI在本周的新闻发布会上拒绝透露ChatGPT Images 2.0背后的具体模型类型。

公司解释称,新模型具备“思考能力”,能够进行网络搜索、根据一个提示生成多张图像,并对生成内容进行多次核查。这使得Images 2.0能够生成不同尺寸的营销素材以及多格漫画。

OpenAI还表示,Images 2.0对非拉丁文字(如日语、韩语、印地语和孟加拉语)的渲染理解更强。该模型的知识截止于2025年12月,这可能影响其对涉及近期新闻的提示的生成准确性。

OpenAI在新闻稿中指出:“Images 2.0在图像创作上带来了前所未有的细节和真实感。它不仅能构思更复杂的图像,还能有效实现这些构想,能够遵循指令,保留请求的细节,呈现常常令图像模型崩溃的细微元素:小文字、图标、用户界面元素、密集构图和细微的风格限制,最高支持2K分辨率。”

这些能力意味着图像生成速度不如直接向ChatGPT提问那么快,但生成复杂内容如多格漫画仍只需几分钟。

所有ChatGPT和Codex用户将于周二开始使用Images 2.0,付费用户可以生成更高级的输出。OpenAI还将开放gpt-image-2 API,价格将根据输出的质量和分辨率而定。