谷歌期待已久的人工智能愿景终于成为现实。今天,谷歌联合宣布基于Gemini的“任务自动化”功能已进入Beta测试阶段。该功能标志着AI助手从单纯的“信息搜索者”转变为能够跨应用执行任务的“数字助理”,能够模拟人类操作完成订餐、叫车等复杂流程。

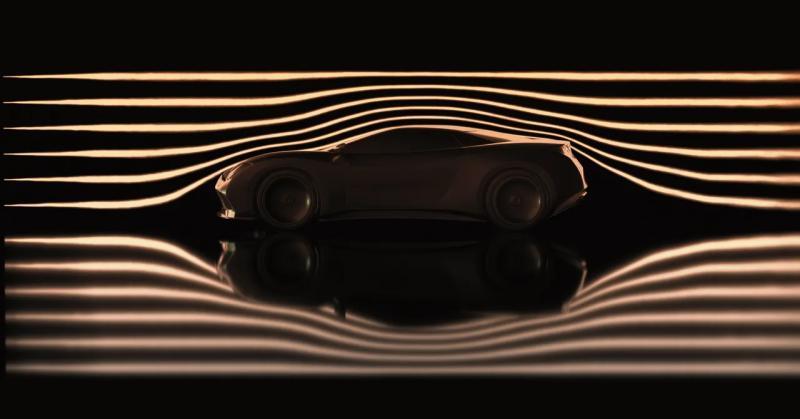

视觉冲击:看手机“自己操作”

与传统的API集成不同,谷歌的自动化功能在一个虚拟窗口内模拟真实用户操作:

- 智能叫车:当用户发出“叫一辆去机场的出租车”指令时,系统会自动打开Uber,确认具体航站楼(如果有多个航站楼,会主动询问),并自动填写目的地。

- 订餐服务:当用户说“帮我点一杯咖啡和一个羊角面包”时,AI会自主滚动屏幕,查找星巴克菜单中的具体商品(如Flat White),甚至能像人类一样处理复杂的滚动选择。

安全机制:关键环节由人掌控

为避免自动化带来的风险,谷歌在自动化流程中引入了严格的人工审核机制:

- 明确操作:用户可以实时观看AI的每一步操作,随时接管或终止自动化流程。

- 最终确认:在提交订单或付款前,系统会停留在支付界面,等待用户核对信息并手动点击“确认”,确保每笔交易都在可控条件下完成。

目前,该功能优先支持外卖和叫车应用。对于使用Gemini及后续版本的用户来说,手机不再只是运行应用的载体,而是能够理解自然语言意图并将其转化为具体操作的“超级代理”。

尽管AI在滚动菜单和识别选项时偶尔显得有些“笨拙”,这种无需深度API适配、直接通过UI交互实现的自动化模式极大拓展了AI助手的应用边界。随着算法的不断迭代,我们正逐步告别频繁切换应用的时代,迈入只需一句话即可完成所有小任务的真正智能阶段。