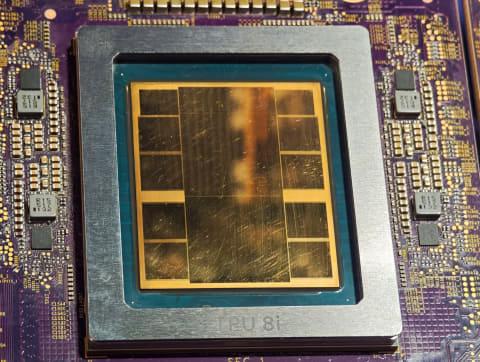

日本国家谷歌云(Google Cloud)将于2026年4月22日至25日在美国内华达州拉斯维加斯市的曼德勒湾会议中心举办年度盛会“Google Cloud Next '26”。在此之前,公司发布了自研的第八代TPU(张量处理单元)。与以往主要面向AI学习或兼顾学习与推理不同,这一代TPU分为专注学习的TPU 8t和专注推理的TPU 8i两款产品。

TPU 8t在使用FP4格式时的峰值算力达到12.6PFLOPS,配备216GB的高带宽内存(HBM);而TPU 8i则实现10.1PFLOPS峰值算力,搭载288GB的HBM内存。

谷歌自研AI定制芯片TPU,仅在谷歌云数据中心使用

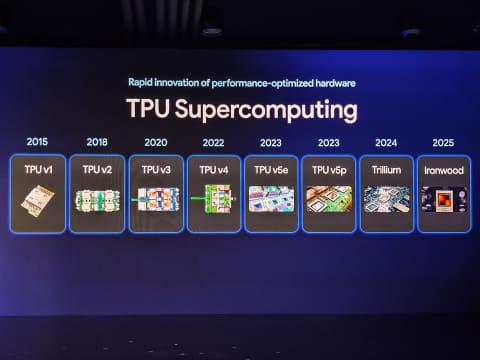

谷歌的TPU是2015年推出的专为AI设计的定制芯片,不对外销售,仅在谷歌云数据中心内部使用。包括谷歌自家服务如Gemini以及谷歌云实例均采用TPU,外部用户需通过租用谷歌云实例才能使用相关计算资源。

近年来,谷歌每年发布新一代TPU,2024年推出代号为“Trillium”的产品,2025年发布“Ironwood”,而此次的TPU 8t和8i则是其后续升级版本。

此前,谷歌以TPUv3、TPUv4、TPUv5等数字命名TPU型号,2024年和2025年的产品则直接采用代号作为产品名。此次第八代TPU则回归数字命名,称为TPU 8。

此外,第八代TPU首次将产品线分为学习专用的TPU 8t和推理专用的TPU 8i。此前第五代TPU曾区分为TPUv5p和TPUv5e两款,均为学习用途;而Ironwood则为学习与推理通用,芯片型号单一。

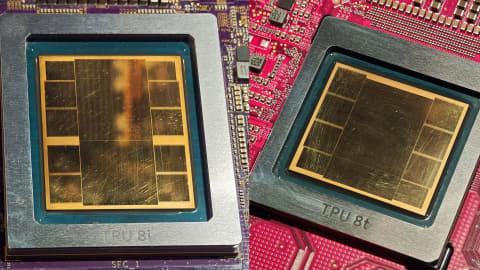

TPU 8t与TPU 8i两款芯片及今年内将推出的Vera Rubin NVL72

TPU 8t针对大规模AI学习设计,单芯片性能达12.6PFLOPS,配备216GB HBM内存。网络带宽较上一代Ironwood的100Gbps提升至400Gbps,支持最多9600个芯片的集群扩展,整体算力从42.5EFLOPS提升至121EFLOPS,提升约2.85倍。

| 规格 | TPU 8t | TPU 8i |

|---|---|---|

| 目标用途 | 大规模学习 | 推理 |

| 特殊芯片功能 | SparseCore+LLM解码引擎 | CAE(集体加速引擎) |

| 片上SRAM | 128MB | 384MB |

| 峰值算力(FP4) | 12.6PFLOPS | 10.1PFLOPS |

| HBM容量 | 216GB | 288GB |

| HBM带宽 | 6528GB/s | 8601GB/s |

| 集群最大规模 | 9600个芯片 | 1152个芯片 |

TPU 8i则更适合推理任务,芯片内置2个TensorCore和1个CAE,配备288GB HBM和384MB片上SRAM缓存,支持高速低延迟内存访问,满足AI代理和智能体对低延迟的需求。其峰值算力为10.1PFLOPS,最大支持1152个芯片集群扩展,集群算力较上一代Ironwood提升近10倍。

谷歌高级副总裁兼AI基础设施技术负责人阿明·瓦达特(Amin Vahdat)指出,低延迟对AI代理和智能体至关重要,TPU 8i正是为此类应用设计。

此外,谷歌计划在2026年内推出基于NVIDIA Vera Rubin NVL72的虚拟机实例“A5X”,进一步丰富AI学习和推理的计算解决方案,持续扩大AI计算资源的规模。