日本Arm公司于25日举办了“Arm Everywhere”活动,正式发布了面向智能代理型AI时代云基础设施的自研量产处理器——Arm AGI CPU。这是该公司35年来首次推出自研量产半导体产品。

新款CPU专为下一代AI基础设施设计,性能相比传统的x86平台,机架性能提升超过两倍。

自研芯片的扩展及背景

此前,日本Arm主要通过IP授权和计算子系统(CSS)提供技术支持。此次发布的Arm AGI CPU为生态系统带来了自研芯片的新选择。

这一举措的背景是智能代理型AI的快速普及,这类AI软件代理能够自主完成任务。在AI系统持续运行的环境下,CPU承担着控制加速器和管理数据传输的核心职责。

为了实现智能代理驱动的应用规模化,需要在有限功耗内提供更强的计算能力。Arm AGI CPU正是为满足此类AI规模化基础设施需求而开发。

Arm AGI CPU的技术规格与性能

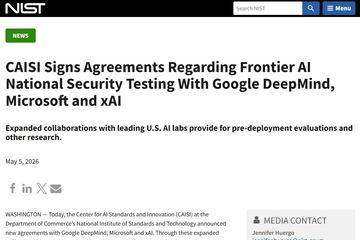

Arm AGI CPU单芯片最多集成136颗Arm Neoverse V3核心,每个核心配备专用2MB L2缓存,最高运行频率达3.7GHz。

内存性能也得到提升,单核心提供6GB/s带宽,延迟低于100纳秒。采用先进的3纳米工艺,实现了高计算密度与能效的平衡。

在连接性方面,支持96条PCIe Gen6通道及CXL 3.0接口,设计热设计功耗(TDP)为300瓦,确保持续高性能输出。

机架级效率与成本优势

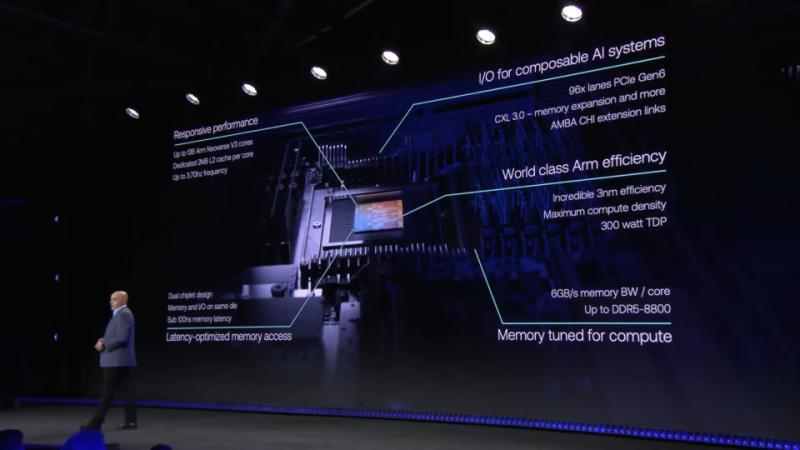

该处理器支持高密度服务器配置,标准空冷36千瓦机架可容纳30个刀片服务器,总计8160核心运行。

通过与Supermicro合作的液冷200千瓦方案,单机架可容纳超过4.5万个核心,性能是最新x86系统的两倍以上。

效率提升直接带来成本节约,预计在AI数据中心容量达到1吉瓦时,可减少高达100亿美元的资本支出。

生态系统支持与应用现状

Meta作为主要合作伙伴参与联合开发,针对其应用平台进行优化。Meta的专用AI加速器“MTIA”将与Arm AGI CPU协同工作,双方合作规划多代产品路线图。

此外,OpenAI、Google、Microsoft等超过50家行业领先企业已表达对该产品的支持,预计将在云计算和网络等多个领域推广应用。

未来展望

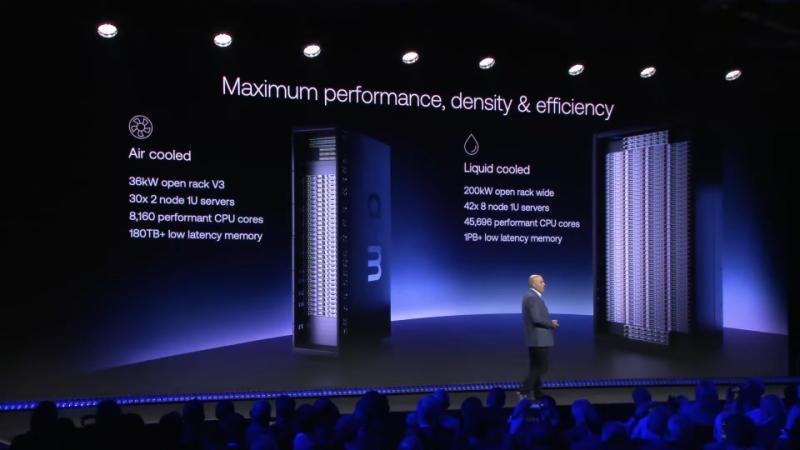

为推动普及,日本Arm将发布符合开放计算项目(Open Compute Project,OCP)标准的参考服务器,并提供设计资产及验证工具,支持整个生态系统的应用。

Arm AGI CPU是日本Arm面向数据中心的首款量产半导体产品,未来将持续推出性能与效率兼备的系列产品。