根据白明实验室的独家报道,备受期待的DeepSeek V4和腾讯姚顺宇领导的新混元模型计划于2026年4月正式发布。DeepSeek V4由梁文峰带领开发,是一款多模态大模型,经过长期打磨,预计在代码能力和长期记忆方面取得显著突破。该模型的发布契合了DeepSeek团队近年来在视觉内容处理和人工智能搜索领域的研究方向。

梁文峰的研究重点是“条件记忆”机制的探索。2026年1月,他发表了题为《通过可扩展查找实现条件记忆》的论文,提出相关理论;2025年12月,他又发布了《mHC:流形约束超连接》论文,进一步优化了底层架构。这些研究旨在解决Transformer模型在记忆和训练稳定性方面的不足。DeepSeek V4不仅具备强大的多模态处理能力,还将深度适配国产芯片,力争成为首个完全依赖国产算力的核心模型。

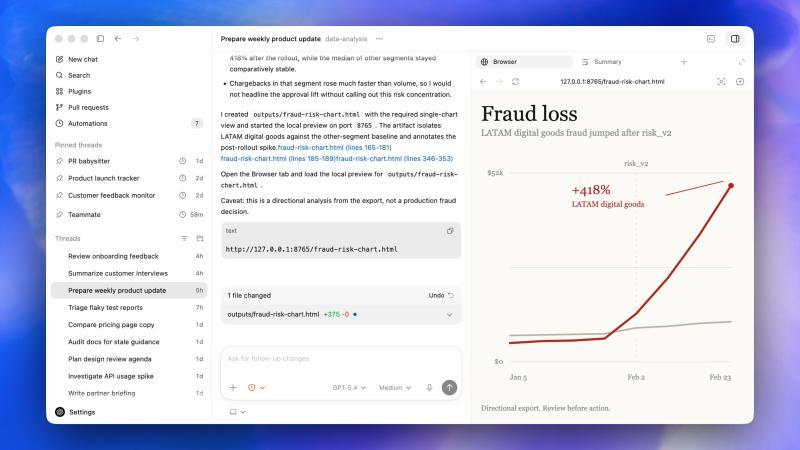

与此同时,姚顺宇的新混元模型也将于4月发布。自2025年12月起,姚顺宇担任腾讯执行委员会首席AI科学家,兼任AI基础设施部门和大语言模型部门负责人。2026年2月,他发表了名为CL-bench的论文,提出了针对“上下文学习”的新评测基准,强调长上下文和Agent可用性的重要性。相关信息显示,姚顺宇的新模型参数规模约为30亿,团队从一开始就注重模型的实际应用,而非单纯追求参数规模竞争。

这两款模型的发布引发了市场的高度关注,彰显了中国人工智能领域的快速发展。无论是DeepSeek V4的长期记忆能力,还是腾讯混元模型在实际任务评测中的进展,都在积极探索未来大模型如何更好地适应生产环境。