Stable Diffusion 3.5 是 Stability AI 推出的新一代文生图模型系列,在保持开放与可商用的前提下,大幅提升画质、提示词理解能力和自定义空间,适合科研、创作者、开发者与企业搭建各类 AI 图像应用。

产品详细介绍

Stable Diffusion 3.5 是目前 Stable Diffusion 家族中最强大的开放模型系列,本次开放包含多个不同规模与性能取向的版本,方便用户根据硬件条件与业务需求灵活选择:

-

Stable Diffusion 3.5 Large

- 约 81 亿参数,是本系列的旗舰基础模型。

- 在 画面质量、细节表现、构图稳定性 和 提示词遵从度(prompt adherence) 上表现突出。

- 适合 专业创作、商业设计、广告、电商、影视前期概念设计 等高要求场景。

- 原生支持约 1 兆像素级别分辨率(如 1024×1024 级别),兼顾清晰度与生成速度。

-

Stable Diffusion 3.5 Large Turbo

- 基于 Large 蒸馏而来,保留大部分画质与理解能力,同时显著提升速度。

- 仅需 约 4 步推理 即可生成高质量图像,相比 Large 更加快速。

- 适合 实时交互、A/B 迭代、批量生成、在线应用 等对延迟敏感的场景。

-

Stable Diffusion 3.5 Medium

- 约 25 亿参数,采用改进的 MMDiT-X 架构 与训练方法。

- 专门为 消费级硬件“开箱即用” 设计,在普通游戏显卡或中端 GPU 上即可运行。

- 支持 0.25–2 兆像素 范围内的多分辨率生成,在质量与资源占用之间取得平衡。

- 更易于 微调、LoRA 训练、风格定制,适合个人创作者、小团队和初创公司。

开放许可与商用友好

- 所有 Stable Diffusion 3.5 模型在 Stability AI Community License 下发布。

- 在大多数场景下可 免费用于商业与非商业用途,适合:

- 搭建自有 AI 绘画网站或应用

- 为客户提供定制插画、设计服务

- 在生产流程中集成 AI 生成素材

- 官方鼓励围绕整个生态进行 分发与变现:包括微调模型、LoRA、推理优化、插件、应用和艺术作品等。

可定制性与技术特点

Stable Diffusion 3.5 在设计时优先考虑了 可定制性与下游开发灵活度:

- 在 Transformer 模块中引入 Query-Key Normalization(QK Norm),提升训练稳定性,方便后续微调与二次开发。

- 模型在同一提示词、不同随机种子下会产生 更丰富的变化,有利于保留更广泛的知识与风格空间。

- 这种设计意味着:

- 对于 具体、清晰的提示词,模型能给出高质量、风格多样的结果;

- 对于 模糊或过于简短的提示词,输出可能更不确定,审美水平也会有一定波动。

Medium 版本在架构与训练协议上做了额外优化,以提升:

- 图像整体质量与细节一致性;

- 多元素场景的 语义连贯性;

- 不同分辨率下的 稳定生成能力。

适用人群与典型场景

- 科研人员:可在开源框架下进行模型研究、架构改进与新任务探索。

- 独立创作者 / 插画师 / 设计师:快速生成草图、成品插画、概念设计、分镜等。

- 开发者与初创公司:搭建 AI 绘画网站、设计工具、游戏内容生成平台等。

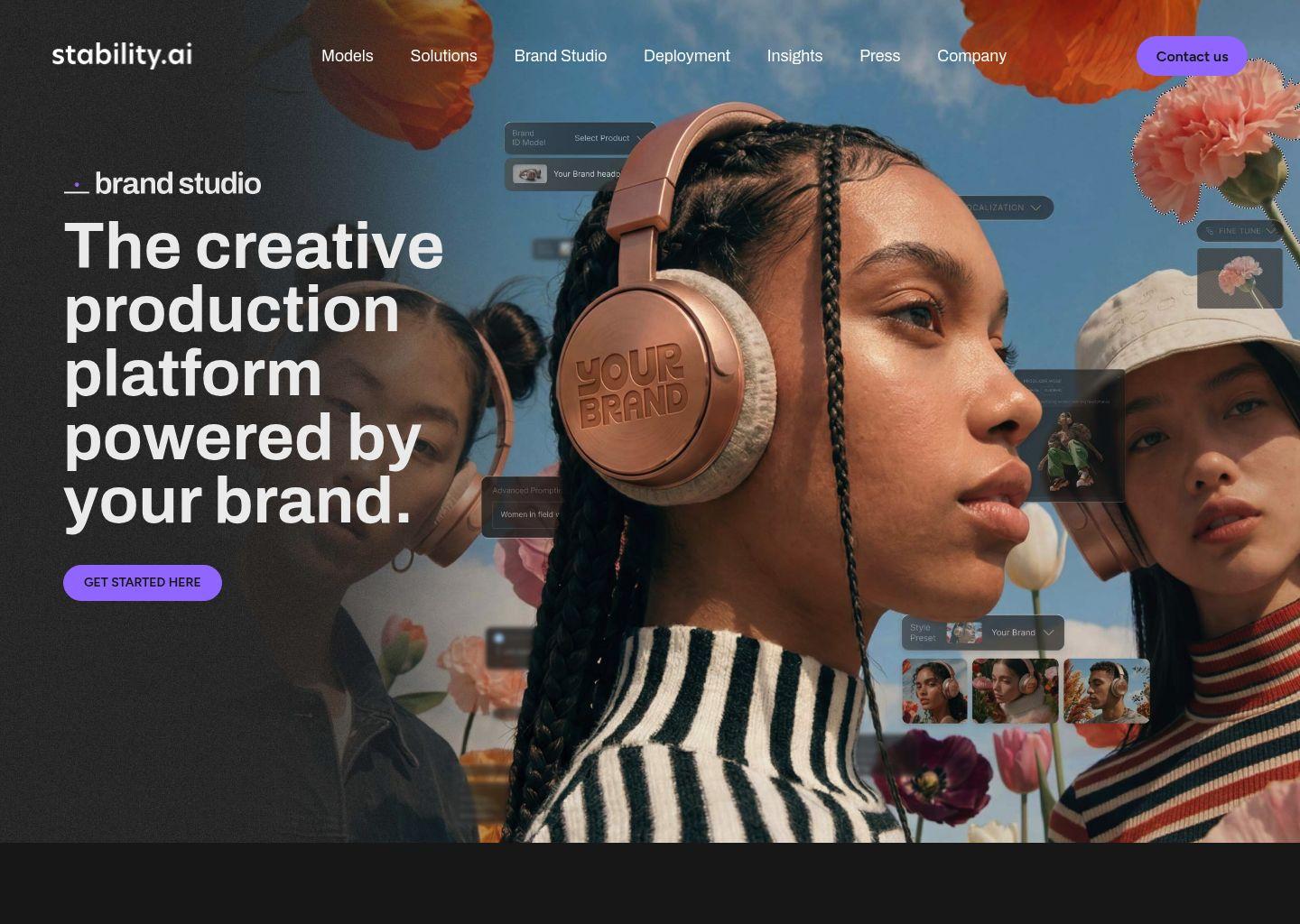

- 企业用户:用于营销物料、电商图、品牌视觉、内部创意辅助等。

简单使用教程

下面以常见的开源生态为例,说明如何快速上手 Stable Diffusion 3.5。

一、获取模型与推理代码

-

从 Hugging Face 下载模型

- 访问 Hugging Face,搜索:

Stable Diffusion 3.5或stabilityai官方仓库。 - 根据需求选择:

stable-diffusion-3.5-largestable-diffusion-3.5-large-turbostable-diffusion-3.5-medium

- 在模型页面中阅读许可说明,确认符合你的使用场景。

- 访问 Hugging Face,搜索:

-

从 GitHub 获取推理代码

- 前往 Stability AI 官方 GitHub 仓库,找到对应的 推理示例与脚本。

- 克隆仓库后,按照 README 安装依赖(通常包括 Python、PyTorch、diffusers 等)。

二、环境准备与基础运行

-

硬件建议

- Large / Large Turbo:建议使用 高显存 GPU(如 16GB 及以上),适合工作站或云服务器。

- Medium:在 消费级显卡(如 8–12GB 显存) 上也能较为顺畅地运行。

-

安装依赖(示意步骤)

- 创建 Python 虚拟环境。

- 安装 PyTorch(根据你的 CUDA 版本选择)。

- 安装 Hugging Face diffusers、transformers、accelerate 等库。

- 运行官方 GitHub 中的示例脚本,确认能成功生成一张测试图片。

-

基础生图流程

- 选择模型(Large / Large Turbo / Medium)。

- 设置提示词(prompt),例如:

- “a cinematic portrait of a woman in neon cyberpunk city, 4k, highly detailed”

- 设置分辨率(如 1024×1024)、步数(steps)、随机种子(seed)等参数。

- 运行推理脚本,等待生成完成并保存图片。

三、提升效果的小技巧

-

编写更具体的提示词

- 尽量明确:主体、场景、风格、光线、构图、细节等。

- 例如:

- 不建议:

a landscape - 更好:

a wide-angle view of a misty mountain landscape at sunrise, soft golden light, detailed clouds, 4k

- 不建议:

-

利用随机种子探索多样性

- 同一提示词下更换 seed,可获得风格与构图不同的多张图。

- 适合在确定方向前快速浏览多种创意方案。

-

根据场景选择模型版本

- 需要最高画质与复杂场景:优先用 3.5 Large。

- 需要高并发或实时响应:优先用 3.5 Large Turbo。

- 硬件有限或需要大量微调实验:优先用 3.5 Medium。

-

微调与 LoRA(进阶)

- 若你希望模型更贴合某种风格或品牌视觉,可基于 3.5 系列进行:

- 全量微调(适合科研或企业级场景);

- LoRA / DreamBooth 等轻量微调(适合个人与小团队)。

- 微调后可在保持基础能力的前提下,更好地生成特定风格或特定角色。

- 若你希望模型更贴合某种风格或品牌视觉,可基于 3.5 系列进行:

FAQ 常见问题

Q1:Stable Diffusion 3.5 是否可以免费商用?

A:3.5 系列在 Stability AI Community License 下发布,在大多数场景下可免费用于商业与非商业用途。但不同业务形态可能有细节差异,建议在正式商用前仔细阅读官方许可条款,必要时咨询法律顾问。

Q2:我应该选 Large、Large Turbo 还是 Medium?

A:

- 追求最高画质与复杂场景表现:选 Large。

- 需要更快生成速度、适合在线服务或交互应用:选 Large Turbo。

- 硬件资源有限、希望便捷微调和本地部署:选 Medium。

Q3:消费级显卡能跑得动吗?

A:可以。3.5 Medium 专门针对消费级硬件优化,在 8–12GB 显存的显卡上即可运行。Large 与 Large Turbo 更适合高显存 GPU 或云端部署。

Q4:为什么同一个提示词每次生成的图都不太一样?

A:3.5 系列刻意保留了更大的风格与知识多样性,同一提示词在不同随机种子下会产生更多变化。这有利于创意探索,但如果你需要可复现结果,可以固定 seed,并尽量使用更具体的提示词。

Q5:如何获取官方最新版本与更新?

A:请关注 Stability AI 官方网站、Hugging Face 官方模型页以及 GitHub 仓库。3.5 Medium 已在 10 月 29 日更新发布,后续改进与新版本也会在这些渠道同步。