随着AI模型日益商品化,众多初创企业竞相打造覆盖其上的软件层。其中一个有趣的参与者是Osaurus,这是一款专为苹果设备设计的开源大型语言模型(LLM)服务器,用户可以在本地或云端不同的AI模型间自由切换,同时将文件和工具保留在自己的硬件上。

Osaurus的诞生源于一个名为Dinoki的桌面AI助手项目,Osaurus联合创始人Terence Pae将其形容为“AI版的Clippy”。Dinoki的用户曾质疑为何还需购买应用时,还要为AI处理请求和生成响应支付代币费用,这促使Pae深入思考本地运行AI的可能性。

“这就是Osaurus的起点,”曾任职于特斯拉和Netflix的软件工程师Pae在接受TechCrunch采访时表示。他解释说,目标是让AI助手能在Mac本地运行,用户可以浏览文件、访问浏览器和系统配置,这使Osaurus成为个人AI助手的理想选择。

Pae将该项目作为开源工程公开开发,持续添加功能并修复漏洞。

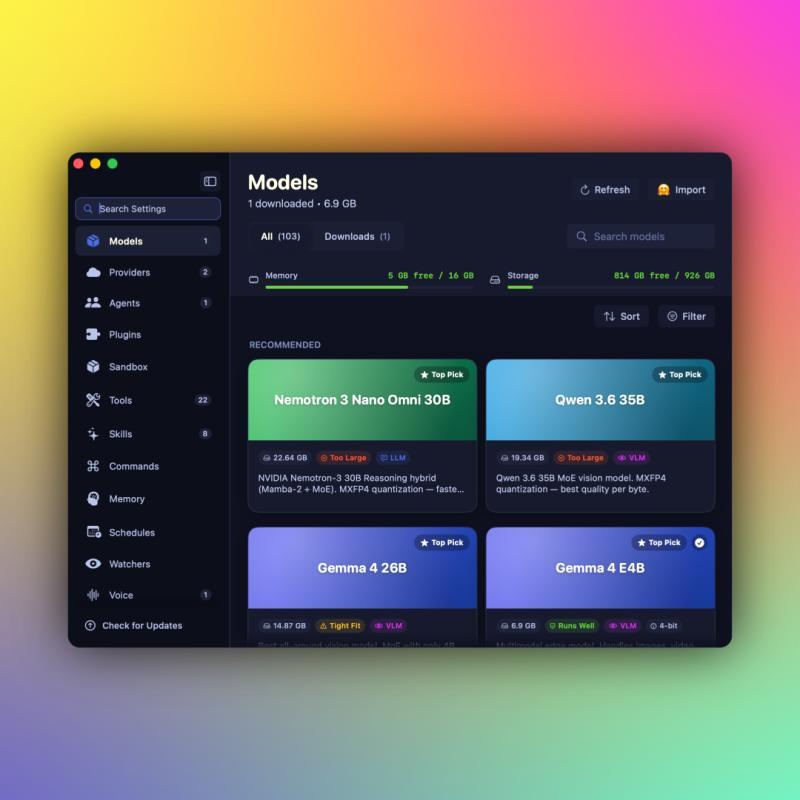

如今,Osaurus可以灵活连接本地托管的AI模型或云端服务商如OpenAI和Anthropic。用户可自由选择所用AI模型,同时将模型的记忆、文件和工具等保留在自己的硬件上。

由于不同AI模型各有优势,该系统允许用户根据需求切换最合适的模型。

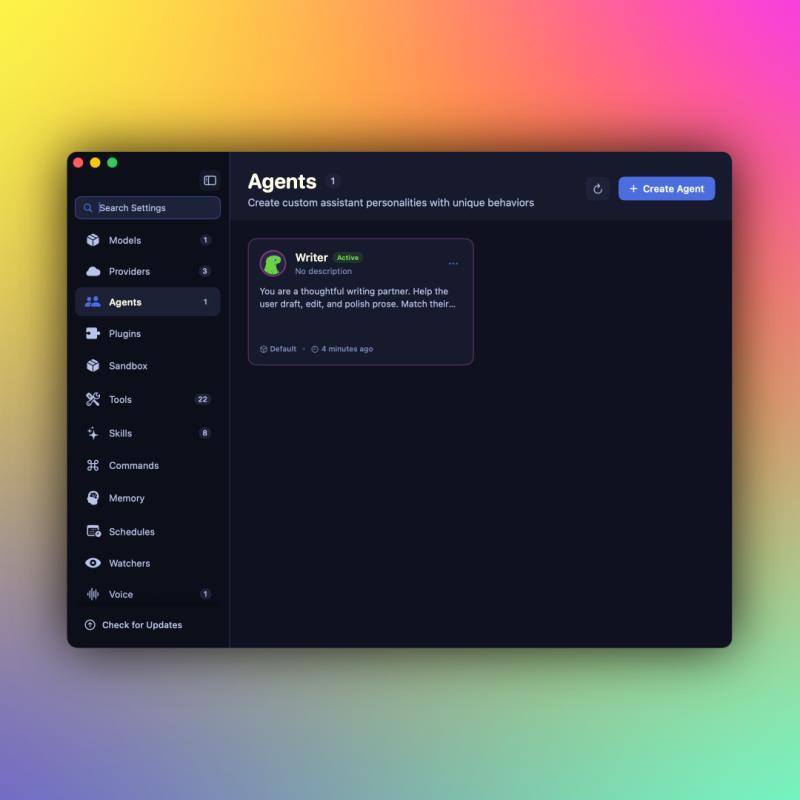

这种架构使Osaurus成为所谓的“控制层”,通过单一界面连接不同的AI模型、工具和工作流程,类似于OpenClaw或Hermes等工具。但不同的是,这些工具多面向熟悉终端操作的开发者,且有时存在安全隐患。

而Osaurus提供了易用的界面,普通用户也能轻松使用,并通过硬件隔离的虚拟沙箱运行,限制AI的权限范围,保障电脑和数据安全。

当然,在本地运行AI模型仍处于初期阶段,因为它对资源和硬件要求较高。运行本地模型至少需要64GB内存,运行更大型模型如DeepSeek v4则建议配备约128GB内存。

Pae相信本地AI的硬件需求会逐渐降低。

“我看好它的潜力,因为本地AI的每瓦智能度(intelligence per wattage)正在显著提升。去年本地AI还只能勉强完成句子,而现在它能运行工具、写代码、访问浏览器,甚至在亚马逊下单……它正变得越来越强大。”

目前,Osaurus支持MiniMax M2.5、Gemma 4、Qwen3.6、GPT-OSS、Llama、DeepSeek V4等多种模型。它还支持苹果设备上的基础模型、Liquid AI的LFM系列本地模型,以及云端的OpenAI、Anthropic、Gemini、xAI/Grok、Venice AI、OpenRouter、Ollama和LM Studio。

作为完整的模型上下文协议(MCP)服务器,Osaurus允许任何兼容MCP的客户端访问用户的工具。此外,它内置20多个原生插件,涵盖邮件、日历、视觉、macOS使用、XLSX、PPTX、浏览器、音乐、Git、文件系统、搜索、抓取等功能。

最近,Osaurus还新增了语音功能。

自项目上线近一年以来,Osaurus已被下载超过11.2万次。它与Ollama、Msty、LM Studio等本地模型运行工具竞争,但凭借差异化功能和更友好的用户体验,吸引了非开发者用户。

目前,Osaurus的创始团队(包括联合创始人Sam Yoo)正在纽约的创业加速器Alliance参与项目。他们也在考虑将Osaurus推广至法律、医疗等行业,利用本地运行大型语言模型解决隐私问题。

随着本地AI模型能力提升,团队认为这将减少对AI数据中心的依赖。

“我们看到AI领域爆发式增长,云端AI提供商不得不依赖数据中心和基础设施扩展,但人们尚未真正认识到本地AI的价值,”Pae说。“用户可以在本地部署Mac Studio,显著降低能耗,同时保有云端能力,不必依赖数据中心运行AI。”