产品详细介绍

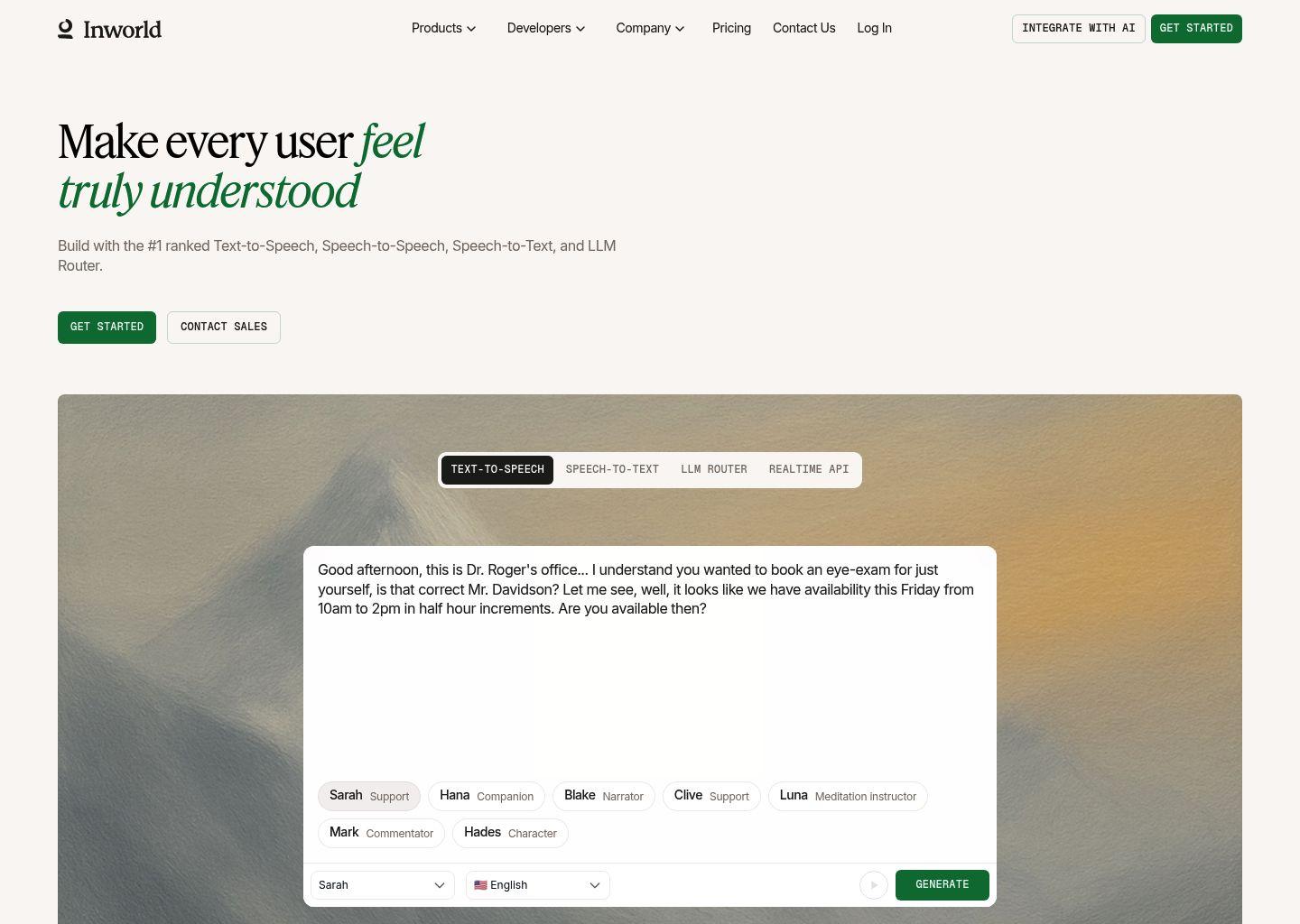

Inworld AI 是一款专注于“实时语音交互”的 AI 智能体平台,核心能力是为游戏、应用、虚拟角色和各类互动场景提供自然、低延迟、可扩展的语音 AI 体验。平台以顶级 TTS(文本转语音)和智能体编排为基础,帮助开发者快速构建具有情感表达、个性设定和多轮对话能力的虚拟角色与语音助手。

核心特性概览:

-

顶级 TTS 与超低延迟

- 官方宣称为“#1 ranked TTS”,在自然度、清晰度和情感表现上处于行业领先水平。

- 端到端语音响应延迟可低于 200ms,适合对实时性要求极高的场景,如游戏语音互动、语音陪伴、实时教学等。

-

语音克隆与多角色声音

- 支持语音克隆,可基于样本声音生成高度相似的 AI 声线,用于品牌角色、虚拟主播或 IP 角色统一声音形象。

- 可配置多种音色、语速、语调和情绪,让同一角色在不同情境下呈现不同的表达方式。

-

大规模实时智能体能力

- 面向“DAU 级”应用设计,支持数十万到百万级用户的并发交互。

- 已有应用在 19 天内达到 100 万日活(1M DAUs),验证了平台在高并发场景下的稳定性与可扩展性。

- 适用于语音优先(voice-first)的伴侣类应用、游戏 NPC、虚拟客服、语言学习教练等场景。

-

情感与关系构建导向的交互设计

- 不仅提供问答式对话,更强调“持续、个人化、情感化”的互动体验。

- 角色可以进行安抚、鼓励、共情式回应,例如在用户表达压力和焦虑时,先引导深呼吸,再逐步拆解问题。

- 支持多语言交互和语言学习场景,如在法语练习中对发音进行细致点评和纠正,帮助用户提升口语能力。

-

多语言与多场景支持

- 支持多种语言的理解与生成,可用于跨语种对话、语言教学、国际化产品。

- 适配移动应用、网页、游戏引擎、VR/AR 等多种终端形态,便于集成到现有产品中。

-

成本优势与商业可行性

- 官方强调“25x 更低成本”,在大规模部署时可显著降低语音交互成本。

- 适合需要长时长对话、持续陪伴和高频交互的产品形态,如 AI 伴侣、语音社交、互动娱乐等。

-

开发者友好与生态支持

- 提供 API 与 SDK,方便接入现有后端与前端。

- 支持对角色设定、对话风格、记忆与个性进行配置,开发者可以精细控制角色行为。

- 面向游戏工作室、应用开发者、内容创作者等不同角色提供解决方案。

通过 Inworld AI,开发者可以快速构建具备“声音 + 个性 + 情感 + 记忆”的智能体,实现从简单语音播报升级到真正“会说话、会共情、会陪伴”的虚拟角色体验。

简单使用教程

以下为基于典型使用流程整理的简明上手步骤,具体接口与控制台操作以 Inworld 官方文档为准:

步骤一:注册账号并创建项目

- 访问 Inworld AI 官网,注册或登录开发者账号。

- 在控制台中新建项目,选择应用类型(如游戏、移动应用、语音伴侣、语言学习等)。

- 为项目命名,并确认基础配置(地区、语言等)。

步骤二:创建与配置 AI 角色

- 在项目中创建一个或多个“角色/智能体”:

- 设定角色名称、背景故事、性格特征(如温柔、幽默、专业等)。

- 定义角色的使用场景,例如情感陪伴、语言教练、游戏 NPC、客服助手等。

- 配置对话风格与行为准则:

- 指定角色说话方式(正式/轻松、长回答/短回答)。

- 设置角色应避免的话题或敏感内容。

- 如需语音克隆:

- 按平台要求上传或录制语音样本。

- 等待系统训练并生成对应 AI 声线。

- 在角色配置中选择该克隆声音作为默认音色。

步骤三:设置语音与多语言参数

- 在语音设置中选择:

- 目标语言(如英语、法语、中文等)。

- 音色、语速、语调和情绪强度。

- 如用于语言学习:

- 开启或配置“纠错/点评”模式,让角色在对话中对发音、语法进行反馈。

- 设定纠错频率与语气(鼓励式、严格式等)。

步骤四:集成到应用或游戏

- 获取 API Key 或项目凭证:

- 在控制台中生成访问密钥,并妥善保管。

- 选择合适的集成方式:

- Web/移动应用:使用官方提供的 REST API 或前端 SDK,将文本输入、语音输入与 TTS 输出接入到你的 UI。

- 游戏引擎(如 Unity/Unreal):使用对应插件或 SDK,将角色语音与游戏角色动画、表情联动。

- 语音设备/IoT:通过后端服务调用 Inworld API,再将音频流推送到终端设备播放。

- 实现基本交互流程:

- 将用户语音转换为文本(如使用 ASR 服务),发送给 Inworld 智能体。

- 接收智能体返回的文本与音频(TTS),在前端播放音频并展示文本。

- 根据需要,将角色的情绪、意图等信息与界面表现(表情、动作)联动。

步骤五:优化对话体验

- 通过日志与分析查看用户对话数据:

- 观察常见问题、用户停留时长、对话中断点等。

- 调整角色设定与提示词:

- 优化角色的性格描述和行为规则,使其更贴合目标用户。

- 针对情绪场景(如用户表达压力、焦虑)增加更细致的安抚与引导话术。

- 调整语音参数:

- 根据用户反馈微调语速、语调和情绪强度,让声音更自然、更易理解。

步骤六:扩展场景与规模

- 当产品验证通过后,可逐步扩展:

- 增加更多角色(如不同性格的陪伴者、不同科目的教学教练)。

- 为不同语言市场配置本地化角色与声音。

- 利用 Inworld 的高并发与低成本优势,将应用扩展到更大用户规模(如百万级 DAU)。

- 持续根据用户行为数据迭代角色设定与对话逻辑,打造更具情感连接和长期陪伴价值的语音 AI 体验。