产品详细介绍

DeepSeek(深度求索)成立于 2023 年,专注于世界领先的通用人工智能底层模型与技术研发,聚焦解决人工智能领域的前沿性与高难度问题。依托自研训练框架、自建智算集群以及万卡级算力资源,DeepSeek 在较短时间内完成了多款大模型的训练与开源,在公开评测与真实场景泛化能力方面均表现突出。

核心产品与技术特点包括:

-

DeepSeek-LLM 通用大语言模型

- 面向通用自然语言理解与生成场景,如问答、写作、翻译、总结、知识检索等。

- 采用百亿级参数规模,具备较强的语言理解、推理与多轮对话能力。

- 在多项公开评测榜单上取得优异成绩,对真实样本外任务也有良好泛化表现。

-

DeepSeek-Coder 代码大模型

- 专门针对编程与软件开发场景优化,可用于代码补全、自动生成、重构与调试辅助。

- 支持多种主流编程语言,适合集成到 IDE、代码审查工具和自动化开发流水线中。

- 能理解自然语言描述的需求,并生成相应代码片段或给出修改建议。

-

DeepSeek-MoE 稀疏专家大模型

- 2024 年 1 月率先开源的国内首个 MoE(Mixture of Experts)大模型。

- 通过专家路由机制,在保持高性能的同时显著提升推理效率与可扩展性。

- 适合在算力成本敏感、需要高吞吐的业务场景中部署使用。

-

自研训练框架与自建智算集群

- 采用自研分布式训练与推理框架,针对大规模参数模型进行深度优化。

- 自建万卡级智算集群,为模型预训练、微调和持续迭代提供稳定算力基础。

- 支持多种精度与并行策略,兼顾训练速度、成本与模型效果。

-

开放生态与 API 能力

- 多款模型已开源,便于研究者与开发者进行二次开发与定制化微调。

- 提供在线对话入口,用户可直接与 DeepSeek AI 进行自然语言交互。

- 提供标准化 API 接口,方便集成到网站、应用、企业内部系统和各类智能产品中。

通过上述产品矩阵与技术能力,DeepSeek 致力于为科研机构、企业开发者和个人用户提供高性能、可扩展、可定制的通用人工智能基础设施,覆盖从文本创作、知识问答到代码生成、智能助手等多种应用场景。

简单使用教程

以下为基于 DeepSeek 在线对话与 API 接入的简明使用步骤示例(具体以官网最新文档为准):

一、在线对话快速体验

-

访问官网

打开浏览器,进入 DeepSeek 官方网站:https://deepseek.com。 -

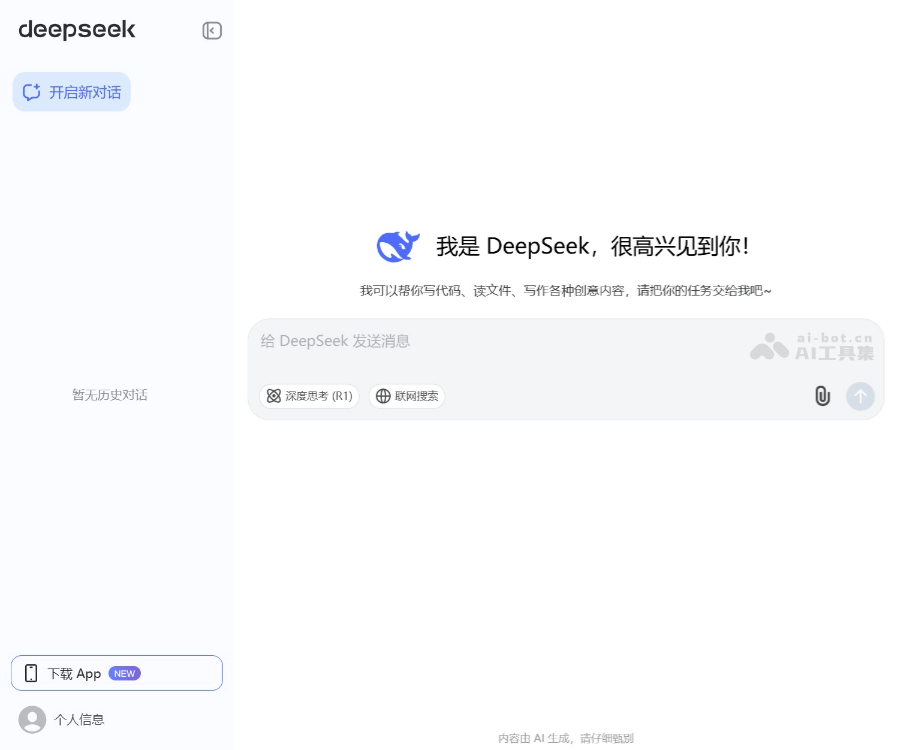

进入对话界面

在首页找到“和 DeepSeek AI 对话”或类似入口,点击进入在线对话页面。 -

输入问题或需求

在对话输入框中,用自然语言描述你的问题或任务,例如:- “帮我写一段产品介绍文案。”

- “解释一下 MoE 大模型的基本原理。”

- “根据下面需求生成一段 Python 代码。”

-

查看与调整回答

- 阅读模型返回的答案,如有不满足之处,可继续追问或补充约束条件。

- 通过多轮对话逐步细化需求,获得更贴合场景的输出。

二、API 接入基础流程

-

注册账号并获取密钥

- 在 DeepSeek 官网注册或登录账号。

- 进入“开发者”或“API”相关页面,按照指引创建应用并获取 API Key(密钥)。

-

阅读官方文档

- 在文档中心查看“快速开始”“API 参考”等章节。

- 了解可用模型(如 DeepSeek-LLM、DeepSeek-Coder、DeepSeek-MoE)、请求地址、参数格式和返回结构。

-

发起首次调用(示例思路)

- 在后端或本地环境中选择常用语言(如 Python、JavaScript、Java 等)。

- 在 HTTP 请求头中加入授权信息(通常为

Authorization: Bearer <API_KEY>)。 - 在请求体中指定:

- 使用的模型名称;

- 用户输入内容(prompt);

- 可选参数(如温度、最大生成长度等)。

-

解析返回结果并集成到业务中

- 从响应中提取模型生成的文本或代码内容。

- 将结果展示在前端页面、聊天窗口,或用于后续业务逻辑处理。

- 根据业务需求增加日志记录、错误重试和限流等机制。

三、典型应用场景建议

-

文本与知识类应用

- 智能客服、知识问答、文档总结、报告生成、营销文案撰写等,优先考虑使用 DeepSeek-LLM。

-

代码与开发辅助

- 代码自动补全、单元测试生成、代码审查建议、自然语言转代码等,可集成 DeepSeek-Coder。

-

高并发与成本敏感场景

- 对吞吐量和推理成本要求较高的业务,可评估采用 DeepSeek-MoE 模型,并结合官方推荐的部署与调用策略。

在实际使用中,建议结合官网最新的模型版本说明、配额与计费策略、示例代码和最佳实践文档,以获得更稳定、高效的集成体验。