DeepSeek(深度求索)是一个面向开发者与企业的通用人工智能大模型平台,聚焦底层模型与核心技术创新,提供高性能、可开源、易接入的 AI 能力,覆盖自然语言理解与生成、代码智能、复杂推理等多种场景。

产品详细介绍

DeepSeek(深度求索)成立于 2023 年,目标是攻克通用人工智能(AGI)方向的前沿性难题,打造世界领先的底层大模型与技术栈。依托自研训练框架、自建智算集群以及万卡级算力资源,DeepSeek 在较短时间内完成了多款百亿级参数模型的训练与开源,为开发者和企业提供高质量的基础模型能力。

核心产品与模型体系

-

DeepSeek-LLM 通用大语言模型

- 面向通用自然语言理解与生成任务。

- 支持多轮对话、内容创作、信息抽取、翻译与总结等。

- 适合问答助手、知识库检索增强、内容生产工具等应用场景。

-

DeepSeek-Coder 代码大模型

- 专注编程语言理解与代码生成。

- 支持多种主流编程语言(如 Python、Java、C/C++、JavaScript 等)的代码补全、重构、注释生成与错误定位。

- 可用于智能 IDE 插件、自动化脚本生成、代码审查辅助等。

-

DeepSeek-MoE 混合专家(MoE)大模型

- 2024 年 1 月率先开源的国内首个 MoE 大模型。

- 通过混合专家架构,在保证模型能力的同时显著提升推理效率与性价比。

- 适合对吞吐量和成本敏感的大规模在线服务场景。

技术与基础设施优势

- 自研训练框架:针对大规模分布式训练深度优化,提升训练效率与稳定性。

- 自建智算集群:万卡级 GPU/AI 加速集群,支持百亿级参数模型的快速迭代。

- 高质量数据与评测体系:在公开评测榜单和真实样本外泛化测试中,多项指标超越同级别模型。

- 开源友好:多个模型已开源,便于社区二次开发、微调与部署。

典型应用场景

- 智能对话助手与企业客服机器人

- 文档写作、营销文案、报告与摘要生成

- 代码自动补全、单元测试生成、代码审查辅助

- 教育辅导、知识问答与专业领域咨询

- 内部知识库问答、流程自动化与办公效率工具

简单使用教程

以下为基于官网和常见大模型服务形态整理的通用使用步骤,实际以 DeepSeek 官方文档为准。

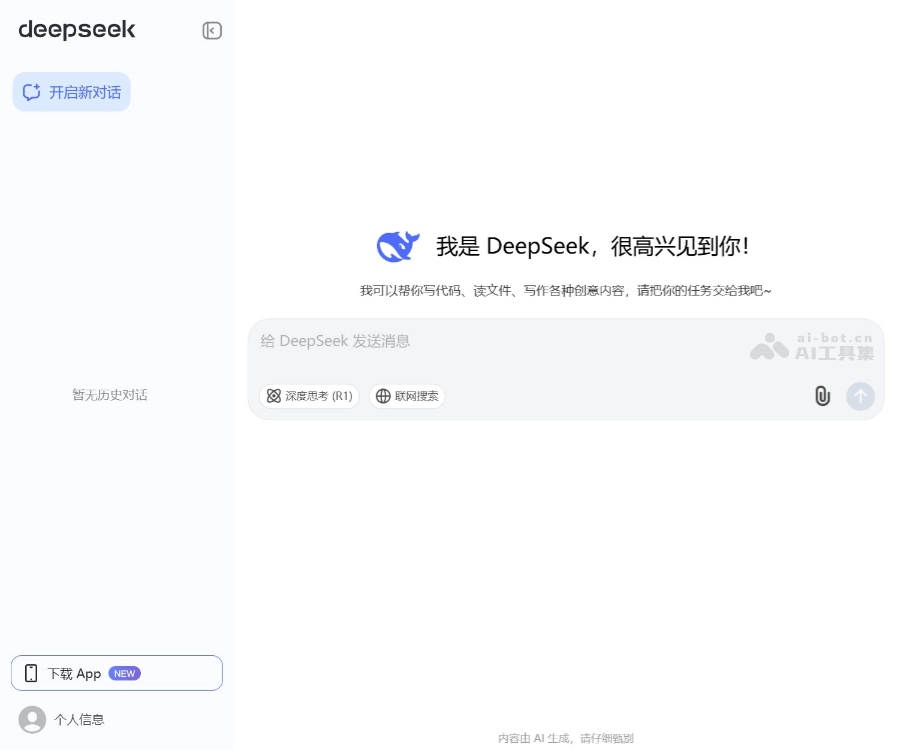

一、快速开始:在线对话体验

-

访问官网

打开浏览器,进入 DeepSeek 官网(https://deepseek.com)。 -

注册或登录账号

- 使用邮箱或手机号注册账号。

- 已有账号则直接登录。

-

进入对话界面

- 在首页选择“和 DeepSeek AI 对话”或类似入口。

- 进入聊天页面后即可输入自然语言问题,与模型进行多轮对话。

-

基础使用技巧

- 提问时尽量描述清晰:说明背景、目标和约束条件。

- 对代码、文档类问题,可直接粘贴片段并说明希望模型完成的任务(如“重构”“找 bug”“写注释”)。

二、API 接入(面向开发者)

-

获取 API Key

- 登录官网账号,在“开发者中心”或“API 管理”页面创建应用。

- 生成并妥善保存 API Key,用于后续调用鉴权。

-

阅读官方文档

- 在官网进入“文档”或“API 文档”栏目。

- 重点查看:鉴权方式、基础请求示例、模型列表、限流与计费说明。

-

发起首次调用(示意流程)

- 选择合适的模型(如通用对话模型或代码模型)。

- 在后端服务中配置 HTTP 请求:

- 设置请求地址(官方提供的 API Endpoint)。

- 在请求头中加入 Authorization(携带 API Key)。

- 在请求体中指定模型名称、用户输入内容、温度等参数。

- 发送请求并解析返回的 JSON,获取模型生成的文本或代码。

-

集成到业务系统

- 将 API 封装为内部服务,供 Web、App、企业内部系统调用。

- 根据业务场景设置对话上下文、角色提示(prompt)和安全过滤逻辑。

- 对高并发场景,结合缓存与队列机制,控制调用频率与成本。

三、模型微调与本地部署(针对开源模型)

-

获取开源模型

- 在 DeepSeek 官网或官方开源仓库(如 GitHub、开源模型平台)中找到对应模型(如 DeepSeek-LLM、DeepSeek-Coder、DeepSeek-MoE)。

- 按照说明下载模型权重与配置文件。

-

准备运行环境

- 配置 Python、深度学习框架(如 PyTorch)及推理依赖。

- 准备 GPU 环境或使用云端算力服务。

-

加载与推理

- 使用官方或社区提供的示例脚本加载模型。

- 输入文本或代码片段,调用推理接口获取输出结果。

-

微调与定制(如有需要)

- 准备领域数据集(如行业问答、企业文档、特定代码库)。

- 按官方教程进行指令微调或 LoRA 等轻量化微调。

- 在测试集上验证效果后,再部署到生产环境。

FAQ 常见问题

1. DeepSeek 提供哪些类型的大模型?

目前已公开的主要包括:通用大语言模型 DeepSeek-LLM、代码大模型 DeepSeek-Coder,以及国内首个开源 MoE 大模型 DeepSeek-MoE,覆盖通用对话、内容生成、代码智能等场景。

2. 是否支持开源和本地部署?

是。DeepSeek 已开源多款百亿级参数模型,用户可在官方指定的开源平台下载权重与代码,在自有环境中部署和微调,具体以官方开源协议和文档为准。

3. 如何接入 DeepSeek 的 API?

在官网注册并登录后,前往开发者或 API 管理页面申请 API Key,按照官方 API 文档配置请求地址、鉴权方式和参数,即可在服务器或应用中调用模型能力。

4. DeepSeek 的模型在效果上有什么特点?

根据公开评测榜单和真实样本外的泛化测试结果,DeepSeek 系列模型在多项指标上优于同级别模型,兼顾语言理解、生成质量与推理能力,并在代码任务上有较强表现。

5. 适合哪些企业或个人使用?

- 需要构建智能客服、知识问答、办公助手的企业;

- 需要代码自动化、智能开发辅助的技术团队与个人开发者;

- 需要在本地或私有云中部署大模型的机构;

- 对前沿通用人工智能技术和开源大模型感兴趣的研究者与爱好者。