产品详细介绍

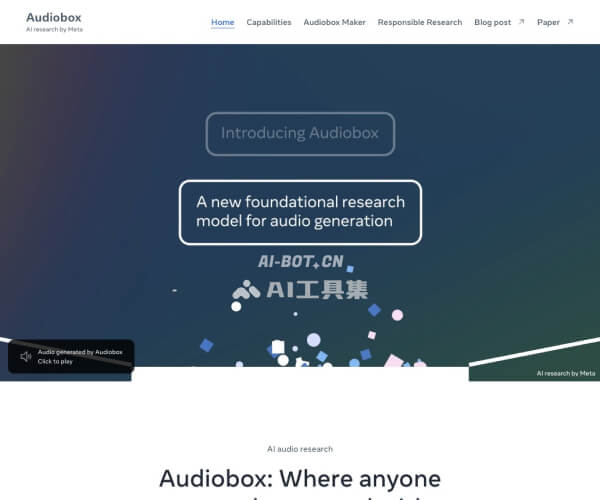

Audiobox 是 Meta AI 团队推出的语音与音频生成研究项目,旨在通过大规模深度学习模型,实现自然、可控且多风格的声音与音效合成能力。该项目曾以在线 Demo 的形式对公众开放,用于展示前沿的 AI 语音与音频生成技术。

根据当前页面信息显示:自 2026 年 2 月起,Audiobox 在线 Demo 已不再对外提供访问。Meta 会定期评估和更新公开 Demo 组合,以便集中资源展示更具代表性和影响力的研究成果。因此,Audiobox 目前更偏向于研究项目与技术展示,而非面向终端用户的正式产品服务。

从已公开的信息与 Meta 以往的研究方向推测,Audiobox 的核心能力主要包括:

- 文本转语音(TTS)

- 将输入的文本转换为自然流畅的语音输出。

- 支持多种声音风格与语气,适用于旁白、解说、虚拟角色配音等场景。

- 声音克隆与声音风格迁移

- 通过少量语音样本,学习特定说话人的音色特征。

- 在合成语音时复现或接近该音色,实现“声音定制化”。

- 环境音效与音频生成

- 根据文本描述或参数设定生成环境音效、背景声等。

- 可用于游戏、虚拟世界、多媒体内容的音效设计与快速原型制作。

- 多模态与可控生成

- 结合文本、标签或其他控制参数,对语速、情绪、语气、音色等进行调节。

- 为创作者提供更灵活的声音设计空间。

目前 Audiobox Demo 已下线,意味着普通用户无法再通过原有网址直接体验这些功能。但其背后的模型、算法和研究成果,仍可能以论文、技术报告、后续产品或新 Demo 的形式继续对外呈现。若你对该技术方向感兴趣,可通过 Meta AI 官方研究网站持续关注最新进展。

简单使用教程

由于 Audiobox 在线 Demo 已正式下线,以下教程以“如何继续跟进与间接使用 Audiobox 相关技术”为主,帮助你找到替代路径和后续资源。

一、了解最新研究与 Demo

-

访问 Meta AI 研究官网

- 打开浏览器,访问:ai.meta.com/research

- 在网站中搜索关键词:"Audiobox"、"audio generation"、"speech synthesis" 等。

- 查看相关论文、博客文章、技术报告和新发布的 Demo 链接。

-

关注新一代音频 Demo

- Meta 会不定期下线旧 Demo、上线新 Demo。

- 在研究网站的“Demos”或“Projects”栏目中,查找是否有新的语音/音频生成项目,它们往往延续或升级了 Audiobox 的技术路线。

-

阅读技术文档与论文

- 若你是开发者或研究人员,可下载相关论文 PDF。

- 重点关注模型架构、训练数据、控制参数设计等部分,为后续自研或集成提供思路。

二、寻找可替代的在线体验方式

-

查找第三方整合平台

- 某些 AI 工具平台可能曾集成过基于 Meta 研究成果的语音或音频模型。

- 在搜索引擎中使用“Meta AI 语音生成 API”“基于 Meta 研究的 TTS”等关键词进行检索。

-

使用其他开源或商用 TTS/音频生成工具

- 若你的目标是“文本转语音”或“声音克隆”,可以:

- 在 GitHub 搜索开源 TTS、voice cloning、audio generation 项目。

- 选择维护活跃、文档完善的项目进行试用。

- 虽然不等同于 Audiobox,但可在功能上实现相近的创作流程。

- 若你的目标是“文本转语音”或“声音克隆”,可以:

三、面向开发者的实践路径(概略步骤)

如果你希望在项目中使用类似 Audiobox 的技术能力,可参考以下通用步骤:

-

明确需求

- 确定你需要的是:

- 文本转语音旁白?

- 特定角色声音克隆?

- 背景环境音效生成?

- 明确输出格式(如 WAV、MP3)、采样率、语言种类等。

- 确定你需要的是:

-

选择合适的模型或服务

- 在 Meta AI 研究页面查找是否有开源模型或 API 说明。

- 若无公开接口,可选择其他研究机构或社区提供的相近模型。

-

搭建基础环境

- 准备 Python 环境(如 Conda 或 venv)。

- 安装必要依赖(PyTorch、音频处理库等)。

-

运行示例代码

- 按照模型仓库或 API 文档提供的示例脚本,输入文本或语音样本进行测试。

- 调整参数(语速、音高、情绪标签等),观察输出效果变化。

-

集成到你的应用

- 将语音生成逻辑封装为服务(如 REST API 或微服务)。

- 在前端或业务系统中调用该服务,实现自动配音、音效生成等功能。

四、持续关注 Audiobox 相关动态

-

订阅 Meta AI 官方渠道

- 关注 Meta AI 官方博客、X(Twitter)、GitHub 组织等。

- 当有新的音频相关项目或 Demo 发布时,通常会同步公告。

-

参与社区讨论

- 在机器学习、音频技术相关社区(如 Reddit、专业论坛、技术群组)中搜索 Audiobox 相关话题。

- 了解其他开发者如何复现或扩展类似能力。

总结来说,Audiobox 当前已不再以公开 Demo 的形式对外提供服务,但其代表的语音与音频生成技术方向仍在快速发展。通过关注 Meta AI 研究网站和相关社区,你依然可以获取最新的模型、Demo 与实践案例,在自己的项目中实现类似的智能音频创作体验。