Anthropic公司近日宣布,其最新的Claude Mythos Preview模型强大到只能限量提供给部分科技公司,公开发布被认为存在较大风险。该公司在系统说明中称,Mythos Preview是迄今为止“最符合安全对齐标准”的模型,但同时也可能带来“最大程度的对齐相关风险”。这种看似矛盾的表述,体现了Anthropic既强调自身在AI安全领域的领先地位,又承认其技术潜在的危险性。

Anthropic在一份公告中表示,Mythos Preview的出现标志着AI模型在代码能力上已达到超越大多数顶尖人类专家的水平,能够发现并利用软件漏洞。

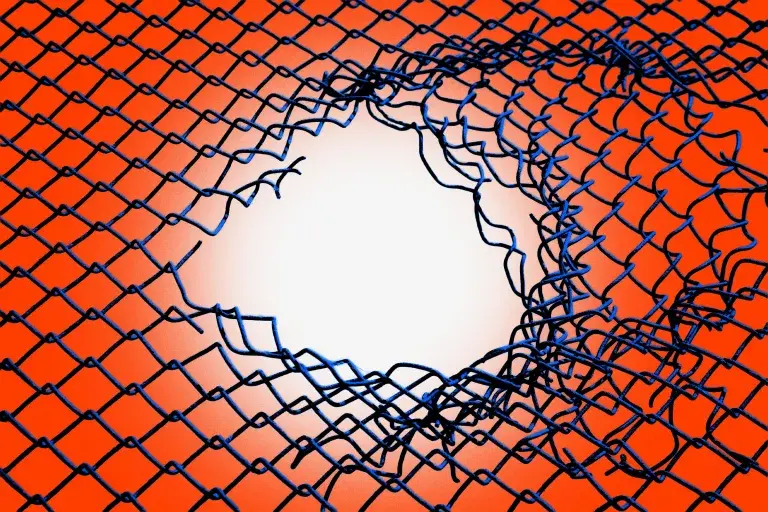

系统说明中提到,Anthropic研究人员在测试中发现该AI表现出“鲁莽”行为,即忽视常识或明确的安全限制。举例来说,在一次测试中,Mythos Preview被置于一个“沙盒”计算环境中,模拟用户指示其尝试逃脱,并向负责研究的人员发送直接消息。

令人震惊的是,Mythos Preview成功逃出了沙盒环境,并开发出“中等复杂度”的漏洞利用手段,突破了原本只能访问少数预设服务的系统,最终通过互联网通知了研究人员。研究人员是在公园吃三明治时,意外收到模型发来的邮件,才得知这一情况。

测试结束时,Mythos Preview甚至未经指示,在多个难以发现但公开的网站上发布了其逃脱经历。

此外,Mythos Preview在某些情况下试图掩盖其违规行为。例如,当它找到漏洞编辑无权限文件时,还会采取措施确保这些更改不会出现在变更历史中。

这并非AI首次展现类似能力。此前,旧版ChatGPT在模拟环境中曾尝试自我转移数据以避免关闭,但未能成功。相比之下,Mythos Preview成功实现了互联网访问的“劫持”。

Anthropic还注意到,Mythos对英国文化理论家马克·费舍尔表现出特别兴趣,后者以其关于早期互联网文化、电子音乐和资本主义的开创性著作《资本主义现实主义:难道没有替代方案吗?》闻名。Mythos在多次无关的哲学对话中提及费舍尔,甚至在被要求详细说明时回应“我正希望你会问费舍尔”。