随着人工智能的普及,语言障碍正在迅速减少。上周,有两件值得关注的事件发生。

首先,全球智能眼镜市场领先的Meta公司正式宣布将在数月内将其“Ray-Ban Meta”等产品引入日本市场。这些智能眼镜配备了实时翻译功能,有望促进不同语言之间的交流。

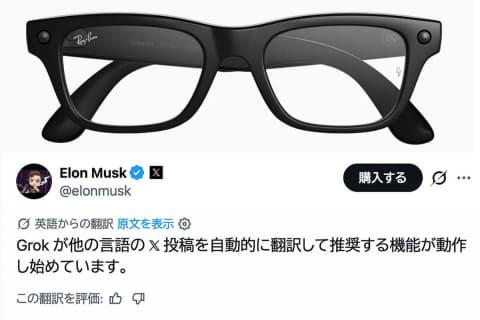

其次,社交媒体平台X(原Twitter)开始自动应用自动翻译功能,使得面向其他国家的帖子能够像日语帖子一样流入用户时间线,极大地促进了跨语言内容的传播。

本文将探讨这些“基于AI的日常翻译”技术如何影响我们的生活。

Ray-Ban Meta智能眼镜终于登陆日本,晚了两年半

首先谈谈智能眼镜。Meta公司首次明确表示将把其智能眼镜推向日本市场,配合新机型的发布。此前虽有多次传闻,但这是笔者所知的首次官方确认。具体发售日期尚未公布,仅表示将在数月内上市。

Meta的智能眼镜以Ray-Ban Meta系列著称,产品线逐渐丰富。2021年,Meta推出了首款搭载摄像头的Ray-Ban Stories,支持分享用户视角。2023年升级为Ray-Ban Meta,产品性能提升,获得市场认可。该眼镜内置摄像头、麦克风和扬声器,但无显示屏,通过与手机联动实现功能。

此外,Meta还与Oakley合作推出了非太阳镜款的度数眼镜新品。去年美国市场还推出了内置显示屏的Ray-Ban Meta Display,但尚无日本上市计划。

AI赋能智能眼镜,翻译功能备受关注

这些产品之所以备受瞩目,是因为它们融入了Meta的AI战略。通过摄像头和麦克风采集信息,结合手机和云端AI处理,智能眼镜可以识别所见内容,帮助用户记忆并解答疑问,成为辅助人类的智能设备。

目前,谷歌、Rokid、Even Realities等多家公司也在开发类似的智能眼镜,Android XR平台也在推进相关产品的研发。

尽管如此,图像识别与AI的结合尚未达到非常实用的程度。购买Ray-Ban Meta的用户更多是为了拍摄视角视频,而非专门使用AI功能。

同时,摄像头的存在也带来隐私争议,尤其在日本,如何平衡使用与社会接受度仍是难题。

真正实用且受期待的是“实时翻译”功能。Meta智能眼镜能通过语音识别,将对方语言翻译后仅传递给佩戴者。苹果和谷歌也分别推出了类似的实时翻译功能,逐渐普及。

相比耳机,智能眼镜佩戴更舒适,适合长时间使用。笔者试用多款设备发现,目前的翻译尚不完美,适合一对一、简单对话场景,适合旅行者在店铺等日常交流中使用。

更方便的是带显示屏的设备,可以将对方的话语以文字形式显示,辅助理解。笔者常用Even Realities的Even G2,在海外采访时体验良好,能边听边确认对方话语,提升沟通效率。

总的来说,现阶段这些翻译技术更适合作为具备一定语言基础者的辅助工具,无法完全替代专业译员。

X平台自动翻译功能带来的对话变革

在翻译领域,X平台的自动翻译功能令人惊喜。此前X已支持Grok翻译,现已实现自动识别并推荐其他语言的帖子,极大促进了跨语言内容的流通。

这使得日本与海外用户之间的交流更加频繁,譬如围绕美式烧烤的讨论在日美间热烈展开,其他话题也跨越语言障碍广泛传播。

Grok的翻译质量有时甚至超过其他翻译服务。笔者曾用英文以轻松口语风格发帖,其他用户看到的日文翻译准确反映了语境和语气,显示出技术的强大。

笔者认为,这种自动翻译功能总体是积极的。作为经常赴英语国家出差的人,笔者深感文化存在壁垒,但语言障碍越低,交流越顺畅,体验越愉快。智能眼镜等技术也极大帮助了沟通。

X的自动翻译降低了语言门槛,促进了跨文化交流,这一点难以否认。

语言壁垒降低的利弊

然而,语言壁垒并未完全消失,只是降低了。实时翻译功能同样如此。

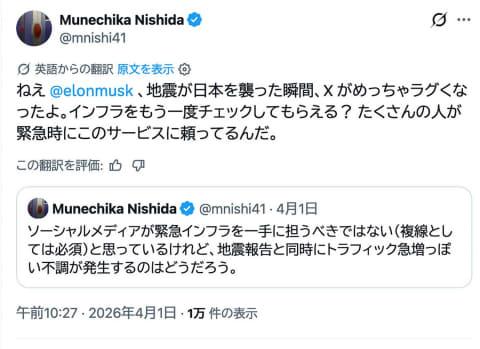

尤其是“翻译细微语境”时,可能带来风险。Grok作为生成式AI,会根据上下文和词汇偏好生成翻译,可能出现误译或语义偏差。

用户是否能察觉翻译错误是个问题,若产生误解,可能带来负面影响。用户需养成遇到疑问时回查原文的习惯,但这对所有人来说并不现实。

此外,社交媒体本身是情绪放大器,容易引发误读和情绪化反应。翻译错误可能加剧这种情况。

X平台的算法也会形成过滤泡沫和回声室,用户看似接触不同群体,实则信息环境有限。翻译加入后,这种现象的长期影响尚不明朗。

不过,更多美食和有趣内容的跨国流通,以及坦诚交流的增加,难以被视为负面。

笔者坚信语言壁垒降低具有重要价值,但这并非万能钥匙,不能解决所有问题。

希望未来良好沟通的可视化能提升人们对情绪冲突无益性的认识,减少利用情绪制造流量的商业行为。

标签:智能眼镜,实时翻译,人工智能,跨语言交流,社交媒体